Apache Airflow

تنسيق سير العمل البرمجي

مجاني

المنصات المدعومة

web

علامات الأدوات

ما هو

Apache Airflow عبارة عن منصة لتأليف جداول سير العمل ومراقبتها برمجيًا. تمكن المستخدمين من تحديد خطوط الأنابيب ككود Python، مما يوفر المرونة والتحكم في مهام معالجة البيانات. تكمن القيمة الأساسية لـ Airflow في قدرته على تنسيق سير العمل المعقد، مما يضمن تشغيل المهام بالترتيب الصحيح والتعامل مع التبعيات بفعالية. على عكس وظائف cron التقليدية أو البرمجة النصية، يوفر Airflow واجهة مستخدم قوية للمراقبة وتسجيل الدخول وإدارة سير العمل على نطاق واسع. إن بنيته المعيارية وعمليات التكامل المكثفة مع موفري الخدمات السحابية والخدمات الخارجية تجعلها قابلة للتكيف مع بيئات متنوعة. يستفيد مهندسو البيانات وعلماء البيانات وفرق DevOps من قدرة Airflow على أتمتة وتبسيط خطوط أنابيب البيانات وتدريب نماذج التعلم الآلي وإدارة البنية التحتية.

الميزات الأساسية

تعريف سير العمل المستند إلى Python

يستخدم Airflow لغة Python لتحديد سير العمل (DAGs)، مما يسمح للمطورين بالاستفادة من القوة الكاملة لنظام Python البيئي. يتضمن ذلك استخدام ميزات Python القياسية مثل الحلقات والعبارات الشرطية وتنسيقات التاريخ/الوقت للجدولة. يوفر هذا النهج المرونة ويتجنب قيود تعريفات سير العمل المستندة إلى سطر الأوامر أو XML، مما يتيح إنشاء خطوط أنابيب ديناميكية وتنفيذ منطق معقد.

بنية قابلة للتطوير ومعيارية

يسمح تصميم Airflow المعياري بتوسيع نطاقه للتعامل مع عدد كبير من المهام المتزامنة. يستخدم قائمة انتظار رسائل (مثل Celery و RabbitMQ) لتنسيق العمال، مما يتيح التوسع الأفقي عن طريق إضافة المزيد من عقد العمال. تضمن هذه البنية أن Airflow يمكنه إدارة سير العمل المعقد مع العديد من التبعيات وحجم البيانات الكبير، مما يجعلها مناسبة لعمليات النشر على مستوى المؤسسات.

واجهة مستخدم ويب قوية

يوفر Airflow واجهة مستخدم ويب سهلة الاستخدام لمراقبة سير العمل وجدولته وإدارته. توفر واجهة المستخدم تحديثات حالة المهام في الوقت الفعلي وسجلات مفصلة والقدرة على تشغيل المهام وإيقافها مؤقتًا وإعادة محاولتها. تعمل هذه الواجهة المركزية على تبسيط إدارة سير العمل وتوفر رؤى حول أداء خط الأنابيب وتقلل الحاجة إلى التدخل اليدوي، مما يحسن الكفاءة التشغيلية.

عمليات تكامل واسعة النطاق

يوفر Airflow مجموعة واسعة من المشغلين المدمجين للتكامل مع الخدمات المختلفة، بما في ذلك Google Cloud Platform و Amazon Web Services و Microsoft Azure والعديد من الأدوات الخارجية. تعمل هذه المشغلات على تبسيط عملية تنفيذ المهام على منصات مختلفة، مما يقلل الحاجة إلى البرمجة النصية المخصصة وتسريع تطوير خطوط أنابيب البيانات وسير العمل الأخرى.

إنشاء خط أنابيب ديناميكي

يسمح Airflow بإنشاء خط أنابيب ديناميكي من خلال كود Python. هذا يعني أنه يمكنك كتابة كود يقوم بإنشاء خطوط أنابيب ديناميكيًا، بناءً على البيانات أو المعلمات الأخرى. هذه الميزة مفيدة بشكل خاص للتعامل مع المهام المتكررة أو معالجة البيانات من مصادر متعددة أو إنشاء خطوط أنابيب تتكيف مع متطلبات العمل المتغيرة، مما يعزز المرونة والأتمتة.

مفتوح المصدر ومدعوم من المجتمع

Airflow هو مشروع مفتوح المصدر مع مجتمع نابض بالحياة. هذا يعني أنه يمكن للمستخدمين المساهمة في المشروع ومشاركة تجاربهم والوصول إلى ثروة من الموارد والدعم. تعزز طبيعة المصدر المفتوح الشفافية والتعاون والتحسين المستمر، مما يضمن بقاء Airflow نظامًا أساسيًا قويًا وقابلاً للتكيف لتنسيق سير العمل.

كيفية الاستخدام

- قم بتثبيت Airflow باستخدام pip:

pip install apache-airflow.,2. تهيئة قاعدة بيانات Airflow:airflow db init.,3. قم بإنشاء DAG (رسم بياني غير دوري موجه) في Python، مع تحديد مهام سير العمل والتبعيات الخاصة بك.,4. ضع ملف DAG الخاص بك في مجلدdagsداخل دليل Airflow الرئيسي الخاص بك.,5. ابدأ خادم الويب والمجدول Airflow:airflow webserver -p 8080وairflow scheduler.,6. قم بالوصول إلى واجهة مستخدم Airflow في متصفحك (عادةً علىhttp://localhost:8080) لمراقبة وإدارة سير العمل الخاص بك.

حالات الاستخدام

أتمتة خط أنابيب البيانات

يستخدم مهندسو البيانات Airflow لأتمتة عملية ETL (الاستخراج والتحويل والتحميل). يقومون بتعريف DAGs لاستخراج البيانات من مصادر مختلفة وتحويلها باستخدام أدوات مثل Spark أو Pandas وتحميلها في مستودع بيانات. يضمن ذلك تحديث البيانات باستمرار وجاهزيتها للتحليل، مما يوفر الوقت والموارد.

تدريب نموذج التعلم الآلي

يستخدم علماء البيانات Airflow لجدولة وإدارة تدريب نماذج التعلم الآلي. يقومون بإنشاء DAGs لتنسيق المعالجة المسبقة للبيانات وتدريب النموذج والتقييم والنشر. يؤدي هذا إلى أتمتة دورة حياة ML، مما يضمن إعادة تدريب النماذج بانتظام بأحدث البيانات ونشرها بكفاءة.

إدارة البنية التحتية

يستخدم مهندسو DevOps Airflow لأتمتة مهام البنية التحتية، مثل توفير الخوادم ونشر التطبيقات وإدارة موارد السحابة. يقومون بإنشاء DAGs لتنسيق هذه المهام، مما يضمن تنفيذها بالترتيب الصحيح وبالتبعيات اللازمة، مما يحسن الكفاءة التشغيلية.

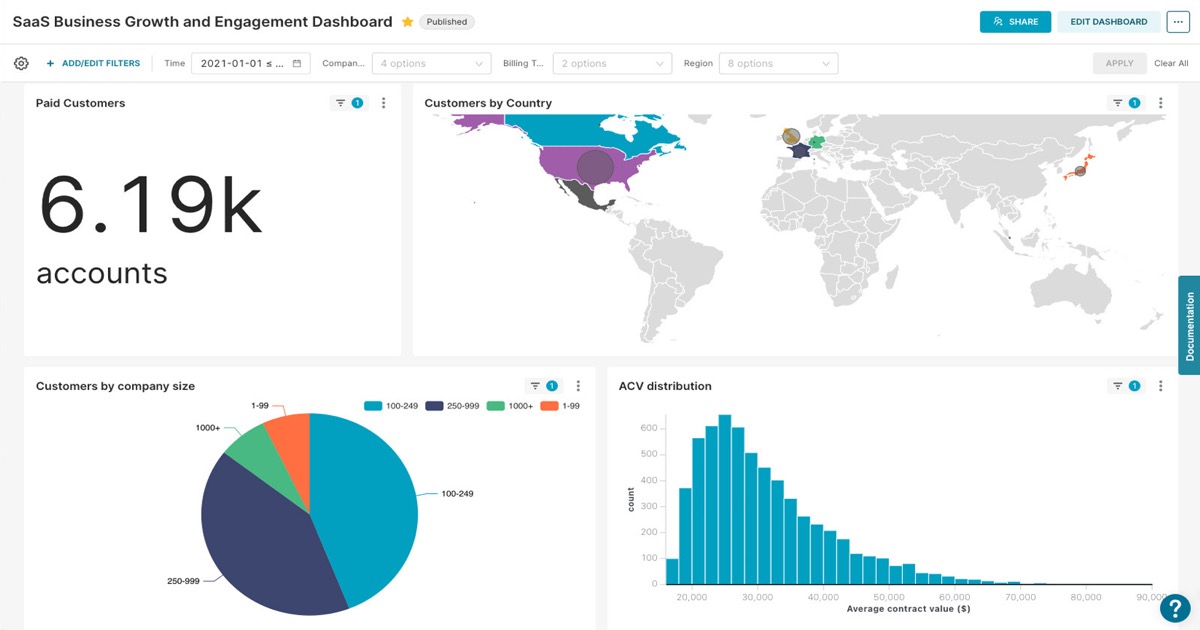

إعداد التقارير والتحليلات

يستخدم المحللون Airflow لأتمتة إنشاء التقارير ولوحات المعلومات. يقومون بتعريف DAGs لاستخراج البيانات من قواعد البيانات وتحويلها وإنشاء التقارير باستخدام أدوات مثل SQL أو نصوص Python. يضمن ذلك إنشاء التقارير بجدول زمني منتظم وتوفير رؤى حديثة.

من يستفيد

مهندسو البيانات

يحتاج مهندسو البيانات إلى Airflow لبناء خطوط أنابيب البيانات وإدارتها. يستخدمونه لأتمتة عمليات ETL، مما يضمن تحويل البيانات وتحميلها بكفاءة. تساعد إمكانات الجدولة والمراقبة في Airflow على الحفاظ على جودة البيانات وتقليل التدخل اليدوي.

علماء البيانات

يستخدم علماء البيانات Airflow لأتمتة دورة حياة التعلم الآلي. يقومون بإنشاء سير عمل للمعالجة المسبقة للبيانات وتدريب النموذج والتقييم والنشر. يتيح لهم ذلك التركيز على تطوير النماذج والتحليل بدلاً من التنسيق اليدوي.

مهندسو DevOps

يستخدم مهندسو DevOps Airflow لأتمتة مهام البنية التحتية. يقومون بإنشاء سير عمل لتوفير الخوادم ونشر التطبيقات وإدارة موارد السحابة. يؤدي هذا إلى تحسين الكفاءة التشغيلية وتقليل مخاطر الأخطاء.

محللو الأعمال

يستخدم محللو الأعمال Airflow لأتمتة عمليات إعداد التقارير والتحليلات. يقومون بإنشاء سير عمل لاستخراج البيانات وتحويلها وإنشاء التقارير. يضمن ذلك إنشاء التقارير بجدول زمني منتظم وتوفير رؤى حديثة.

نظام التسعير

Apache License 2.0 (مفتوح المصدر). مجاني للاستخدام والتعديل والتوزيع.