ONNX Runtime

Eine plattformübergreifende Machine-Learning-Engine für die Hochleistungs-Modell

Freemium

Unterstützte Plattformen

web

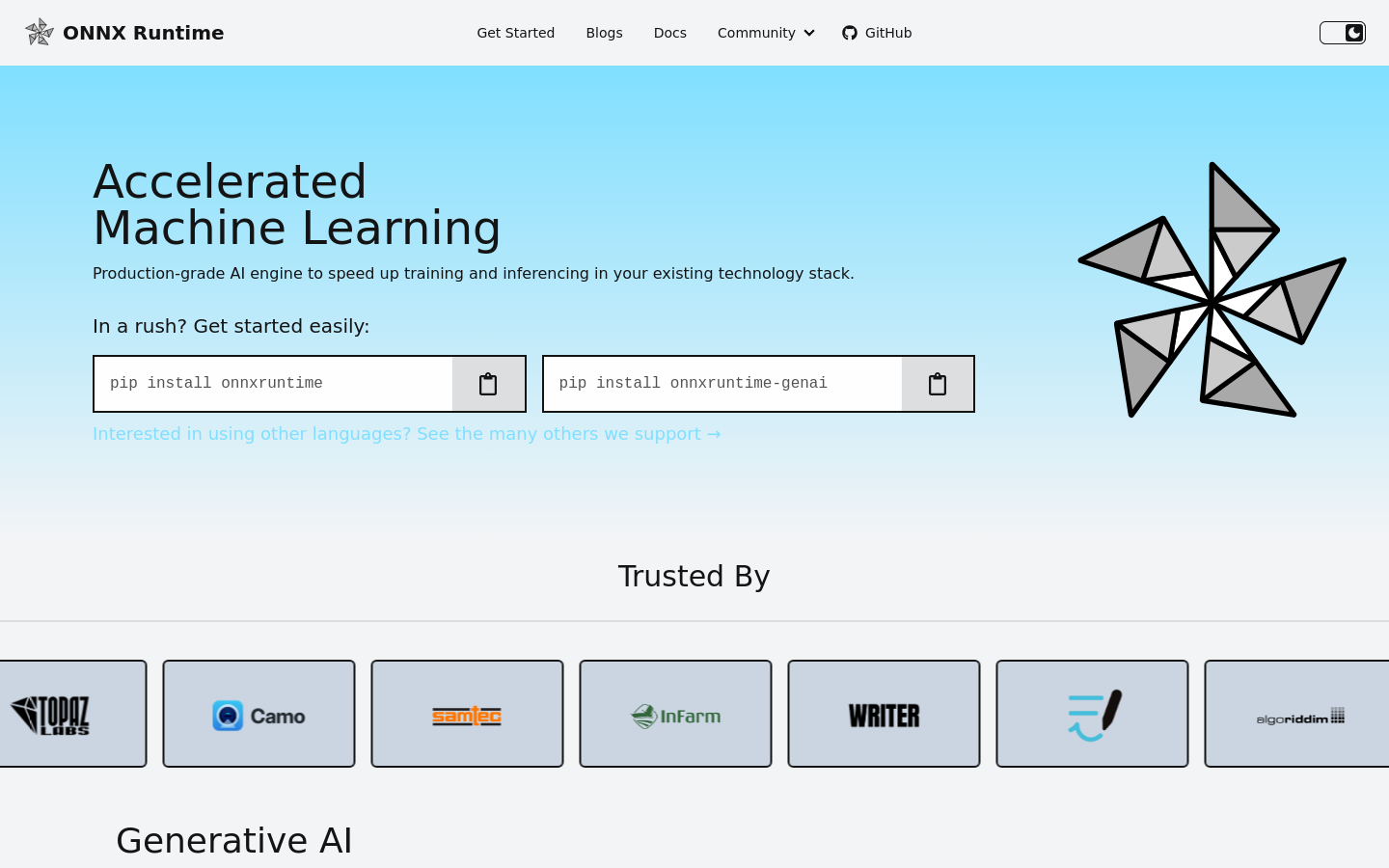

Was ist ONNX Runtime

ONNX Runtime ist eine KI-Engine auf Produktionsebene, die entwickelt wurde, um das häufige Problem der Optimierung von Machine-Learning-Modellen für unterschiedliche Hardware- und Softwareumgebungen zu lösen. Durch die Bereitstellung einer einheitlichen Schnittstelle für Training und Inferenz ermöglicht sie es Teams, Modelle auf CPUs, GPUs und NPUs bereitzustellen, ohne dabei Leistungseinbußen in Kauf nehmen zu müssen. Egal, ob Sie mit Large Language Models (LLMs) oder standardmäßigen Vorhersagemodellen arbeiten, diese Engine stellt sicher, dass Ihre Anwendungen unabhängig von der zugrunde liegenden Infrastruktur eine niedrige Latenz und einen hohen Durchsatz beibehalten. Die auf Flexibilität ausgelegte Runtime unterstützt eine Vielzahl von Programmiersprachen – darunter Python, C#, C++, Java, JavaScript und Rust – und ist damit eine vielseitige Wahl für komplexe Technologie-Stacks. Sie schließt die Lücke zwischen Entwicklung und Produktion und ermöglicht es Entwicklern, ein konsistentes Modellverhalten über Linux, Windows, macOS, mobile Plattformen und Webbrowser hinweg aufrechtzuerhalten. Durch die Optimierung der Ausführung modernster Modelle können sich Ingenieure auf den Aufbau intelligenter Funktionen konzentrieren, anstatt sich mit der Fehlerbehebung bei Hardwarekompatibilität oder Leistungsabfällen zu befassen.

Hauptfunktionen von ONNX Runtime

Hardware-Beschleunigung

Optimiert die Leistung hinsichtlich Latenz, Durchsatz und Speicherauslastung über eine breite Palette von Hardware hinweg, einschließlich CPUs, GPUs und NPUs, um sicherzustellen, dass Ihre Modelle auf jedem Gerät effizient laufen.

Plattformübergreifende Unterstützung

Bietet robuste Kompatibilität über gängige Betriebssysteme wie Linux, Windows und macOS sowie mobile Plattformen und Webbrowser hinweg, was eine wirklich portable KI-Strategie ermöglicht.

Mehrsprachige Unterstützung

Bietet native Integration für Entwickler, die Python, C#, C++, Java, JavaScript und Rust verwenden, wodurch es einfach wird, leistungsstarke KI in vielfältige und bestehende Technologie-Stacks zu integrieren.

Generative KI-Integration

Ermöglicht die Bereitstellung modernster Large Language Models und unterstützt fortschrittliche Aufgaben wie Textgenerierung und Bildsynthese direkt in Ihren Produktionsanwendungen.

Wie man ONNX Runtime verwendet

- Beginnen Sie mit der Installation des Runtime-Pakets über Ihren bevorzugten Paketmanager, wie zum Beispiel 'pip install onnxruntime' oder 'pip install onnxruntime-genai', um Ihre Umgebung einzurichten.

- Initialisieren Sie die Runtime, indem Sie den Dateipfad Ihres Machine-Learning-Modells an die Klasse 'InferenceSession' übergeben, wodurch die Engine auf die Ausführung Ihres spezifischen Modells vorbereitet wird.

- Formatieren Sie Ihre Eingabedaten in die erforderliche Tensor-Struktur und stellen Sie sicher, dass sie mit dem erwarteten Eingabeschema des Modells übereinstimmen, um Laufzeitfehler während der Verarbeitung zu vermeiden.

- Führen Sie das Modell aus, indem Sie die Methode 'session.run' mit Ihren vorbereiteten Eingabedaten aufrufen, was die Engine dazu veranlasst, effizient Vorhersagen oder Ausgaben zu generieren.

- Überprüfen Sie die von der Session zurückgegebenen Ergebnisse, um die Vorhersagen des Modells nahtlos in Ihren bestehenden Anwendungs-Workflow oder Ihre Servicelogik zu integrieren.

Anwendungsfälle von ONNX Runtime

Edge-KI-Bereitstellung

Entwickler können leistungsstarke KI-Modelle auf ressourcenbeschränkten Geräten wie Mobiltelefonen oder IoT-Hardware bereitstellen, indem sie optimierte Runtime-Konfigurationen nutzen.

Bereitstellung von Produktionsmodellen

Ingenieure können Machine-Learning-Modelle zuverlässig in Produktionsumgebungen bereitstellen und sicherstellen, dass Endbenutzeranwendungen von niedriger Latenz und hohem Durchsatz profitieren.

Plattformübergreifende Anwendungsentwicklung

Teams, die Anwendungen für mehrere Plattformen entwickeln, können eine einzige, einheitliche Runtime verwenden, um eine konsistente KI-Leistung über Desktop-, Mobil- und Webumgebungen hinweg aufrechtzuerhalten.

Wer profitiert von ONNX Runtime

Machine Learning Engineers

Fachleute, die sich auf die Optimierung der Modellinferenzgeschwindigkeit und Ressourceneffizienz konzentrieren, um sicherzustellen, dass ihre KI-Anwendungen Produktionsstandards erfüllen.

Softwareentwickler

Entwickler, die KI in Anwendungen verschiedener Sprachen integrieren und eine zuverlässige, leistungsstarke Ausführungs-Engine benötigen, die in ihren bestehenden Stack passt.

Preise für ONNX Runtime

ONNX Runtime ist ein Open-Source-Projekt und kostenlos verfügbar.