Apache Airflow

Programmatische Workflow-Orchestrierung

Frei

Unterstützte Plattformen

web

Was ist Apache Airflow

Apache Airflow ist eine Plattform zum programmgesteuerten Erstellen, Planen und Überwachen von Workflows. Es ermöglicht Benutzern, Pipelines als Python-Code zu definieren und bietet Flexibilität und Kontrolle über Datenverarbeitungsaufgaben. Der Kernwert von Airflow liegt in seiner Fähigkeit, komplexe Workflows zu orchestrieren, um sicherzustellen, dass Aufgaben in der richtigen Reihenfolge ausgeführt werden und Abhängigkeiten effektiv behandelt werden. Im Gegensatz zu herkömmlichen Cron-Jobs oder Skripten bietet Airflow eine robuste UI zur Überwachung, Protokollierung und Verwaltung von Workflows in großem Umfang. Seine modulare Architektur und die umfassenden Integrationen mit Cloud-Anbietern und Drittanbieterdiensten machen es an verschiedene Umgebungen anpassbar. Data Engineers, Data Scientists und DevOps-Teams profitieren von Airflows Fähigkeit, Datenpipelines, das Training von Machine-Learning-Modellen und die Infrastrukturverwaltung zu automatisieren und zu rationalisieren.

Hauptfunktionen von Apache Airflow

Python-basierte Workflow-Definition

Airflow verwendet Python zur Definition von Workflows (DAGs), sodass Entwickler die volle Leistung des Python-Ökosystems nutzen können. Dies beinhaltet die Verwendung von Python-Standardfunktionen wie Schleifen, bedingten Anweisungen und Datums-/Zeitformaten für die Planung. Dieser Ansatz bietet Flexibilität und vermeidet die Einschränkungen von Befehlszeilen- oder XML-basierten Workflow-Definitionen, wodurch die dynamische Pipeline-Generierung und die Implementierung komplexer Logik ermöglicht werden.

Skalierbare und modulare Architektur

Das modulare Design von Airflow ermöglicht es, eine große Anzahl gleichzeitiger Aufgaben zu bewältigen. Es verwendet eine Message Queue (z. B. Celery, RabbitMQ), um Worker zu orchestrieren, was eine horizontale Skalierung durch Hinzufügen weiterer Worker-Knoten ermöglicht. Diese Architektur stellt sicher, dass Airflow komplexe Workflows mit zahlreichen Abhängigkeiten und großen Datenmengen verwalten kann, wodurch es sich für Bereitstellungen auf Unternehmensebene eignet.

Robuste Web-UI

Airflow bietet eine benutzerfreundliche Web-UI zur Überwachung, Planung und Verwaltung von Workflows. Die UI bietet Echtzeit-Task-Status-Updates, detaillierte Protokolle und die Möglichkeit, Tasks auszulösen, anzuhalten und erneut zu versuchen. Diese zentrale Schnittstelle vereinfacht die Workflow-Verwaltung, bietet Einblicke in die Pipeline-Leistung und reduziert den Bedarf an manuellen Eingriffen, wodurch die betriebliche Effizienz verbessert wird.

Umfassende Integrationen

Airflow bietet eine breite Palette von vorgefertigten Operatoren für die Integration mit verschiedenen Diensten, einschließlich Google Cloud Platform, Amazon Web Services, Microsoft Azure und vielen Tools von Drittanbietern. Diese Operatoren vereinfachen den Prozess der Ausführung von Aufgaben auf verschiedenen Plattformen, reduzieren den Bedarf an benutzerdefinierten Skripten und beschleunigen die Entwicklung von Datenpipelines und anderen Workflows.

Dynamische Pipeline-Generierung

Airflow ermöglicht die dynamische Pipeline-Generierung durch Python-Code. Dies bedeutet, dass Sie Code schreiben können, der Pipelines dynamisch instanziiert, basierend auf Daten oder anderen Parametern. Diese Funktion ist besonders nützlich für die Bearbeitung wiederkehrender Aufgaben, die Verarbeitung von Daten aus mehreren Quellen oder die Erstellung von Pipelines, die sich an sich ändernde Geschäftsanforderungen anpassen, wodurch Flexibilität und Automatisierung verbessert werden.

Open Source und Community-getrieben

Airflow ist ein Open-Source-Projekt mit einer lebendigen Community. Dies bedeutet, dass Benutzer zum Projekt beitragen, ihre Erfahrungen austauschen und auf eine Fülle von Ressourcen und Support zugreifen können. Die Open-Source-Natur fördert Transparenz, Zusammenarbeit und kontinuierliche Verbesserung und stellt sicher, dass Airflow eine leistungsstarke und anpassungsfähige Workflow-Orchestrierungsplattform bleibt.

Wie man Apache Airflow verwendet

- Installieren Sie Airflow mit pip:

pip install apache-airflow.,2. Initialisieren Sie die Airflow-Datenbank:airflow db init.,3. Erstellen Sie einen DAG (Directed Acyclic Graph) in Python, der Ihre Workflow-Aufgaben und Abhängigkeiten definiert.,4. Platzieren Sie Ihre DAG-Datei im Ordnerdagsin Ihrem Airflow-Home-Verzeichnis.,5. Starten Sie den Airflow-Webserver und den Scheduler:airflow webserver -p 8080undairflow scheduler.,6. Greifen Sie in Ihrem Browser auf die Airflow-UI zu (normalerweise unterhttp://localhost:8080), um Ihre Workflows zu überwachen und zu verwalten.

Anwendungsfälle von Apache Airflow

Automatisierung von Datenpipelines

Data Engineers verwenden Airflow, um den ETL-Prozess (Extract, Transform, Load) zu automatisieren. Sie definieren DAGs, um Daten aus verschiedenen Quellen zu extrahieren, sie mit Tools wie Spark oder Pandas zu transformieren und in ein Data Warehouse zu laden. Dies stellt sicher, dass die Daten konsistent aktualisiert und für die Analyse bereit sind, wodurch Zeit und Ressourcen gespart werden.

Training von Machine-Learning-Modellen

Data Scientists verwenden Airflow, um das Training von Machine-Learning-Modellen zu planen und zu verwalten. Sie erstellen DAGs, um die Datenvorverarbeitung, das Modelltraining, die Bewertung und die Bereitstellung zu orchestrieren. Dies automatisiert den ML-Lebenszyklus und stellt sicher, dass Modelle regelmäßig mit den neuesten Daten neu trainiert und effizient bereitgestellt werden.

Infrastrukturverwaltung

DevOps-Ingenieure verwenden Airflow, um Infrastrukturaufgaben zu automatisieren, z. B. das Bereitstellen von Servern, das Bereitstellen von Anwendungen und die Verwaltung von Cloud-Ressourcen. Sie erstellen DAGs, um diese Aufgaben zu orchestrieren, um sicherzustellen, dass sie in der richtigen Reihenfolge und mit den erforderlichen Abhängigkeiten ausgeführt werden, wodurch die betriebliche Effizienz verbessert wird.

Reporting und Analyse

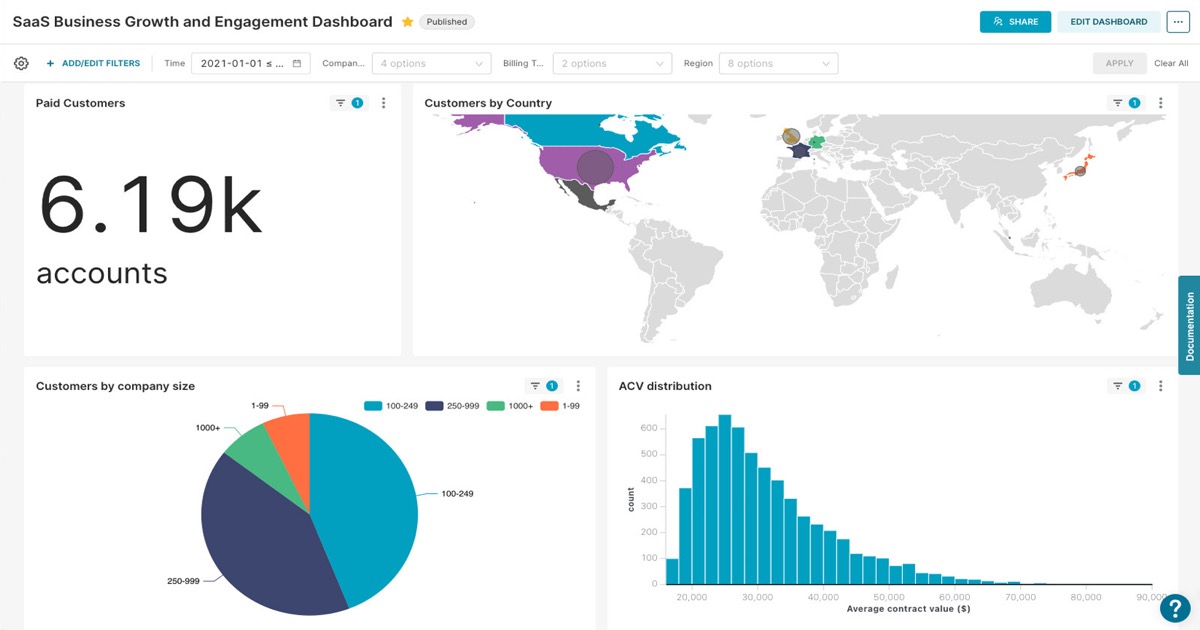

Analysten verwenden Airflow, um die Erstellung von Berichten und Dashboards zu automatisieren. Sie definieren DAGs, um Daten aus Datenbanken zu extrahieren, sie zu transformieren und Berichte mit Tools wie SQL oder Python-Skripten zu erstellen. Dies stellt sicher, dass Berichte regelmäßig generiert werden und aktuelle Erkenntnisse liefern.

Wer profitiert von Apache Airflow

Data Engineers

Data Engineers benötigen Airflow, um Datenpipelines zu erstellen und zu verwalten. Sie verwenden es, um ETL-Prozesse zu automatisieren und sicherzustellen, dass Daten effizient transformiert und geladen werden. Die Planungs- und Überwachungsfunktionen von Airflow helfen ihnen, die Datenqualität aufrechtzuerhalten und manuelle Eingriffe zu reduzieren.

Data Scientists

Data Scientists verwenden Airflow, um den Machine-Learning-Lebenszyklus zu automatisieren. Sie erstellen Workflows für die Datenvorverarbeitung, das Modelltraining, die Bewertung und die Bereitstellung. Dies ermöglicht es ihnen, sich auf die Modellentwicklung und -analyse zu konzentrieren, anstatt auf manuelle Orchestrierung.

DevOps-Ingenieure

DevOps-Ingenieure verwenden Airflow, um Infrastrukturaufgaben zu automatisieren. Sie erstellen Workflows für die Bereitstellung von Servern, die Bereitstellung von Anwendungen und die Verwaltung von Cloud-Ressourcen. Dies verbessert die betriebliche Effizienz und reduziert das Fehlerrisiko.

Business Analysten

Business Analysten verwenden Airflow, um Reporting- und Analyseprozesse zu automatisieren. Sie erstellen Workflows, um Daten zu extrahieren, zu transformieren und Berichte zu erstellen. Dies stellt sicher, dass Berichte regelmäßig generiert werden und aktuelle Erkenntnisse liefern.

Preise für Apache Airflow

Apache License 2.0 (Open Source). Kostenlose Nutzung, Änderung und Verbreitung.