Cleanlab

Echtzeit-LLM-Vertrauensbewertung

Bezahlt

Unterstützte Plattformen

web

Was ist Cleanlab

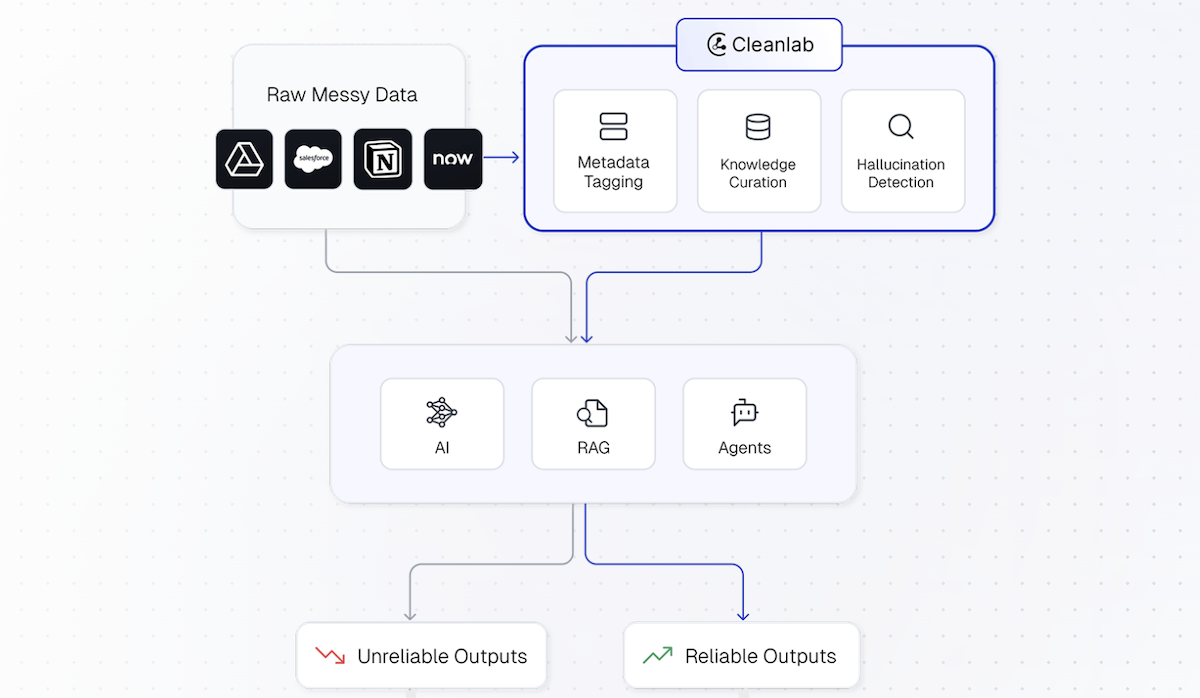

Cleanlab's Trustworthy Language Model (TLM) bietet Echtzeit-Vertrauensbewertungen für Large Language Model (LLM)-Ausgaben und mindert so das Risiko von Halluzinationen und falschen Antworten. Es hilft Benutzern, zuverlässige LLM-Antworten zu identifizieren und die Genauigkeit und Zuverlässigkeit von KI-gestützten Anwendungen sicherzustellen. Im Gegensatz zu generischen LLM-Evaluierungstools konzentriert sich TLM auf Echtzeit-Bewertungen und lässt sich nahtlos in bestehende Workflows integrieren. Es nutzt fortschrittliche Algorithmen, um die Vertrauenswürdigkeit von LLM-Ausgaben zu bewerten und umsetzbare Erkenntnisse zur Verbesserung der KI-Zuverlässigkeit zu liefern. TLM ist ideal für Unternehmen und Entwickler, die vertrauenswürdige KI-Lösungen entwickeln möchten, wie z. B. Chatbots, Datenextraktionstools und agentenbasierte Systeme. Es ermöglicht Benutzern, fundierte Entscheidungen auf der Grundlage der Zuverlässigkeit von LLM-Antworten zu treffen und so die Benutzererfahrung und die Geschäftsergebnisse zu verbessern.

Hauptfunktionen von Cleanlab

Echtzeit-Vertrauensbewertung

TLM liefert sofortige Vertrauensbewertungen für LLM-Ausgaben und ermöglicht so eine dynamische Entscheidungsfindung während der Laufzeit. Dies steht im Gegensatz zu Batch-Verarbeitungsmethoden und ermöglicht die sofortige Identifizierung unzuverlässiger Antworten. Die Bewertung basiert auf einem proprietären Algorithmus, der verschiedene Faktoren analysiert, darunter die Zuversicht des LLM, die Konsistenz der Antwort und das Vorhandensein von Faktenfehlern. Diese Echtzeitfähigkeit ist entscheidend für Anwendungen, bei denen sofortige Genauigkeit von größter Bedeutung ist.

Halluzinationserkennung

TLM wurde entwickelt, um LLM-generierte Halluzinationen zu erkennen und zu kennzeichnen, d. h. falsche oder erfundene Antworten. Es verwendet fortschrittliche Techniken, um Inkonsistenzen und Faktenungenauigkeiten innerhalb der LLM-Ausgabe zu identifizieren. Diese Funktion ist entscheidend für Anwendungen, bei denen Genauigkeit von größter Bedeutung ist, wie z. B. medizinische Diagnosen oder Finanzanalysen, bei denen falsche Informationen schwerwiegende Folgen haben können. Das System liefert eine Konfidenzbewertung, die die Wahrscheinlichkeit einer Halluzination angibt.

Anpassbare Bewertungskriterien

TLM ermöglicht es Benutzern, benutzerdefinierte Bewertungskriterien zu definieren, die auf ihre spezifischen Anwendungsfälle und Daten zugeschnitten sind. Diese Flexibilität ermöglicht es Benutzern, die Vertrauenswürdigkeitsbewertung an ihre spezifischen Bedürfnisse anzupassen und sicherzustellen, dass das System mit ihren individuellen Anforderungen übereinstimmt. Benutzer können die Arten von Fehlern angeben, denen Priorität eingeräumt werden soll, und die akzeptablen Risikoniveaus. Diese Anpassung ist unerlässlich, um die Leistung von LLM-Anwendungen in verschiedenen Bereichen zu optimieren.

Integration mit verschiedenen LLMs

TLM unterstützt die Integration mit einer Vielzahl von LLMs, einschließlich OpenAI-Modellen und anderen, und bietet so eine breite Kompatibilität. Dies ermöglicht es Benutzern, die Vertrauenswürdigkeitsbewertungsfunktionen von TLM unabhängig von ihrem gewählten LLM-Anbieter anzuwenden. Das System ist so konzipiert, dass es sich an verschiedene LLM-Architekturen und Ausgabeformate anpassen lässt, um eine nahtlose Integration zu gewährleisten. Diese Flexibilität vereinfacht den Prozess der Integration von TLM in bestehende KI-Workflows.

Anwendungsspezifische Lösungen

Cleanlab bietet vorgefertigte Lösungen und Anleitungen für verschiedene Anwendungsfälle, wie z. B. vertrauenswürdige RAG-Chatbots, Datenextraktion und agentenbasierte Systeme. Diese Lösungen bieten einen Ausgangspunkt für die Implementierung von TLM in spezifischen Anwendungen und rationalisieren den Entwicklungsprozess. Die Anleitungen bieten Best Practices und Beispiele für die Integration von TLM in verschiedene Workflows. Dieser gezielte Ansatz hilft Benutzern, die Funktionen von TLM schnell einzusetzen und davon zu profitieren.

Wie man Cleanlab verwendet

- Greifen Sie auf die Cleanlab TLM-Dokumentation zu und machen Sie sich mit den verfügbaren APIs und SDKs vertraut.,2. Integrieren Sie die TLM-API in Ihre bestehende LLM-basierte Anwendung oder Ihren Workflow.,3. Senden Sie LLM-Antworten an die TLM-API, um eine Echtzeit-Vertrauensbewertung zu erhalten.,4. Analysieren Sie die zurückgegebenen Vertrauensbewertungen, um potenziell unzuverlässige LLM-Ausgaben zu identifizieren.,5. Implementieren Sie Strategien zur Behandlung von niedrigen Vertrauensbewertungen, z. B. das Umformulieren von Prompts, das Kreuzvalidieren von Antworten oder das Bereitstellen alternativer Antworten.,6. Überwachen und verfeinern Sie Ihre LLM-Anwendung kontinuierlich auf der Grundlage der Erkenntnisse von TLM, um die Genauigkeit und Zuverlässigkeit zu verbessern.

Anwendungsfälle von Cleanlab

Vertrauenswürdige Chatbots

Entwickler können TLM verwenden, um Chatbots zu erstellen, die zuverlässige und genaue Informationen liefern, indem sie die Vertrauenswürdigkeit jeder Antwort bewerten. Dadurch wird sichergestellt, dass der Chatbot keine falschen oder irreführenden Antworten generiert, wodurch das Vertrauen und die Zufriedenheit der Benutzer verbessert werden. Beispielsweise kann ein Kundendienst-Chatbot TLM verwenden, um die Richtigkeit seiner Antworten zu überprüfen, bevor er sie einem Benutzer zur Verfügung stellt.

Datenextraktion

TLM kann verwendet werden, um die Genauigkeit der Datenextraktion aus unstrukturiertem Text zu verbessern. Durch die Bewertung der Vertrauenswürdigkeit der extrahierten Informationen können Benutzer Fehler identifizieren und korrigieren und so die Datenqualität sicherstellen. Beispielsweise kann ein Unternehmen TLM verwenden, um Schlüsselinformationen aus Verträgen zu extrahieren und die Richtigkeit der extrahierten Daten zu überprüfen, bevor es diese verwendet.

Agentenbasierte Systeme

TLM kann in agentenbasierte Systeme integriert werden, um die Zuverlässigkeit der Aktionen und Entscheidungen der Agenten sicherzustellen. Durch die Bewertung der Vertrauenswürdigkeit der Ausgaben der Agenten können Entwickler verhindern, dass Agenten Aktionen auf der Grundlage falscher Informationen ausführen. Beispielsweise kann ein Finanzhandelsagent TLM verwenden, um die Richtigkeit von Marktdaten zu überprüfen, bevor er Trades ausführt.

Ja/Nein-Entscheidungsfindung

TLM kann angewendet werden, um die Genauigkeit von Ja/Nein-Entscheidungsprozessen zu verbessern. Durch die Bewertung der Vertrauenswürdigkeit der Antworten des LLM können Benutzer fundiertere Entscheidungen auf der Grundlage zuverlässiger Informationen treffen. Beispielsweise kann ein medizinisches Diagnosetool TLM verwenden, um die Vertrauenswürdigkeit der Diagnose des LLM zu beurteilen, bevor es sie einem Arzt zur Verfügung stellt.

Wer profitiert von Cleanlab

KI-Entwickler

KI-Entwickler profitieren von TLM, indem sie ein Tool erhalten, mit dem sie die Zuverlässigkeit und Genauigkeit ihrer LLM-basierten Anwendungen verbessern können. Sie können TLM verwenden, um die mit LLM-Halluzinationen verbundenen Risiken zu identifizieren und zu mindern und sicherzustellen, dass ihre Anwendungen vertrauenswürdige Informationen liefern und eine bessere Benutzererfahrung bieten.

Data Scientists

Data Scientists können TLM nutzen, um die Qualität der aus LLMs extrahierten Daten zu verbessern. Durch die Bewertung der Vertrauenswürdigkeit von LLM-Ausgaben können Data Scientists die Genauigkeit ihrer Datensätze und Modelle verbessern, was zu zuverlässigeren Erkenntnissen und besseren Entscheidungen führt. Dies ist besonders nützlich für Aufgaben wie Datenannotation und Informationsabruf.

Führungskräfte

Führungskräfte können TLM verwenden, um Vertrauen in ihre KI-gestützten Produkte und Dienstleistungen aufzubauen. Durch die Sicherstellung der Zuverlässigkeit von LLM-Antworten können sie die Kundenzufriedenheit verbessern, das Risiko von Fehlinformationen verringern und sich einen Wettbewerbsvorteil verschaffen. Dies ist entscheidend für Anwendungen, die sensible Informationen oder kritische Entscheidungsfindung beinhalten.

Preise für Cleanlab

Preisdetails sind in der bereitgestellten Dokumentation nicht verfügbar. Bitte besuchen Sie die Cleanlab-Website, um aktuelle Preispläne zu erhalten.