The GenAI evaluation and observability platform

GenAI-Evaluierungsplattform

Freemium

Unterstützte Plattformen

web

Was ist The GenAI evaluation and observability platform

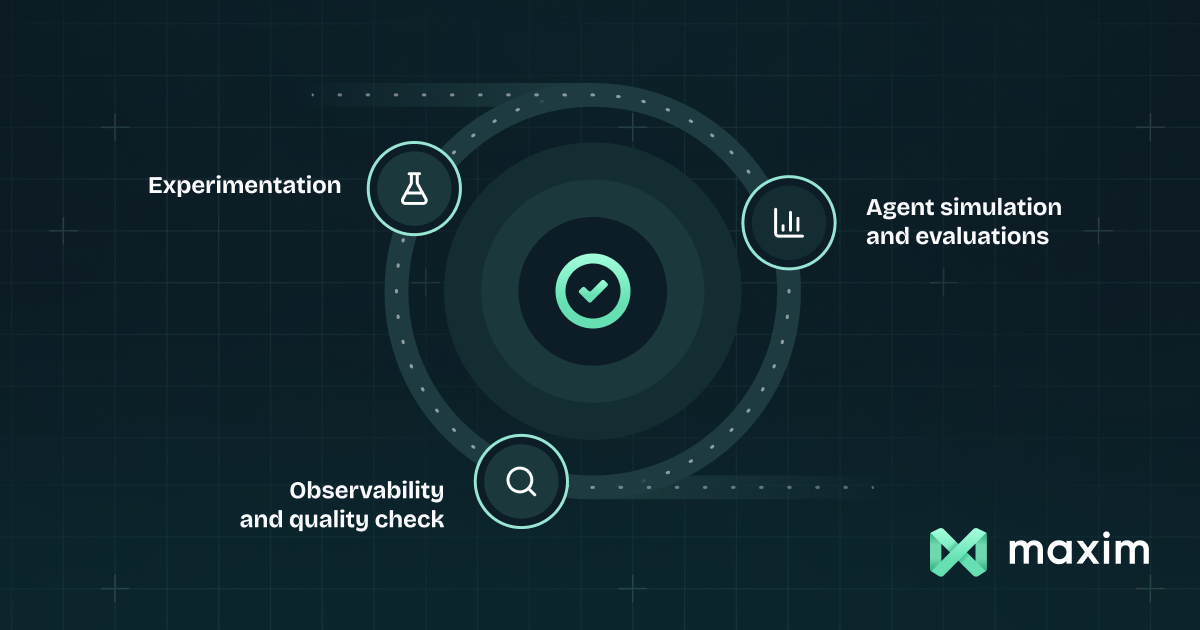

Maxim ist eine Plattform zur Evaluierung und Beobachtung von Anwendungen der generativen KI. Sie bietet Werkzeuge für umfassende Tests, Leistungsüberwachung und Fehlerbehebung von KI-Modellen. Im Gegensatz zu generischen Überwachungslösungen konzentriert sich Maxim speziell auf die einzigartigen Herausforderungen von GenAI und bietet Funktionen wie promptbasiertes Testen, Bewertung der Ausgabequalität und Analyse des Modellverhaltens. Die Plattform nutzt fortschrittliche Techniken für die automatisierte Evaluierung und liefert detaillierte Einblicke in die Modellleistung, einschließlich Latenz, Genauigkeit und Kosten. Maxim kommt KI-Ingenieuren, ML-Forschern und Produktmanagern zugute, indem es die Entwicklung und den Einsatz zuverlässiger und leistungsstarker GenAI-Anwendungen rationalisiert. Es hilft Benutzern, Probleme zu identifizieren und zu lösen, die Modellleistung zu optimieren und die Qualität KI-gestützter Produkte sicherzustellen.

Hauptfunktionen von The GenAI evaluation and observability platform

Automatisierte Evaluierungspipelines

Maxim automatisiert den Prozess der Evaluierung von GenAI-Modellen, indem es Benutzern ermöglicht, umfassende Testsuiten zu definieren und auszuführen. Dies beinhaltet die Unterstützung verschiedener Evaluierungsmetriken wie Genauigkeit, Relevanz und Toxizität. Benutzer können Pipelines so konfigurieren, dass Tests nach einem Zeitplan ausgeführt oder basierend auf Ereignissen ausgelöst werden, wodurch eine kontinuierliche Überwachung und eine schnelle Identifizierung von Leistungsregressionen gewährleistet werden. Diese Funktion reduziert den manuellen Aufwand und verbessert die Effizienz der Modellvalidierung.

Promptbasiertes Testen

Maxim bietet erweiterte promptbasierte Testfunktionen, mit denen Benutzer die Antworten von GenAI-Modellen auf verschiedene Prompts und Eingaben evaluieren können. Benutzer können Prompt-Bibliotheken erstellen und verwalten, verschiedene Prompt-Varianten testen und die Auswirkungen von Prompt-Engineering auf Modellausgaben analysieren. Diese Funktion ist entscheidend, um zu verstehen, wie sich Modelle unter verschiedenen Bedingungen verhalten, und um Prompts zu optimieren, um die gewünschten Ergebnisse zu erzielen. Es unterstützt A/B-Tests von Prompts.

Bewertung der Ausgabequalität

Die Plattform bietet Werkzeuge zur Bewertung der Qualität von GenAI-Modellausgaben, einschließlich Metriken für Flüssigkeit, Kohärenz und faktische Genauigkeit. Maxim unterstützt sowohl automatisierte als auch Human-in-the-Loop-Evaluierungsmethoden, sodass Benutzer die Geschwindigkeit automatisierter Tests mit dem differenzierten Urteilsvermögen menschlicher Gutachter kombinieren können. Dies stellt sicher, dass die Ausgaben die erforderlichen Qualitätsstandards erfüllen und auf den beabsichtigten Anwendungsfall abgestimmt sind.

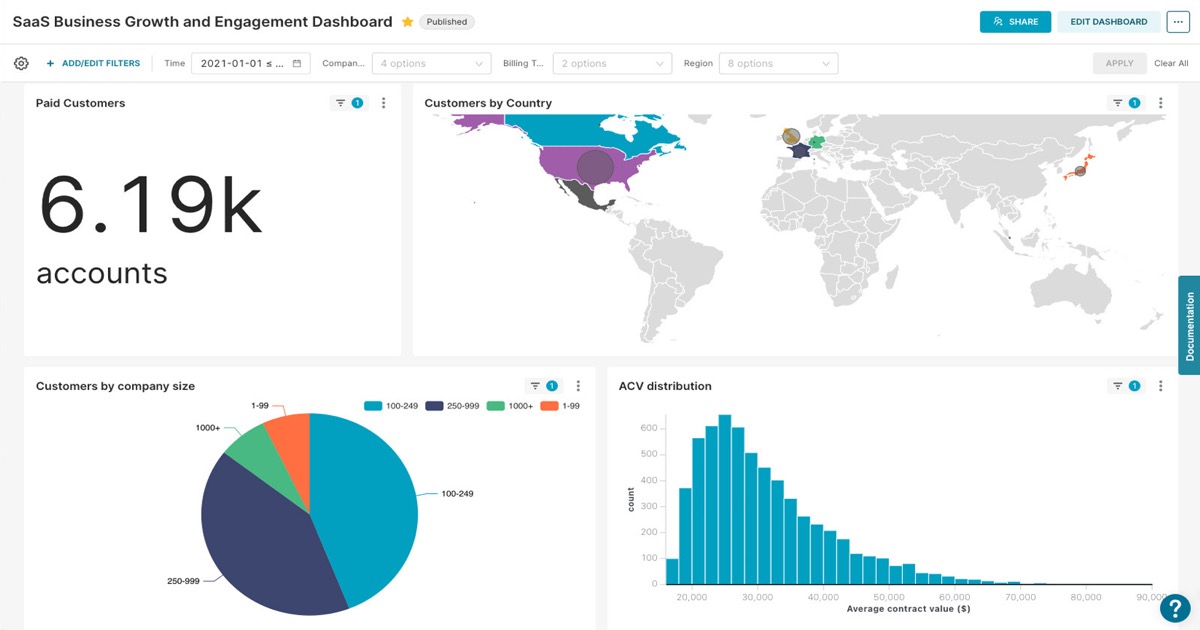

Echtzeit-Observability-Dashboard

Das Observability-Dashboard von Maxim bietet eine Echtzeitüberwachung von GenAI-Anwendungen und zeigt wichtige Leistungskennzahlen (KPIs) wie Latenz, Fehlerraten und Kosten an. Das Dashboard ermöglicht es Benutzern, die Modellleistung im Zeitverlauf zu verfolgen, Anomalien zu identifizieren und Probleme schnell zu beheben. Es lässt sich in verschiedene Protokollierungs- und Überwachungstools integrieren und bietet eine einheitliche Sicht auf den Zustand und die Leistung der Anwendung.

Modellverhaltensanalyse

Maxim bietet Werkzeuge zur Analyse des Verhaltens von GenAI-Modellen, einschließlich der Identifizierung von Verzerrungen, dem Verständnis von Entscheidungsprozessen des Modells und der Erkennung potenzieller Schwachstellen. Benutzer können diese Werkzeuge verwenden, um Einblicke in die Art und Weise zu gewinnen, wie Modelle Ausgaben generieren, und um sicherzustellen, dass sie mit ethischen Richtlinien und regulatorischen Anforderungen übereinstimmen. Diese Funktion ist wichtig für den Aufbau vertrauenswürdiger und verantwortungsvoller KI-Anwendungen.

Zusammenarbeit und Reporting

Maxim erleichtert die Zusammenarbeit zwischen Teammitgliedern, indem es Benutzern ermöglicht, Evaluierungsergebnisse, Dashboards und Berichte auszutauschen. Die Plattform unterstützt die rollenbasierte Zugriffskontrolle, um sicherzustellen, dass sensible Daten geschützt sind. Benutzer können benutzerdefinierte Berichte erstellen, um Ergebnisse an Stakeholder zu kommunizieren, den Fortschritt im Zeitverlauf zu verfolgen und den Wert ihrer GenAI-Anwendungen zu demonstrieren. Diese Funktion verbessert die Teamkommunikation und Entscheidungsfindung.

Wie man The GenAI evaluation and observability platform verwendet

- Melden Sie sich auf der Maxim-Website für ein kostenloses Konto an.,2. Integrieren Sie das Maxim SDK in Ihre GenAI-Anwendung (unterstützt Python, JavaScript und mehr).,3. Definieren Sie Evaluierungsmetriken und Testfälle, die für die Ziele Ihrer Anwendung relevant sind (z. B. Genauigkeit, Flüssigkeit, Kohärenz).,4. Führen Sie Evaluierungen durch, um die Modellleistung anhand Ihrer definierten Metriken zu bewerten und Berichte und Erkenntnisse zu generieren.,5. Überwachen Sie die Leistung Ihrer GenAI-Anwendung in Echtzeit über das Observability-Dashboard von Maxim.,6. Analysieren Sie die Ergebnisse, identifizieren Sie Verbesserungspotenziale und iterieren Sie über Ihr Modell oder Ihre Prompts.

Anwendungsfälle von The GenAI evaluation and observability platform

Evaluierung der LLM-Leistung

KI-Ingenieure verwenden Maxim, um die Leistung verschiedener LLMs (z. B. GPT-3, Llama) für bestimmte Aufgaben wie Texterstellung, Zusammenfassung oder Fragenbeantwortung zu evaluieren. Sie definieren Testfälle, messen die Genauigkeit und vergleichen die Ergebnisse, um das beste Modell für ihre Anwendung auszuwählen und sowohl die Leistung als auch die Kosten zu optimieren.

Überwachung der Chatbot-Qualität

Produktmanager verwenden Maxim, um die Qualität eines Kundenservice-Chatbots zu überwachen. Sie richten automatisierte Tests ein, um die Fähigkeit des Chatbots zu bewerten, Kundenfragen genau und effizient zu beantworten. Die Plattform liefert Echtzeit-Einblicke in die Leistung des Chatbots, sodass sie Probleme schnell identifizieren und beheben können.

Erkennung von Verzerrungen in KI-Modellen

Forscher verwenden Maxim, um GenAI-Modelle auf Verzerrungen zu analysieren. Sie erstellen Testfälle, die potenzielle Verzerrungen in den Ausgaben des Modells aufdecken. Maxim hilft ihnen, diese Verzerrungen zu identifizieren und zu quantifizieren, sodass sie Korrekturmaßnahmen ergreifen können, um Fairness und ethische Aspekte zu verbessern.

Optimierung des Prompt-Engineerings

Prompt-Ingenieure verwenden Maxim, um verschiedene Prompts für ein Texterstellungsmodell per A/B-Test zu testen. Sie messen die Auswirkungen jedes Prompts auf die Ausgabequalität des Modells, z. B. Relevanz und Kohärenz. Dies hilft ihnen, die effektivsten Prompts für ihren spezifischen Anwendungsfall zu identifizieren und die Gesamtleistung des Modells zu verbessern.

Wer profitiert von The GenAI evaluation and observability platform

KI-Ingenieure

KI-Ingenieure benötigen Maxim, um GenAI-Modelle zu evaluieren, zu überwachen und zu debuggen und sicherzustellen, dass sie Leistungs- und Qualitätsstandards erfüllen. Die Plattform rationalisiert den Entwicklungsprozess und ermöglicht es Ingenieuren, schneller zu iterieren und zuverlässige KI-Anwendungen bereitzustellen.

ML-Forscher

ML-Forscher verwenden Maxim, um das Modellverhalten zu analysieren, Verzerrungen zu identifizieren und Experimente durchzuführen. Die Plattform bietet Werkzeuge für eine eingehende Evaluierung und Berichterstattung und hilft Forschern, Einblicke in die Modellleistung zu gewinnen und ihre Forschungsergebnisse zu verbessern.

Produktmanager

Produktmanager nutzen Maxim, um die Leistung von GenAI-gestützten Funktionen und Produkten zu überwachen. Sie verwenden die Plattform, um wichtige Metriken zu verfolgen, Probleme zu identifizieren und sicherzustellen, dass die KI-Komponenten die Erwartungen der Benutzer und die Geschäftsziele erfüllen.

Prompt-Ingenieure

Prompt-Ingenieure verwenden Maxim, um Prompts für verschiedene GenAI-Modelle zu testen und zu optimieren. Die Plattform ermöglicht es ihnen, verschiedene Prompts per A/B-Test zu testen, ihre Auswirkungen auf Modellausgaben zu messen und Prompts zu verfeinern, um die gewünschten Ergebnisse zu erzielen und die Gesamteffektivität der KI-Anwendungen zu verbessern.

Preise für The GenAI evaluation and observability platform

Kostenloser Plan verfügbar. Kontaktieren Sie den Vertrieb für individuelle Preise und Enterprise-Pläne.