One API

Vereinheitlichte API für LLMs

Freemium

Unterstützte Plattformen

web

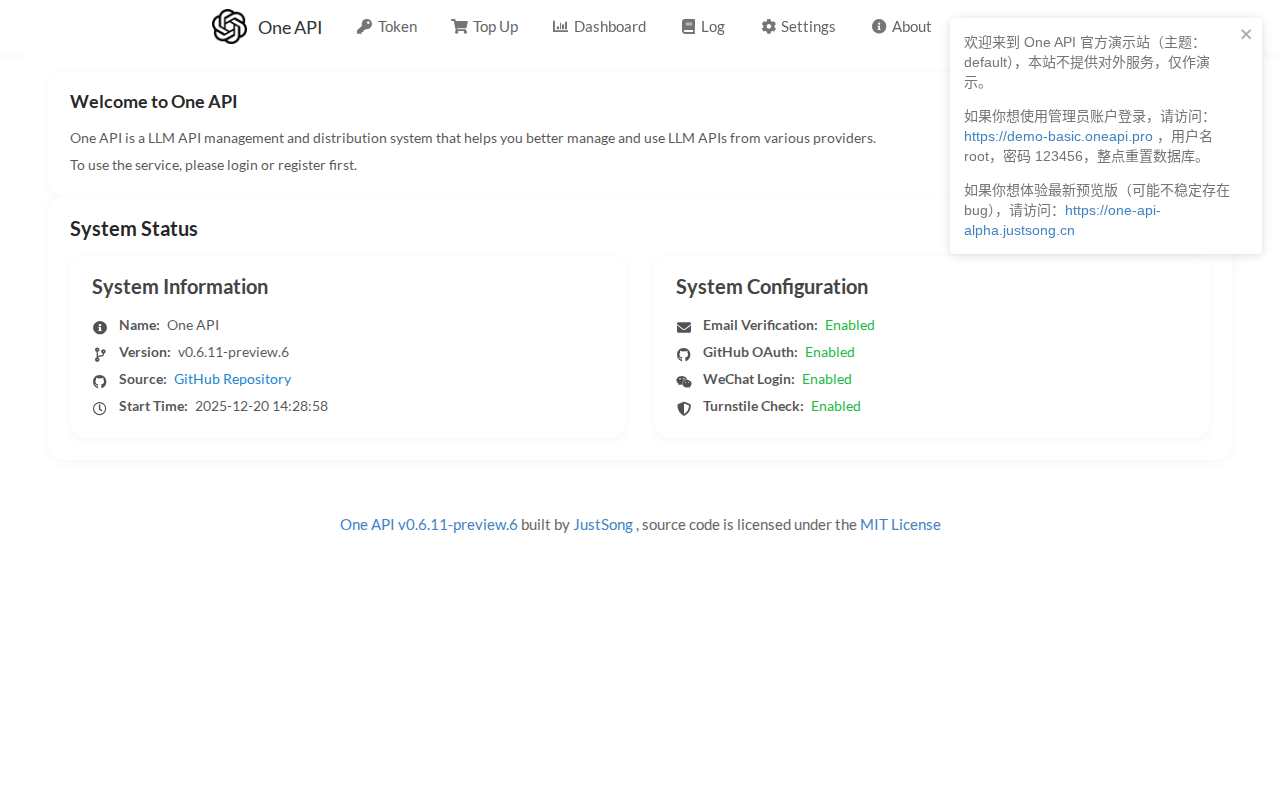

Was ist One API

Eine API bietet eine einheitliche Schnittstelle für den Zugriff auf verschiedene Large Language Models (LLMs). Sie vereinfacht die Integration verschiedener LLMs in Anwendungen, indem sie die Komplexität einzelner API-Endpunkte und Authentifizierungsmethoden abstrahiert. Dies ermöglicht Entwicklern den einfachen Wechsel zwischen Modellen, die Kostenverwaltung und die Implementierung von Funktionen wie Load Balancing und Rate Limiting. Im Gegensatz zu direkten API-Integrationen bietet One API zentrales Management, Überwachung und Versionskontrolle. Sie verwendet eine Proxy-Architektur, um Anfragen an den entsprechenden LLM-Anbieter weiterzuleiten und unterstützt Modelle von OpenAI, Cohere und anderen. Dies ist besonders vorteilhaft für Entwickler, Forscher und Unternehmen, die KI-gestützte Anwendungen entwickeln möchten, ohne an einen einzelnen LLM-Anbieter gebunden zu sein.

Hauptfunktionen von One API

Vereinheitlichte API-Schnittstelle

Bietet einen einzigen, konsistenten API-Endpunkt für den Zugriff auf mehrere LLMs. Dies vereinfacht die Integration und reduziert den Code, der zum Wechseln zwischen Modellen benötigt wird. Beispielsweise kann ein Entwickler mit einer einfachen Konfigurationsänderung von GPT-3.5 zu GPT-4 wechseln, ohne die Kernanwendungslogik zu ändern. Diese Abstraktionsebene behandelt auch Unterschiede in Anfrageformaten und Antwortstrukturen.

Modellwechsel & Routing

Ermöglicht den einfachen Wechsel zwischen verschiedenen LLMs basierend auf Leistung, Kosten oder Verfügbarkeit. Es leitet Anfragen intelligent an das am besten geeignete Modell weiter und optimiert dabei Faktoren wie Latenz und Token-Preise. Dies ermöglicht A/B-Tests verschiedener Modelle und die dynamische Zuweisung von Ressourcen. Die Routing-Logik kann basierend auf verschiedenen Kriterien wie Anfragengröße oder Benutzerstandort angepasst werden.

Kostenmanagement & Optimierung

Bietet Tools zur Überwachung und Kontrolle der LLM-Nutzungskosten. Zu den Funktionen gehören Kostenverfolgung, Budgetierung und Rate Limiting. Benutzer können Ausgabenlimits festlegen und Benachrichtigungen erhalten, wenn sie sich ihrem Budget nähern. Die Plattform bietet auch Funktionen wie intelligentes Caching und Request Batching, um die Kosten zu senken. Detaillierte Analysen liefern Einblicke in Nutzungsmuster der Modelle.

Zentrale Authentifizierung

Vereinfacht die Authentifizierung durch die Verwaltung von API-Schlüsseln und Zugangsdaten für alle unterstützten LLMs an einem einzigen Ort. Dies reduziert das Risiko der Offenlegung sensibler Informationen und rationalisiert den Authentifizierungsprozess. Es unterstützt verschiedene Authentifizierungsmethoden, einschließlich API-Schlüsseln, OAuth und benutzerdefinierten Authentifizierungsschemata. Speichert und verwaltet alle API-Schlüssel sicher.

Überwachung und Analyse

Bietet Echtzeitüberwachung der API-Nutzung, Leistungsmetriken und Fehlerraten. Bietet detaillierte Analyse-Dashboards zur Verfolgung von Anfragevolumen, Latenz und Kosten pro Modell. Dies ermöglicht es Benutzern, Engpässe zu identifizieren, die Leistung zu optimieren und Probleme schnell zu beheben. Anpassbare Dashboards und Alarmfunktionen sind verfügbar.

Wie man One API verwendet

Leider zeigt die bereitgestellte URL nur einen Platzhalter. Ohne weitere Informationen kann keine detaillierte Anleitung erstellt werden. Basierend auf der Produktbeschreibung würden die allgemeinen Schritte jedoch wahrscheinlich Folgendes umfassen: 1. Melden Sie sich für ein Konto an. 2. Erhalten Sie API-Schlüssel für die gewünschten LLM-Anbieter (z. B. OpenAI). 3. Konfigurieren Sie die One API-Plattform mit Ihren API-Schlüsseln. 4. Verwenden Sie die One API-Endpunkte in Ihrer Anwendung, um Anfragen an die LLMs zu stellen. 5. Überwachen Sie die Nutzung und verwalten Sie die Kosten über das One API-Dashboard.

Anwendungsfälle von One API

KI-Chatbot-Entwicklung

Entwickler, die Chatbots erstellen, können One API verwenden, um auf verschiedene LLMs wie GPT-3.5 oder GPT-4 zuzugreifen. Sie können einfach zwischen Modellen wechseln, um die Antwortqualität, die Kosten oder die Latenz zu optimieren. Dies ermöglicht schnelles Prototyping und A/B-Tests verschiedener LLM-Konfigurationen, was zu einer besseren Benutzererfahrung führt.

Inhaltsgenerierung

Content-Ersteller können One API nutzen, um Artikel, Zusammenfassungen und Social-Media-Beiträge mit verschiedenen LLMs zu generieren. Sie können die Ausgaben verschiedener Modelle vergleichen und die beste Lösung für ihre Bedürfnisse auswählen. Dies rationalisiert den Content-Erstellungsprozess und ermöglicht das Experimentieren mit verschiedenen Schreibstilen.

Anwendungsintegration

Softwareentwickler können LLMs in ihre Anwendungen integrieren, um Funktionen wie Natural Language Processing, Textzusammenfassung und Stimmungsanalyse bereitzustellen. One API vereinfacht den Integrationsprozess durch die Bereitstellung einer einheitlichen Schnittstelle, wodurch Entwicklungszeit und -komplexität reduziert werden. Dies ermöglicht es Entwicklern, sich auf die Erstellung von Funktionen zu konzentrieren, anstatt API-Integrationen zu verwalten.

Forschung und Experimente

Forscher können One API verwenden, um mit verschiedenen LLMs zu experimentieren und deren Leistung bei verschiedenen Aufgaben zu vergleichen. Sie können einfach zwischen Modellen wechseln, Nutzungsmetriken verfolgen und die Ergebnisse analysieren. Dies erleichtert die Forschung zu LLM-Fähigkeiten und hilft, die besten Modelle für bestimmte Anwendungen zu identifizieren.

Wer profitiert von One API

KI-Anwendungsentwickler

Entwickler, die Anwendungen erstellen, die LLMs verwenden. Sie benötigen eine vereinfachte Möglichkeit, auf mehrere LLMs zuzugreifen und diese zu verwalten, ohne sich mit den Komplexitäten einzelner API-Integrationen, Authentifizierung und Kostenmanagement auseinandersetzen zu müssen.

Forscher und Datenwissenschaftler

Forscher und Datenwissenschaftler, die mit verschiedenen LLMs für ihre Projekte experimentieren müssen. Sie profitieren von der Möglichkeit, einfach zwischen Modellen zu wechseln, Leistungsmetriken zu verfolgen und die Kosten effektiv zu verwalten.

Unternehmen und Startups

Unternehmen und Startups, die KI in ihre Produkte oder Dienstleistungen integrieren möchten. Sie benötigen eine kostengünstige und skalierbare Lösung für den Zugriff auf und die Verwaltung von LLMs, damit sie sich auf ihr Kerngeschäft konzentrieren können.

Unternehmen

Große Unternehmen, die mehrere LLMs über verschiedene Teams und Projekte hinweg verwalten müssen. Sie benötigen zentrale Kontrolle, Kostenoptimierung und robuste Überwachungsfunktionen, um eine effiziente und sichere LLM-Nutzung zu gewährleisten.

Preise für One API

Preisdetails sind von der bereitgestellten URL nicht verfügbar. Es handelt sich wahrscheinlich um ein Freemium-Modell mit einem kostenlosen Tarif für die Basisanwendung und kostenpflichtigen Tarifen für höhere Anfragelimits und erweiterte Funktionen. Wenden Sie sich an den Anbieter, um spezifische Preise zu erhalten.