Langfa

KI-gestützte Sprachmodell-API

Freemium

Unterstützte Plattformen

web

Was ist Langfa

Langfa bietet eine robuste API für die Interaktion mit großen Sprachmodellen. Sie vereinfacht die Integration fortschrittlicher KI-Funktionen in Anwendungen, indem sie eine einheitliche Schnittstelle zu verschiedenen Modellen bietet. Im Gegensatz zu Plattformen, die sich ausschließlich auf das Modelltraining oder die Bereitstellung konzentrieren, legt Langfa Wert auf Benutzerfreundlichkeit und Zugänglichkeit und abstrahiert die Komplexität der Modellauswahl, -verwaltung und -optimierung. Dies ermöglicht es Entwicklern, schnell mit verschiedenen Modellen zu experimentieren, Prompts zu optimieren und KI-Funktionen zu integrieren, ohne tiefgreifende Fachkenntnisse im Bereich Machine Learning zu haben. Es ist ideal für Entwickler und Unternehmen, die ihren Produkten Natural Language Processing, Texterstellung und andere KI-gestützte Funktionen hinzufügen möchten, um das Benutzerengagement zu verbessern und Arbeitsabläufe zu automatisieren.

Hauptfunktionen von Langfa

Vereinheitlichte API für mehrere Modelle

Langfa bietet einen einzigen API-Endpunkt, der verschiedene Sprachmodelle unterstützt, darunter GPT-3.5, GPT-4 und andere. Diese Abstraktion vereinfacht die Modellauswahl und den Wechsel, sodass Entwickler problemlos mit verschiedenen Modellen experimentieren können, ohne ihren Code wesentlich zu ändern. Dieser einheitliche Ansatz reduziert die Integrationszeit und ermöglicht eine dynamische Modellauswahl basierend auf Leistungs- oder Kostenaspekten. Die API verarbeitet automatisch modellspezifische Nuancen und gewährleistet konsistente Ergebnisse.

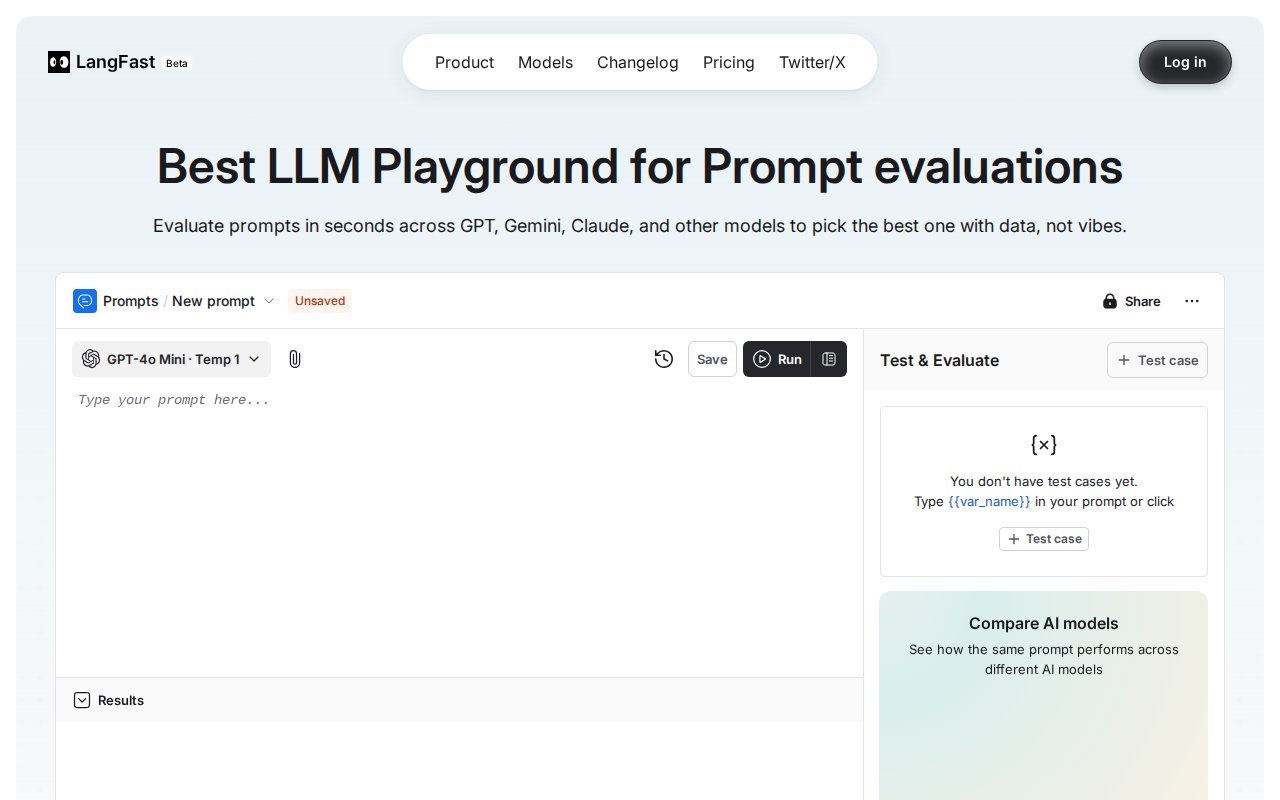

Prompt Engineering Tools

Bietet integrierte Tools zur Prompt-Optimierung und A/B-Tests. Benutzer können Prompts innerhalb der Langfa-Plattform erstellen, speichern und verwalten. Die Plattform ermöglicht den Vergleich der Ausgaben verschiedener Prompts und misst Metriken wie Kohärenz, Relevanz und Sentiment-Werte. Diese Funktion hilft Benutzern, ihre Prompts zu verfeinern, um optimale Ergebnisse von den Sprachmodellen zu erzielen und die Qualität der generierten Inhalte und die Benutzerzufriedenheit zu verbessern.

Echtzeit-Nutzungsanalysen

Bietet detaillierte Analysen zur API-Nutzung, einschließlich Anforderungszählungen, Token-Nutzung und Latenzmetriken. Das Dashboard bietet Einblicke, welche Modelle am häufigsten verwendet werden, wie die Leistung verschiedener Prompts ist und welche Gesamtkosten mit API-Aufrufen verbunden sind. Diese Daten ermöglichen es Benutzern, ihre Ausgaben zu überwachen, potenzielle Engpässe zu identifizieren und ihre Nutzungsmuster für Kosteneffizienz und Leistungsverbesserungen zu optimieren.

Modellversionierung und Rollback

Unterstützt die Modellversionierung, sodass Benutzer eine bestimmte Modellversion für ihre API-Aufrufe angeben können. Dies gewährleistet die Konsistenz und Reproduzierbarkeit der Ergebnisse, auch wenn Modelle aktualisiert werden. Im Falle unerwarteten Verhaltens oder einer Leistungsminderung können Benutzer problemlos zu einer früheren Version zurückkehren. Diese Funktion ist entscheidend für die Aufrechterhaltung der Stabilität von Anwendungen, die sich auf Sprachmodelle verlassen.

Ratenbegrenzung und Kostenkontrolle

Implementiert eine Ratenbegrenzung, um Missbrauch zu verhindern und Kosten effektiv zu verwalten. Benutzer können Limits für die Anzahl der Anfragen pro Minute oder pro Tag festlegen. Die Plattform bietet auch Tools zur Kostenschätzung, mit denen Benutzer die mit ihrer API-Nutzung verbundenen Ausgaben basierend auf dem Modell, der Prompt-Länge und anderen Parametern vorhersagen können. Dies hilft Benutzern, innerhalb ihres Budgets zu bleiben und unerwartete Gebühren zu vermeiden.

Wie man Langfa verwendet

- Melden Sie sich für ein Langfa-Konto unter langfa.st an, um einen API-Schlüssel zu erhalten.,2. Installieren Sie den Langfa Python-Client mit

pip install langfa.,3. Importieren Sie den Langfa-Client und initialisieren Sie ihn mit Ihrem API-Schlüssel:from langfa import Langfa; client = Langfa(api_key="YOUR_API_KEY").,4. Verwenden Sie die Methodeclient.generate()und übergeben Sie einen Prompt und Modellparameter (z. B. Modellname, Temperatur):response = client.generate(prompt="Schreibe eine Kurzgeschichte über eine Katze.", model="gpt-3.5-turbo", temperature=0.7).,5. Verarbeiten Sie die Antwort:print(response.text), um den generierten Text anzuzeigen.,6. Entdecken Sie erweiterte Funktionen wie Prompt Engineering, Modellvergleich und Nutzungsanalysen über das Langfa-Dashboard.

Anwendungsfälle von Langfa

Inhaltsgenerierung

Content-Ersteller können Langfa verwenden, um Artikel, Blogbeiträge und Social-Media-Updates zu generieren. Sie geben ein Thema oder eine Zusammenfassung ein, und die API generiert Text, wodurch Zeit und Aufwand gespart werden. Beispielsweise kann ein Marketingteam schnell mehrere Variationen von Werbetexten für A/B-Tests erstellen und so die Kampagnenleistung verbessern.

Chatbot-Entwicklung

Entwickler können Langfa in Chatbots integrieren, um ihre Konversationsfähigkeiten zu verbessern. Benutzer können ansprechendere und reaktionsfähigere Chatbots erstellen, die komplexe Benutzeranfragen verstehen und beantworten. Dies verbessert den Kundenservice und die Benutzererfahrung, da der Chatbot eine größere Bandbreite an Interaktionen bewältigen kann.

Zusammenfassung und Textanalyse

Unternehmen können Langfa nutzen, um lange Dokumente zusammenzufassen, Schlüsselinformationen zu extrahieren und Stimmungsanalysen durchzuführen. Rechtsteams können es verwenden, um Verträge schnell zu überprüfen, und Finanzanalysten können Ergebnisberichte zusammenfassen. Dies verbessert die Effizienz und Entscheidungsfindung.

Code-Generierung und Dokumentation

Softwareentwickler können Langfa verwenden, um Code-Snippets und Dokumentationen aus Beschreibungen in natürlicher Sprache zu generieren. Sie können die gewünschte Funktionalität beschreiben, und die API generiert den Code, wodurch die Entwicklungszeit verkürzt und die Codequalität verbessert wird. Dies ist besonders nützlich für das Rapid Prototyping und die Automatisierung sich wiederholender Aufgaben.

Wer profitiert von Langfa

Softwareentwickler

Entwickler profitieren von der einfach zu integrierenden API von Langfa, mit der sie ihren Anwendungen schnell KI-gestützte Funktionen hinzufügen können. Sie können sich auf den Aufbau ihres Kernprodukts konzentrieren, anstatt komplexe Modellintegrationen zu verwalten. Dies beschleunigt die Entwicklungszyklen und reduziert den Bedarf an spezialisiertem KI-Know-how.

Content-Ersteller

Content-Ersteller können ihren Workflow optimieren, indem sie Langfa verwenden, um verschiedene Arten von Inhalten zu generieren, von Artikeln bis hin zu Social-Media-Beiträgen. Die Prompt-Engineering-Tools der Plattform helfen ihnen, die Inhaltsqualität zu optimieren und sie auf ihre spezifischen Bedürfnisse zuzuschneiden, wodurch Zeit gespart und die Ausgabe verbessert wird.

Unternehmen

Unternehmen können den Kundenservice verbessern, die Inhaltserstellung automatisieren und mithilfe von Langfa Erkenntnisse aus Daten gewinnen. Die API ermöglicht es ihnen, Chatbots zu erstellen, Dokumente zusammenzufassen und Stimmungsanalysen durchzuführen, was zu mehr Effizienz und besserer Entscheidungsfindung führt.

Forscher

Forscher können Langfa verwenden, um mit verschiedenen Sprachmodellen und Prompts für ihre Studien zu experimentieren. Die Analyse- und Versionsverwaltungsfunktionen der Plattform liefern wertvolle Daten und gewährleisten die Reproduzierbarkeit, was den Forschungsprozess erleichtert und robustere Ergebnisse ermöglicht.

Preise für Langfa

Kostenlose Stufe mit begrenzter Nutzung verfügbar. Bezahlte Tarife bieten erhöhte Anfragelimits, vorrangigen Support und Zugriff auf erweiterte Funktionen. Detaillierte Preisinformationen finden Sie auf der Website.