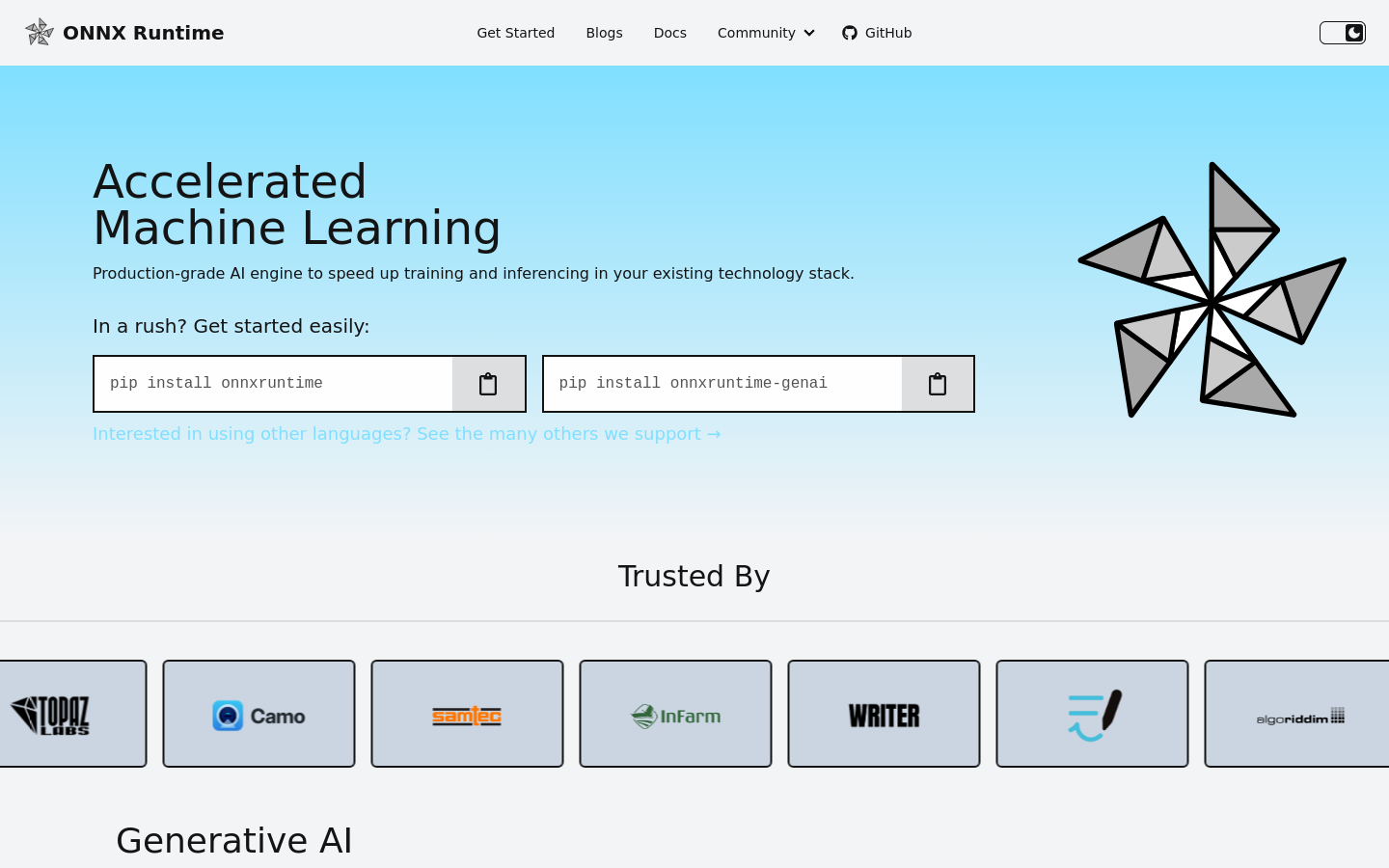

ONNX Runtime

Un motor de aprendizaje automático multiplataforma para la inferencia de modelos

Freemium

Plataformas soportadas

web

Etiquetas de herramienta

Qué es ONNX Runtime

ONNX Runtime es un motor de IA de nivel de producción diseñado para resolver el cuello de botella común que supone optimizar modelos de aprendizaje automático para diversos entornos de hardware y software. Al proporcionar una interfaz unificada para el entrenamiento y la inferencia, permite a los equipos desplegar modelos en CPUs, GPUs y NPUs sin sacrificar el rendimiento. Tanto si trabaja con modelos de lenguaje extensos (LLMs) como con modelos predictivos estándar, este motor garantiza que sus aplicaciones mantengan una baja latencia y un alto rendimiento, independientemente de la infraestructura subyacente. Diseñado para ofrecer flexibilidad, el runtime admite una amplia gama de lenguajes de programación —incluidos Python, C#, C++, Java, JavaScript y Rust—, lo que lo convierte en una opción versátil para pilas tecnológicas complejas. Cierra la brecha entre el desarrollo y la producción, permitiendo a los desarrolladores mantener un comportamiento consistente del modelo en Linux, Windows, macOS, plataformas móviles y navegadores web. Al optimizar la ejecución de modelos de última generación, permite a los ingenieros centrarse en crear funciones inteligentes en lugar de solucionar problemas de compatibilidad de hardware o degradación del rendimiento.

Funciones principales de ONNX Runtime

Aceleración de hardware

Optimiza el rendimiento en cuanto a latencia, caudal y uso de memoria en una amplia gama de hardware, incluyendo CPUs, GPUs y NPUs, asegurando que sus modelos se ejecuten de manera eficiente en cualquier dispositivo.

Soporte multiplataforma

Proporciona una compatibilidad robusta en los principales sistemas operativos como Linux, Windows y macOS, así como en plataformas móviles y navegadores web, permitiendo una estrategia de IA verdaderamente portátil.

Soporte multilingüe

Ofrece integración nativa para desarrolladores que utilizan Python, C#, C++, Java, JavaScript y Rust, facilitando la incorporación de IA de alto rendimiento en pilas tecnológicas diversas y existentes.

Integración de IA generativa

Permite el despliegue de modelos de lenguaje extensos (LLMs) de última generación, soportando tareas avanzadas como la generación de texto y la síntesis de imágenes directamente dentro de sus aplicaciones de producción.

Cómo usar ONNX Runtime

- Comience instalando el paquete del runtime a través de su gestor de paquetes preferido, como 'pip install onnxruntime' o 'pip install onnxruntime-genai', para configurar su entorno.

- Inicialice el runtime pasando la ruta del archivo de su modelo de aprendizaje automático a la clase 'InferenceSession', la cual prepara el motor para ejecutar su modelo específico.

- Formatee sus datos de entrada en la estructura de tensor requerida, asegurándose de que se ajusten al esquema de entrada esperado por el modelo para evitar errores de ejecución durante el procesamiento.

- Ejecute el modelo llamando al método 'session.run' con sus datos de entrada preparados, lo que activará el motor para generar predicciones o resultados de manera eficiente.

- Revise los resultados devueltos por la sesión para integrar sin problemas las predicciones del modelo en su flujo de trabajo de aplicación o lógica de servicio existente.

Casos de uso de ONNX Runtime

Despliegue de IA en el borde (Edge AI)

Los desarrolladores pueden desplegar modelos de IA de alto rendimiento en dispositivos con recursos limitados, como teléfonos móviles o hardware IoT, aprovechando configuraciones de runtime optimizadas.

Servicio de modelos en producción

Los ingenieros pueden servir modelos de aprendizaje automático de forma fiable en entornos de producción, asegurando que las aplicaciones de los usuarios finales se beneficien de una baja latencia y un alto rendimiento.

Desarrollo de aplicaciones multiplataforma

Los equipos que crean aplicaciones para múltiples plataformas pueden utilizar un único runtime unificado para mantener un rendimiento de IA consistente en entornos de escritorio, móviles y web.

Quién se beneficia de ONNX Runtime

Ingenieros de aprendizaje automático

Profesionales centrados en optimizar la velocidad de inferencia de modelos y la eficiencia de los recursos para garantizar que sus aplicaciones de IA cumplan con los estándares de rendimiento de nivel de producción.

Desarrolladores de software

Desarrolladores que integran IA en aplicaciones a través de varios lenguajes y que necesitan un motor de ejecución fiable y de alto rendimiento que se adapte a su pila tecnológica existente.