Ultralytics

Motor de visión artificial

Freemium

Plataformas soportadas

web

Etiquetas de herramienta

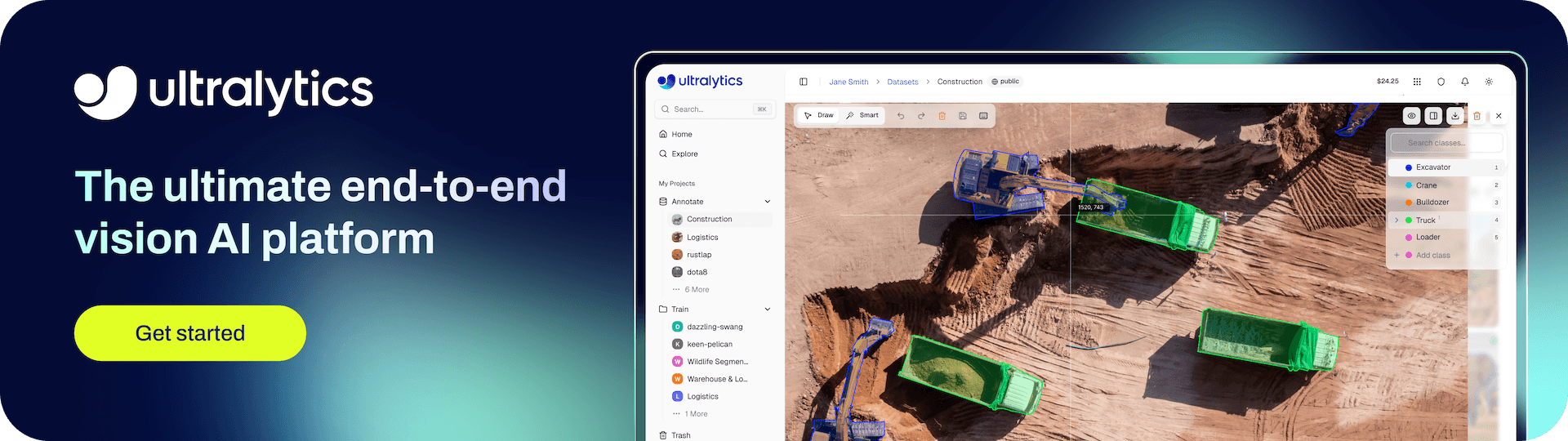

Qué es Ultralytics

Ultralytics YOLO es un framework estándar en la industria para detección, segmentación y clasificación de objetos en tiempo real. A diferencia de las librerías de CV fragmentadas, ofrece una API unificada que abstrae arquitecturas de modelos complejas (YOLOv8, YOLOv11, NAS) en una interfaz simple de Python. Se diferencia por su optimización extrema para dispositivos edge, permitiendo la exportación a TensorRT, CoreML y ONNX. El framework está diseñado para desarrolladores e investigadores que necesitan pasar de prototipos a pipelines de inferencia de grado de producción sin reescribir código, ofreciendo un alto rendimiento tanto en entornos CPU como GPU.

Funciones principales de Ultralytics

Arquitectura de API unificada

Ultralytics proporciona una API consistente y orientada a objetos en todas las versiones de modelos. Esto elimina la necesidad de aprender nueva sintaxis al cambiar entre tareas de detección, segmentación o estimación de pose. Al estandarizar los flujos de entrenamiento, validación y predicción, los desarrolladores pueden reducir el código repetitivo hasta en un 70% en comparación con implementaciones personalizadas de PyTorch, asegurando ciclos de iteración más rápidos en entornos de producción.

Soporte de exportación multiplataforma

El framework admite más de 10 formatos de exportación, incluyendo TensorRT, CoreML, TFLite y ONNX. Esto permite a los desarrolladores entrenar modelos en GPUs NVIDIA de alta gama y desplegarlos sin problemas en dispositivos edge con recursos limitados como Raspberry Pi, teléfonos móviles o sistemas embebidos. La utilidad de exportación maneja automáticamente la cuantización y la optimización de grafos, asegurando una latencia mínima durante la inferencia.

Motor de inferencia de alto rendimiento

Diseñado para la velocidad, el motor de Ultralytics logra tiempos de inferencia de sub-milisegundos en hardware moderno. Al aprovechar kernels CUDA optimizados y una gestión de memoria eficiente, supera a las implementaciones estándar de PyTorch. Esto lo hace adecuado para el procesamiento de video en tiempo real a más de 60 FPS, crítico para aplicaciones como robótica autónoma, monitoreo de tráfico y control de calidad industrial donde la latencia es una restricción primaria.

Pipeline avanzado de aumento de datos

Incluye un pipeline de aumento altamente configurable que aplica transformaciones de mosaico, mixup y geométricas sobre la marcha durante el entrenamiento. Esto mejora significativamente la robustez y generalización del modelo, reduciendo la necesidad de conjuntos de datos manuales masivos. Al automatizar estos pasos de preprocesamiento complejos, los desarrolladores pueden alcanzar puntuaciones mAP (precisión media) de vanguardia con conjuntos de entrenamiento más pequeños y diversos.

Zoo de modelos escalable

Proporciona una biblioteca integral de modelos preentrenados que van desde 'Nano' (n) para dispositivos edge hasta 'Extra Large' (x) para tareas de alta precisión en servidores. Esta escalabilidad permite a los equipos elegir el equilibrio óptimo entre velocidad y precisión para sus restricciones de hardware específicas. Cada modelo está preentrenado en el conjunto de datos COCO, proporcionando una base sólida para el aprendizaje por transferencia en datos específicos de dominio.

Cómo usar Ultralytics

Instale la librería mediante pip: 'pip install ultralytics'.,Importe la clase YOLO en su script de Python: 'from ultralytics import YOLO'.,Cargue un modelo preentrenado: 'model = YOLO("yolo11n.pt")'.,Ejecute la inferencia en una fuente de imagen o video: 'results = model.predict("source.jpg")'.,Acceda a los resultados de detección mediante el objeto results para extraer cajas delimitadoras, máscaras o probabilidades de clase.,Exporte su modelo entrenado para despliegue usando 'model.export(format="onnx")' para una inferencia de producción optimizada.

Casos de uso de Ultralytics

Control de calidad industrial

Las empresas manufactureras utilizan Ultralytics para detectar defectos superficiales en líneas de ensamblaje en tiempo real. Al desplegar modelos YOLO en cámaras edge, logran la identificación instantánea de componentes defectuosos, reduciendo el desperdicio y asegurando una cobertura de inspección del 100% sin intervención humana.

Robótica autónoma

Los ingenieros en robótica integran YOLO para la detección de objetos y conciencia espacial en tiempo real. El framework permite a los robots identificar obstáculos, navegar entornos e interactuar con objetos, proporcionando la retroalimentación visual de baja latencia necesaria para una operación autónoma segura y eficiente.

Monitoreo de ciudades inteligentes

Los sistemas de gestión de tráfico utilizan el framework para analizar transmisiones de video para el conteo de vehículos, detección de matrículas y seguridad peatonal. La inferencia de alto rendimiento permite que un solo servidor procese múltiples flujos de cámara simultáneamente, proporcionando datos accionables para la planificación urbana.

Quién se beneficia de Ultralytics

Ingenieros de visión artificial

Necesitan desplegar modelos listos para producción rápidamente. Ultralytics proporciona las herramientas para pasar de la investigación al despliegue sin la sobrecarga de construir pipelines de inferencia personalizados desde cero.

Desarrolladores de Edge AI

Se enfocan en desplegar modelos en hardware con cómputo limitado. Confían en las robustas funciones de exportación y cuantización de Ultralytics para mantener un alto rendimiento en dispositivos embebidos.

Científicos de datos

Requieren un framework confiable y bien documentado para la creación rápida de prototipos y experimentación. La facilidad de uso y la extensa documentación de Ultralytics les permiten probar hipótesis e iterar sobre conjuntos de datos de manera eficiente.

Precios de Ultralytics

Código abierto (licencia AGPL-3.0). Soporte empresarial y opciones de licencia comercial disponibles a través de Ultralytics HUB para despliegues en la nube gestionados.