GPTLocalhost

Acceso y cambio de LLM local

Gratis

Plataformas soportadas

web

Etiquetas de herramienta

Qué es GPTLocalhost

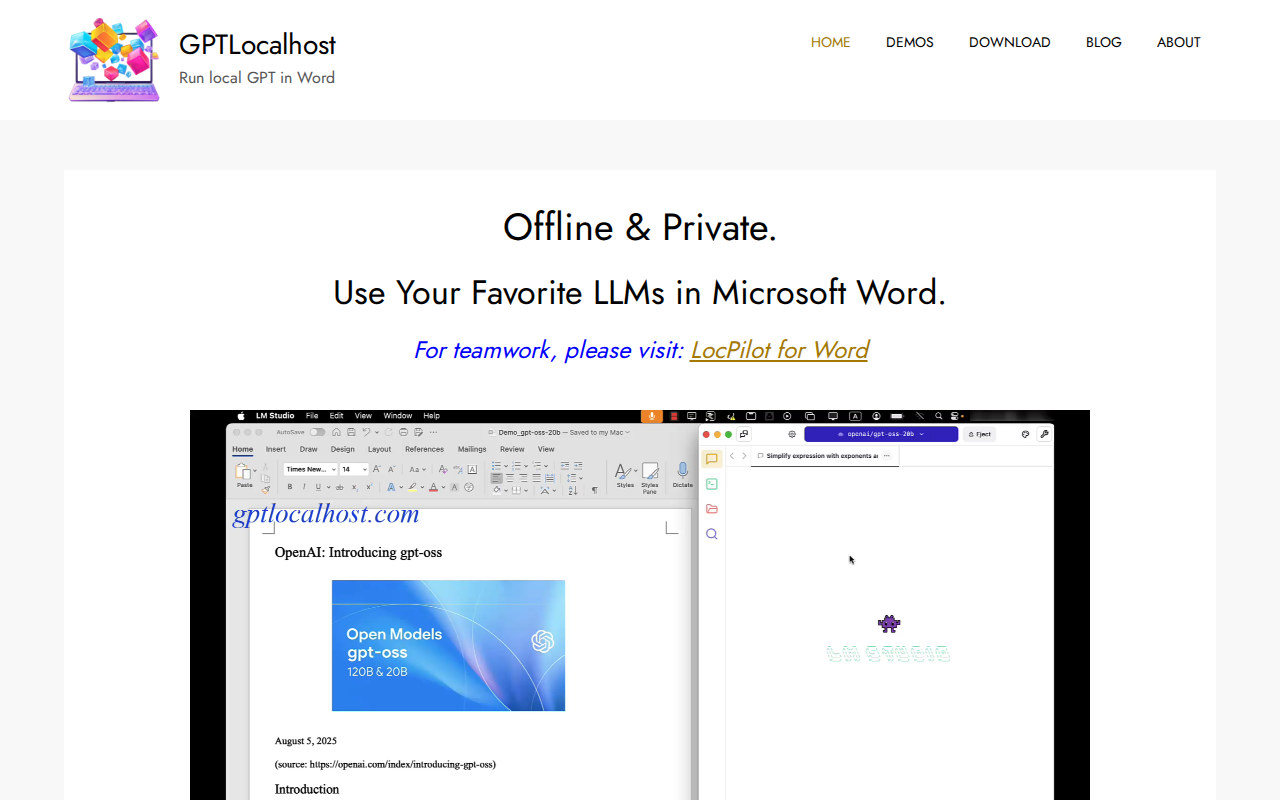

GPTLocalhost proporciona un entorno local para interactuar con Modelos de Lenguaje Grandes (LLM). Permite a los usuarios ejecutar y experimentar con varios LLM localmente, ofreciendo flexibilidad y control sobre sus interacciones de IA. A diferencia de las soluciones basadas en la nube, GPTLocalhost prioriza la privacidad y reduce la latencia al mantener los modelos en su máquina. La plataforma admite el cambio de modelo sin problemas, lo que permite a los usuarios comparar y contrastar diferentes LLM, como IBM Granite 4, para tareas como el análisis de contratos. Esto se logra a través de una interfaz fácil de usar y un proceso de instalación sencillo, lo que lo hace accesible tanto para desarrolladores como para investigadores. El beneficio principal es la capacidad de experimentar con LLM sin depender de API externas ni incurrir en costos de la nube, lo que lo hace ideal para quienes priorizan la privacidad de los datos y la creación rápida de prototipos.

Funciones principales de GPTLocalhost

Ejecución local de LLM

GPTLocalhost permite ejecutar LLM directamente en su máquina local, eliminando la necesidad de API basadas en la nube. Esto reduce significativamente la latencia, mejora la privacidad de los datos y minimiza los costos asociados con las llamadas API externas. Esto es particularmente beneficioso para datos confidenciales o aplicaciones que requieren respuestas en tiempo real. La ejecución local aprovecha los recursos de su máquina (CPU/GPU) para el procesamiento.

Cambio de modelo sin problemas

Cambie fácilmente entre diferentes LLM, como IBM Granite 4, para comparar el rendimiento y la idoneidad para diversas tareas. Esta función es crucial para la experimentación y la selección del modelo óptimo para un caso de uso específico. La plataforma proporciona una interfaz unificada para interactuar con diferentes modelos, simplificando el proceso de evaluación y permitiendo la creación rápida de prototipos.

Diseño centrado en la privacidad

Al ejecutar LLM localmente, GPTLocalhost garantiza que sus datos permanezcan privados y seguros. Esto es particularmente importante para aplicaciones que manejan información confidencial o que cumplen con estrictas regulaciones de privacidad de datos. El modelo de ejecución local elimina el riesgo de filtraciones de datos o acceso no autorizado asociado con las soluciones basadas en la nube.

Interfaz fácil de usar

GPTLocalhost ofrece una interfaz fácil de usar para interactuar con LLM, lo que la hace accesible tanto para desarrolladores como para usuarios no técnicos. La interfaz simplifica el proceso de envío de indicaciones, recepción de respuestas y gestión de diferentes modelos. Esta facilidad de uso acelera el proceso de experimentación y desarrollo.

Disponibilidad de demostraciones

Proporciona demostraciones disponibles que muestran las capacidades de GPTLocalhost. Estas demostraciones permiten a los usuarios comprender rápidamente la funcionalidad de la plataforma y los posibles casos de uso. Las demostraciones a menudo incluyen configuraciones preconfiguradas y ejemplos de indicaciones, lo que permite a los usuarios comenzar rápidamente sin una configuración extensa.

Cómo usar GPTLocalhost

- Visite el sitio web de GPTLocalhost y revise las demostraciones y la documentación disponibles.,2. Identifique el LLM específico que desea usar (por ejemplo, IBM Granite 4) y asegúrese de tener el acceso o las credenciales necesarias.,3. Siga las instrucciones de instalación proporcionadas en el sitio web para configurar GPTLocalhost en su máquina local.,4. Configure el LLM elegido dentro de GPTLocalhost, proporcionando cualquier clave API o rutas de modelo requeridas.,5. Use la interfaz o API proporcionada para interactuar con el LLM, enviando indicaciones y recibiendo respuestas.,6. Experimente con diferentes modelos cambiando entre ellos dentro del entorno GPTLocalhost para comparar el rendimiento.

Casos de uso de GPTLocalhost

Análisis de contratos

Los profesionales legales pueden usar GPTLocalhost con modelos como IBM Granite 4 para analizar contratos localmente. Pueden cargar documentos, identificar cláusulas clave y evaluar riesgos potenciales sin enviar datos confidenciales a servidores externos. Esto mejora la eficiencia y garantiza la privacidad de los datos durante los procesos de revisión de contratos.

Investigación y experimentación de IA

Los investigadores pueden aprovechar GPTLocalhost para experimentar con varios LLM, comparar su rendimiento y ajustar modelos para tareas específicas. Pueden probar diferentes indicaciones, evaluar la calidad de las respuestas e iterar en sus modelos de IA en un entorno local controlado, acelerando el ciclo de investigación.

Desarrollo local

Los desarrolladores pueden integrar LLM en sus aplicaciones sin depender de API externas. Pueden crear chatbots, herramientas de generación de contenido y otras funciones impulsadas por IA que se ejecutan localmente, reduciendo la latencia y mejorando la capacidad de respuesta. Este enfoque es ideal para aplicaciones sin conexión o aquellas que requieren alta seguridad de datos.

Cumplimiento de la privacidad de los datos

Las organizaciones que manejan datos confidenciales pueden usar GPTLocalhost para cumplir con las regulaciones de privacidad de datos. Al ejecutar LLM localmente, pueden garantizar que los datos nunca salgan de su entorno seguro, reduciendo el riesgo de filtraciones de datos y garantizando el cumplimiento del RGPD, HIPAA y otras regulaciones.

Quién se beneficia de GPTLocalhost

Investigadores de IA

Los investigadores se benefician de la capacidad de experimentar con diferentes LLM localmente, comparar su rendimiento y ajustar modelos sin las limitaciones de las API basadas en la nube. Esto permite una iteración más rápida y un mayor control sobre el proceso de investigación.

Desarrolladores

Los desarrolladores pueden integrar LLM en sus aplicaciones con mayor control sobre la privacidad de los datos y la latencia. GPTLocalhost les permite crear funciones impulsadas por IA que se ejecutan localmente, mejorando la capacidad de respuesta y reduciendo la dependencia de servicios externos.

Profesionales legales

Los profesionales legales pueden usar GPTLocalhost para analizar contratos y otros documentos legales localmente, garantizando la privacidad de los datos y reduciendo el riesgo de filtraciones de datos. Esto mejora la eficiencia y la seguridad durante el proceso de revisión de contratos.

Científicos de datos

Los científicos de datos pueden aprovechar GPTLocalhost para crear prototipos y probar soluciones basadas en LLM en un entorno seguro y controlado. La capacidad de cambiar entre modelos y ejecutarlos localmente acelera el desarrollo y la evaluación de aplicaciones de IA.

Precios de GPTLocalhost

Los detalles de precios no se mencionan explícitamente en la página de demostración proporcionada. Sin embargo, la naturaleza del producto sugiere un modelo gratuito o de código abierto, ya que se centra en la ejecución local y el cambio de modelo.

Más herramientas similares a GPTLocalhost

ChatGPT

ChatGPT es una herramienta avanzada de IA conversacional que genera respuestas de texto similares a las humanas.

Kimi

Kimi es un chatbot impulsado por IA diseñado para ayudar a los usuarios con diversas consultas y tareas.