Apache Airflow

Orquestación de Flujos Programáticos

Gratis

Plataformas soportadas

web

Etiquetas de herramienta

Qué es Apache Airflow

Apache Airflow es una plataforma para crear, programar y monitorear flujos de trabajo de forma programática. Permite a los usuarios definir pipelines como código Python, proporcionando flexibilidad y control sobre las tareas de procesamiento de datos. El valor principal de Airflow radica en su capacidad para orquestar flujos de trabajo complejos, asegurando que las tareas se ejecuten en el orden correcto y manejen las dependencias de manera efectiva. A diferencia de los trabajos cron tradicionales o la creación de scripts, Airflow ofrece una interfaz de usuario robusta para monitorear, registrar y administrar flujos de trabajo a escala. Su arquitectura modular y sus amplias integraciones con proveedores de la nube y servicios de terceros lo hacen adaptable a diversos entornos. Los ingenieros de datos, los científicos de datos y los equipos de DevOps se benefician de la capacidad de Airflow para automatizar y optimizar pipelines de datos, el entrenamiento de modelos de aprendizaje automático y la gestión de la infraestructura.

Funciones principales de Apache Airflow

Definición de Flujo de Trabajo Basada en Python

Airflow utiliza Python para definir flujos de trabajo (DAGs), lo que permite a los desarrolladores aprovechar todo el poder del ecosistema Python. Esto incluye el uso de características estándar de Python como bucles, declaraciones condicionales y formatos de fecha/hora para la programación. Este enfoque proporciona flexibilidad y evita las limitaciones de las definiciones de flujo de trabajo basadas en la línea de comandos o XML, lo que permite la generación dinámica de pipelines y la implementación de lógica compleja.

Arquitectura Escalable y Modular

El diseño modular de Airflow le permite escalar para manejar una gran cantidad de tareas concurrentes. Utiliza una cola de mensajes (por ejemplo, Celery, RabbitMQ) para orquestar los trabajadores, lo que permite el escalado horizontal agregando más nodos de trabajadores. Esta arquitectura asegura que Airflow pueda administrar flujos de trabajo complejos con numerosas dependencias y altos volúmenes de datos, lo que lo hace adecuado para implementaciones a nivel empresarial.

Interfaz de Usuario Web Robusta

Airflow proporciona una interfaz de usuario web fácil de usar para monitorear, programar y administrar flujos de trabajo. La interfaz de usuario ofrece actualizaciones de estado de tareas en tiempo real, registros detallados y la capacidad de activar, pausar y reintentar tareas. Esta interfaz centralizada simplifica la gestión del flujo de trabajo, proporciona información sobre el rendimiento del pipeline y reduce la necesidad de intervención manual, mejorando la eficiencia operativa.

Integraciones Extensas

Airflow ofrece una amplia gama de operadores preconstruidos para la integración con varios servicios, incluyendo Google Cloud Platform, Amazon Web Services, Microsoft Azure y muchas herramientas de terceros. Estos operadores simplifican el proceso de ejecución de tareas en diferentes plataformas, reduciendo la necesidad de scripts personalizados y acelerando el desarrollo de pipelines de datos y otros flujos de trabajo.

Generación Dinámica de Pipelines

Airflow permite la generación dinámica de pipelines a través de código Python. Esto significa que puede escribir código que instancia pipelines dinámicamente, basándose en datos u otros parámetros. Esta característica es particularmente útil para manejar tareas recurrentes, procesar datos de múltiples fuentes o crear pipelines que se adapten a los requisitos comerciales cambiantes, mejorando la flexibilidad y la automatización.

Código Abierto y Impulsado por la Comunidad

Airflow es un proyecto de código abierto con una comunidad vibrante. Esto significa que los usuarios pueden contribuir al proyecto, compartir sus experiencias y acceder a una gran cantidad de recursos y soporte. La naturaleza de código abierto fomenta la transparencia, la colaboración y la mejora continua, asegurando que Airflow siga siendo una plataforma de orquestación de flujos de trabajo potente y adaptable.

Cómo usar Apache Airflow

- Instale Airflow usando pip:

pip install apache-airflow. 2. Inicialice la base de datos de Airflow:airflow db init. 3. Cree un DAG (Grafo Acíclico Dirigido) en Python, definiendo las tareas y dependencias de su flujo de trabajo. 4. Coloque su archivo DAG en la carpetadagsdentro de su directorio de inicio de Airflow. 5. Inicie el servidor web y el programador de Airflow:airflow webserver -p 8080yairflow scheduler. 6. Acceda a la interfaz de usuario de Airflow en su navegador (generalmente enhttp://localhost:8080) para monitorear y administrar sus flujos de trabajo.

Casos de uso de Apache Airflow

Automatización de Pipelines de Datos

Los ingenieros de datos utilizan Airflow para automatizar el proceso ETL (Extract, Transform, Load). Definen DAGs para extraer datos de varias fuentes, transformarlos utilizando herramientas como Spark o Pandas y cargarlos en un data warehouse. Esto asegura que los datos se actualicen consistentemente y estén listos para el análisis, ahorrando tiempo y recursos.

Entrenamiento de Modelos de Aprendizaje Automático

Los científicos de datos utilizan Airflow para programar y gestionar el entrenamiento de modelos de aprendizaje automático. Crean DAGs para orquestar el preprocesamiento de datos, el entrenamiento de modelos, la evaluación y la implementación. Esto automatiza el ciclo de vida del ML, asegurando que los modelos se vuelvan a entrenar regularmente con los datos más recientes y se implementen de manera eficiente.

Gestión de Infraestructura

Los ingenieros de DevOps utilizan Airflow para automatizar tareas de infraestructura, como el aprovisionamiento de servidores, la implementación de aplicaciones y la gestión de recursos en la nube. Crean DAGs para orquestar estas tareas, asegurando que se ejecuten en el orden correcto y con las dependencias necesarias, mejorando la eficiencia operativa.

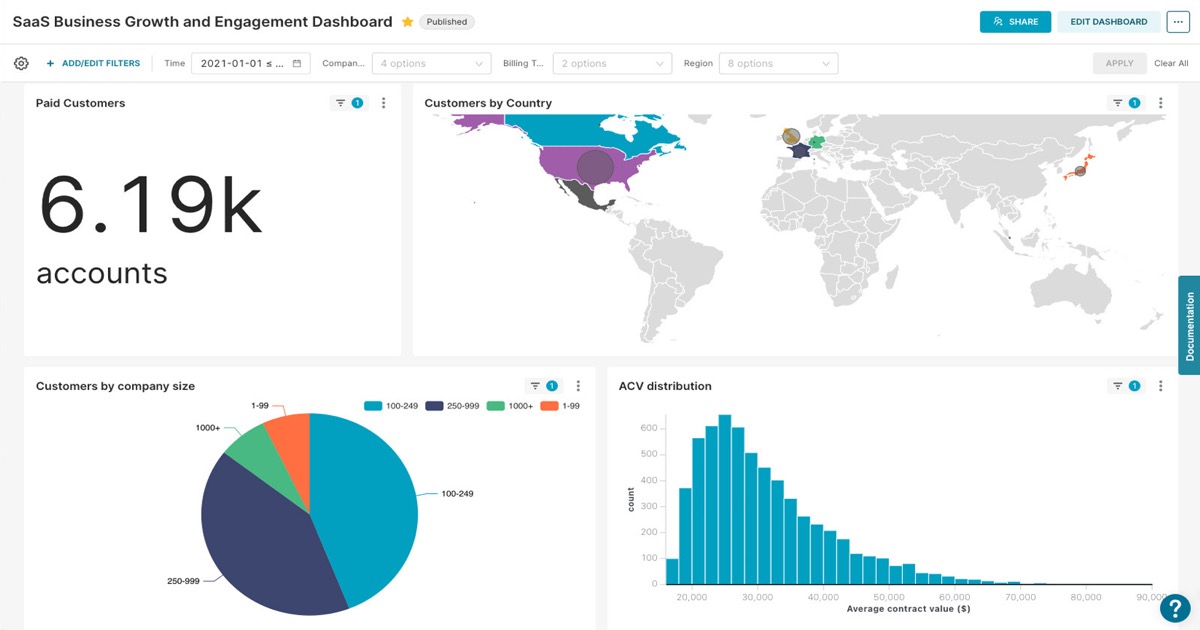

Informes y Análisis

Los analistas utilizan Airflow para automatizar la generación de informes y paneles. Definen DAGs para extraer datos de bases de datos, transformarlos y generar informes utilizando herramientas como SQL o scripts de Python. Esto asegura que los informes se generen en un horario regular y proporcionen información actualizada.

Quién se beneficia de Apache Airflow

Ingenieros de Datos

Los ingenieros de datos necesitan Airflow para construir y gestionar pipelines de datos. Lo utilizan para automatizar los procesos ETL, asegurando que los datos se transformen y carguen de manera eficiente. Las capacidades de programación y monitoreo de Airflow les ayudan a mantener la calidad de los datos y reducir la intervención manual.

Científicos de Datos

Los científicos de datos utilizan Airflow para automatizar el ciclo de vida del aprendizaje automático. Crean flujos de trabajo para el preprocesamiento de datos, el entrenamiento de modelos, la evaluación y la implementación. Esto les permite centrarse en el desarrollo y análisis de modelos en lugar de la orquestación manual.

Ingenieros de DevOps

Los ingenieros de DevOps utilizan Airflow para automatizar tareas de infraestructura. Crean flujos de trabajo para el aprovisionamiento de servidores, la implementación de aplicaciones y la gestión de recursos en la nube. Esto mejora la eficiencia operativa y reduce el riesgo de errores.

Analistas de Negocios

Los analistas de negocios utilizan Airflow para automatizar los procesos de informes y análisis. Crean flujos de trabajo para extraer datos, transformarlos y generar informes. Esto asegura que los informes se generen en un horario regular y proporcionen información actualizada.

Precios de Apache Airflow

Licencia Apache 2.0 (Código Abierto). De uso, modificación y distribución gratuitos.