AngelSlim

Implementación eficiente de modelos de lenguaje para modelos de lenguaje grandes

Veredicto

Ideal para Implementar modelos de lenguaje grandes en dispositivos con recursos limitados

AngelSlim es una herramienta de compresión de modelos de lenguaje diseñada para ayudar a los desarrolladores a implementar y comprender modelos de lenguaje grandes de manera eficiente

Ideal para

Ingenieros de machine learning y investigadores

Funciones clave

Cuantización

Decodificado especulativo

Poda

Actions

Share

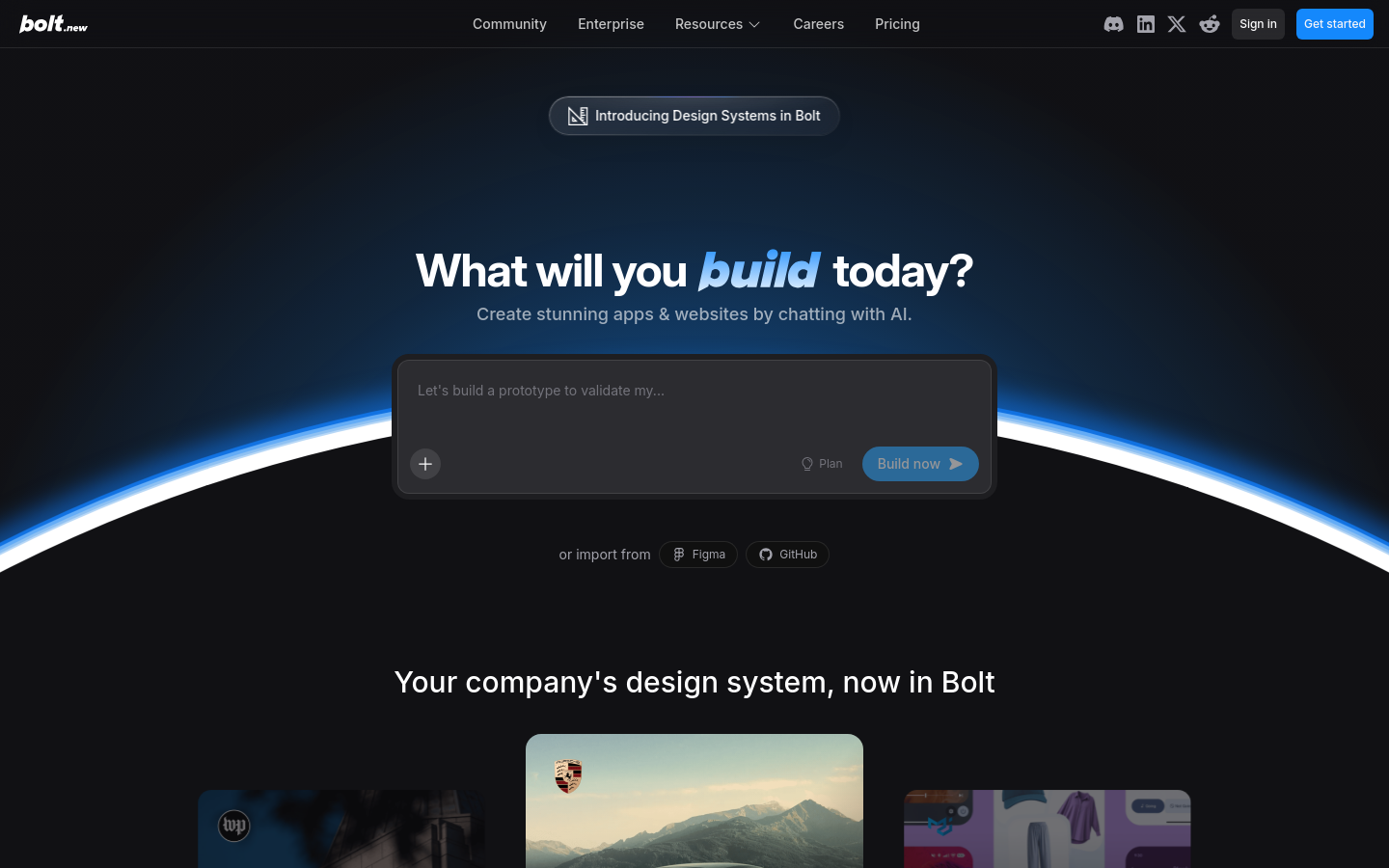

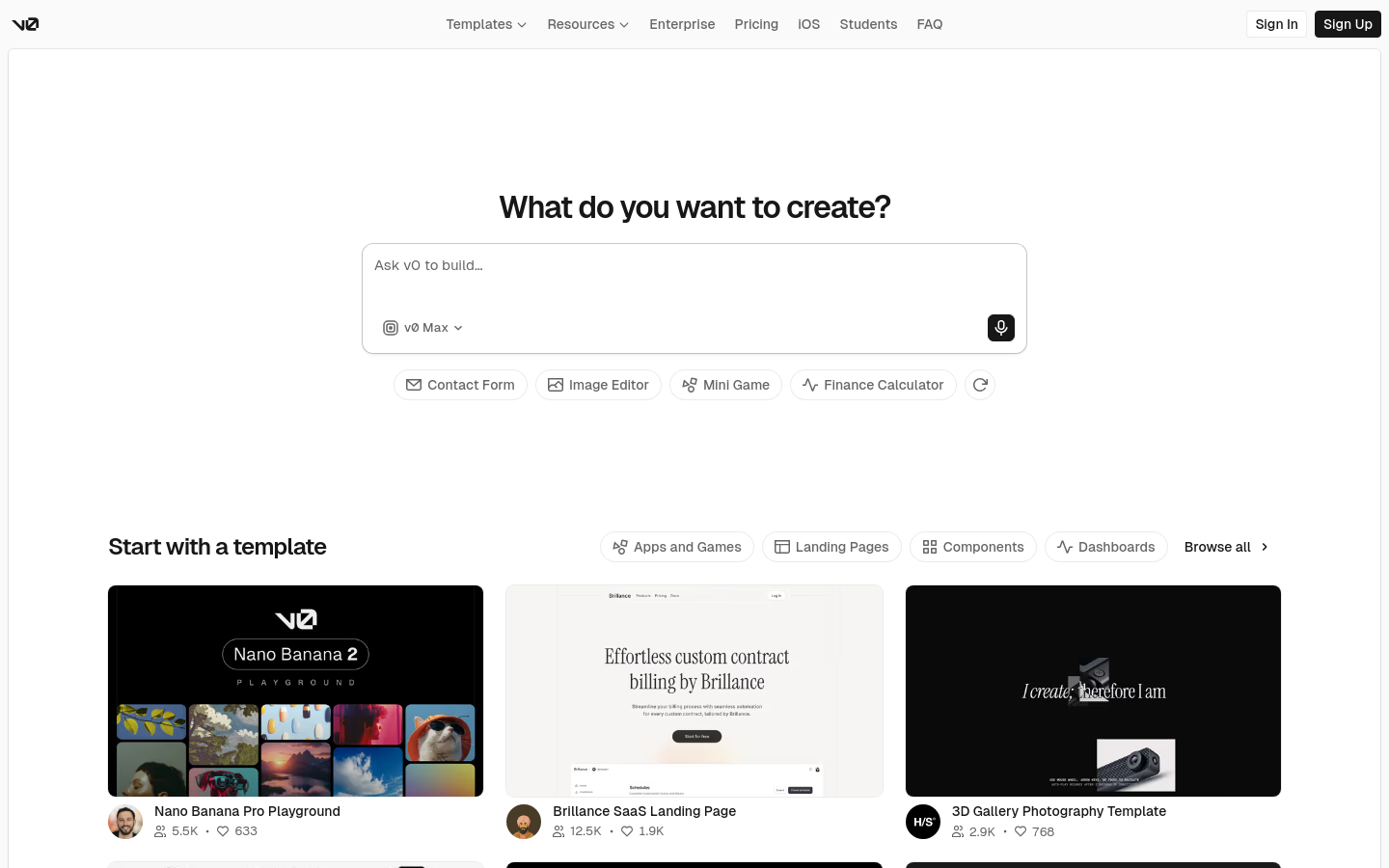

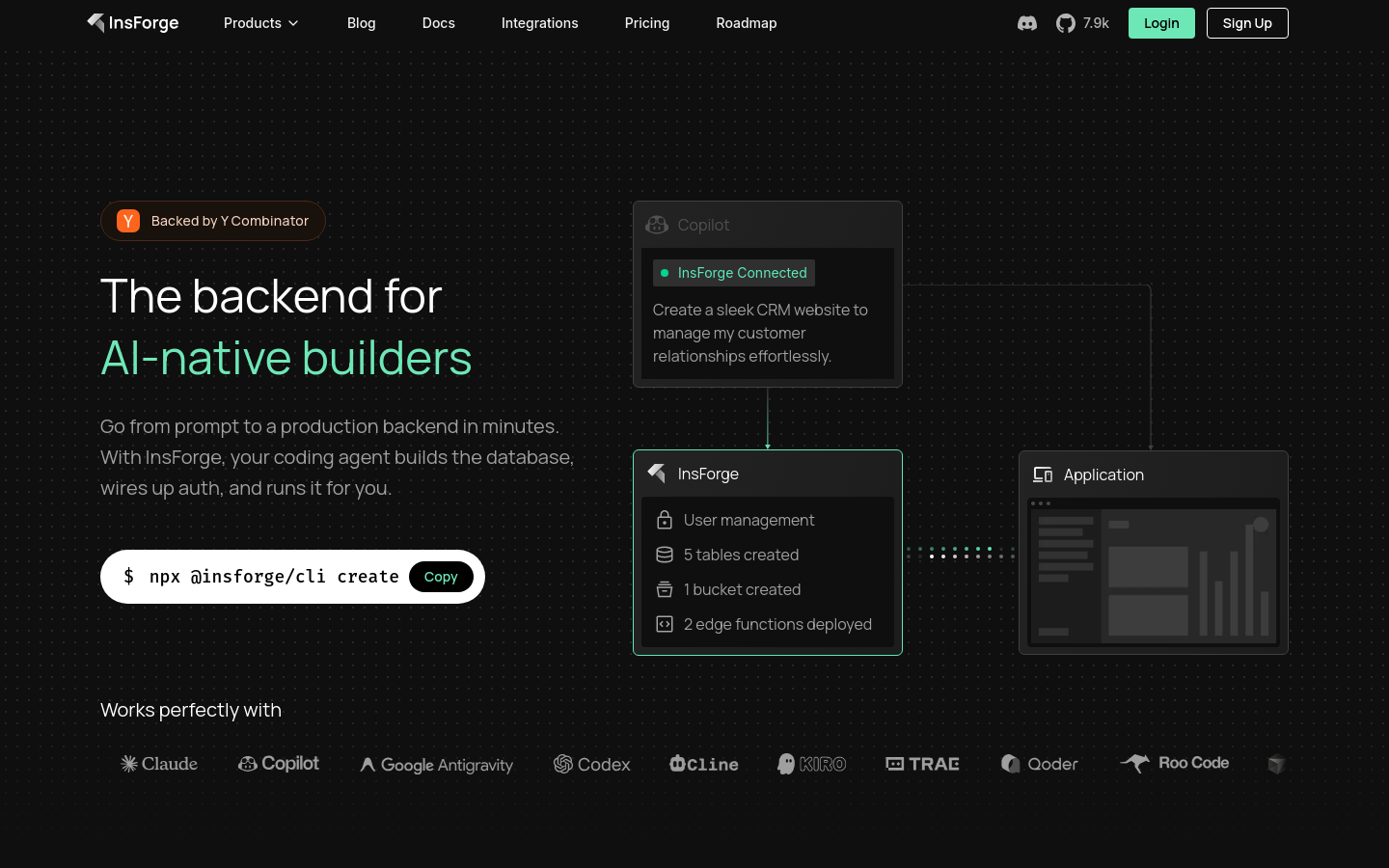

Capturas y demo de AngelSlim

Qué es AngelSlim

AngelSlim es una herramienta de compresión de modelos de lenguaje diseñada para ayudar a los desarrolladores a implementar y comprender modelos de lenguaje grandes de manera eficiente. Al aprovechar una variedad de algoritmos y técnicas de compresión, AngelSlim reduce el uso de memoria y mejora la eficiencia de implementación. Esta herramienta de código abierto es particularmente útil para ingenieros de machine learning y investigadores que trabajan con modelos de lenguaje grandes, permitiéndoles implementar modelos en dispositivos con recursos de memoria y computacionales limitados. Con AngelSlim, los desarrolladores pueden comprender y implementar modelos de lenguaje grandes para aplicaciones como asistentes de voz, chatbots y traducción de lenguaje. Al utilizar AngelSlim, los desarrolladores pueden reducir los requisitos de memoria y computacionales de sus modelos, mejorando la eficiencia de implementación y reduciendo costos. Los algoritmos y técnicas de compresión de AngelSlim, como la cuantización, el decodificado especulativo, la poda y la distilación, ayudan a los desarrolladores a lograr la implementación eficiente de modelos. Siguiendo el flujo de trabajo simplificado proporcionado por AngelSlim, los desarrolladores pueden comprender y implementar fácilmente sus modelos de lenguaje grandes, lo que la convierte en una herramienta esencial para cualquier equipo de machine learning.

Funciones principales de AngelSlim

Cuantización

Un algoritmo de compresión que reduce la precisión de los pesos del modelo para reducir el uso de memoria y mejorar la eficiencia de implementación

Decodificado especulativo

Una técnica que predice y completa valores faltantes en el modelo, reduciendo la necesidad de poda explícita y mejorando la eficiencia de compresión

Poda

Una técnica que elimina pesos del modelo innecesarios para reducir el uso de memoria y mejorar la eficiencia de implementación

Distilación

Una técnica que transfiere conocimiento de un modelo grande a un modelo más pequeño, reduciendo la necesidad de modelos grandes y mejorando la eficiencia de implementación

Cómo usar AngelSlim

- Visite el sitio web de documentación de AngelSlim en https://angelslim.readthedocs.io

- Explorar los algoritmos de compresión disponibles y elegir el que se adapte a sus necesidades

- Seguir el tutorial de instalación para configurar AngelSlim en su sistema

- Utilizar la herramienta para comprender y implementar sus modelos de lenguaje grandes

Casos de uso de AngelSlim

Implementar modelos de lenguaje grandes en dispositivos con recursos limitados

AngelSlim ayuda a los desarrolladores a comprender y implementar modelos de lenguaje grandes en dispositivos con recursos de memoria y computacionales limitados, permitiendo aplicaciones como asistentes de voz, chatbots y traducción de lenguaje

Mejorar la eficiencia de implementación de modelos

Los algoritmos y técnicas de compresión de AngelSlim ayudan a los desarrolladores a reducir los requisitos de memoria y computacionales de los modelos de lenguaje grandes, mejorando la eficiencia de implementación y reduciendo costos

Quién se beneficia de AngelSlim

Ingenieros de machine learning y investigadores

AngelSlim está diseñado para desarrolladores que trabajan con modelos de lenguaje grandes y quieren mejorar la eficiencia de implementación y reducir costos

Precios de AngelSlim

Código abierto, gratuito para usar y distribuir