Spawning

Respeta la exclusión de IA.

Gratis

Plataformas soportadas

web

Etiquetas de herramienta

Qué es Spawning

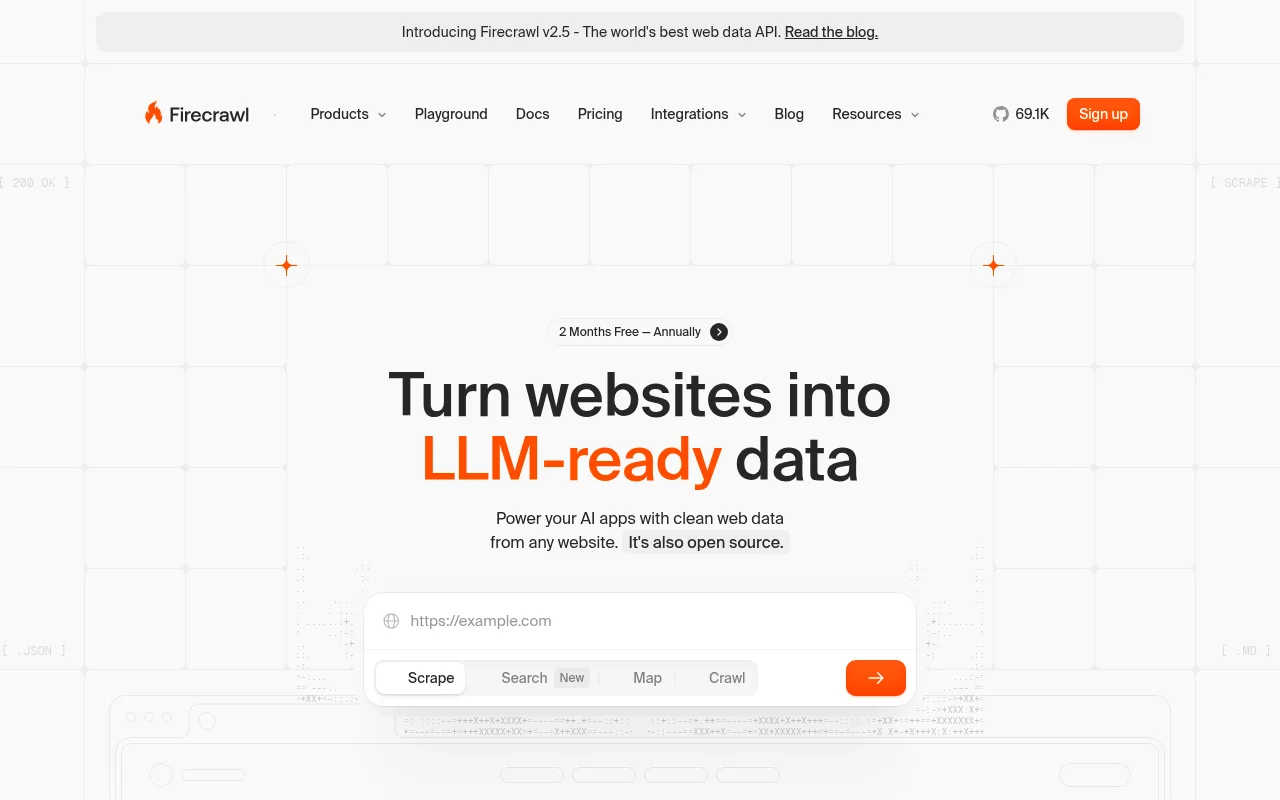

Have I Been Trained? es un servicio diseñado para ayudar a los entrenadores de IA a respetar las preferencias de las personas que no desean que sus datos se utilicen para el entrenamiento de modelos de IA. Proporciona un mecanismo para que las personas registren sus datos en un registro de 'No Entrenar'. Los entrenadores de IA pueden consultar este registro para evitar el uso de datos de aquellos que se han excluido. El servicio se encuentra actualmente en mantenimiento, pero su valor fundamental radica en la promoción del desarrollo ético de la IA y la privacidad del usuario. Se diferencia por centrarse específicamente en el aspecto de exclusión voluntaria, ofreciendo una solución dedicada para respetar las preferencias del usuario. La tecnología probablemente involucra una base de datos o registro que los entrenadores de IA pueden consultar. Esto beneficia a las personas preocupadas por el uso de sus datos sin consentimiento y a los entrenadores de IA que buscan construir modelos éticos y conformes.

Funciones principales de Spawning

Registro de No Entrenar

La característica principal es un registro centralizado donde las personas pueden registrar sus datos para optar por no participar en el entrenamiento de IA. Este registro actúa como una única fuente de verdad para los entrenadores de IA, simplificando el proceso de respeto a las preferencias del usuario. El registro probablemente utiliza una base de datos para almacenar y gestionar las solicitudes de exclusión voluntaria, garantizando búsquedas y actualizaciones eficientes. El formato de datos específico y los mecanismos de consulta no están especificados, pero la funcionalidad principal es clara.

Desarrollo ético de la IA

Promueve prácticas de IA responsables al dar a las personas control sobre sus datos. Esta característica es crucial para generar confianza y garantizar que los modelos de IA se desarrollen éticamente. Al respetar las preferencias del usuario, el servicio ayuda a prevenir el uso indebido de datos personales y se alinea con las regulaciones de privacidad emergentes como GDPR y CCPA. El impacto es medible en términos de confianza del usuario y reducción del riesgo legal para los entrenadores de IA.

Enfoque en la privacidad

Prioriza la privacidad del usuario al permitir que las personas controlen cómo se utilizan sus datos. Esta característica es esencial en una era donde la privacidad de los datos es una preocupación importante. El servicio proporciona un mecanismo para que las personas hagan valer su derecho a la privacidad, reduciendo el riesgo de filtraciones de datos y el uso no autorizado de datos. El diseño del servicio debe minimizar la recopilación y el almacenamiento de datos para mejorar aún más la privacidad.

Cumplimiento simplificado

Ayuda a los entrenadores de IA a cumplir con las regulaciones de privacidad de datos y las directrices éticas. Al proporcionar un mecanismo claro de exclusión voluntaria, el servicio simplifica el proceso de cumplimiento de regulaciones como GDPR y CCPA. Esto reduce los riesgos legales y de reputación asociados con el incumplimiento. La efectividad del servicio se puede medir por la reducción de los desafíos legales y la publicidad negativa para los entrenadores de IA.

Cómo usar Spawning

Actualmente, el servicio está en mantenimiento. Sin embargo, el flujo de trabajo previsto probablemente implicaría estos pasos:

- Las personas enviarían sus datos (o un enlace a ellos) al registro 'No Entrenar'.

- Los entrenadores de IA integrarían el servicio en sus pipelines de entrenamiento.

- Antes del entrenamiento, los entrenadores consultarían el registro con la fuente o el identificador de los datos.

- Si se encuentra una coincidencia, el entrenador excluiría esos datos del conjunto de entrenamiento.

- Los entrenadores de IA pueden comunicarse con [email protected] para obtener más información.

Casos de uso de Spawning

Protección de datos individuales

Una persona quiere evitar que sus datos disponibles públicamente (por ejemplo, publicaciones en redes sociales, artículos de blog) se utilicen para entrenar modelos de IA. Registrarían sus datos en el registro 'No Entrenar'. Esto asegura que sus datos se excluyan de los conjuntos de entrenamiento de IA, protegiendo su privacidad y control sobre su huella digital.

Cumplimiento del entrenador de IA

Un entrenador de IA quiere construir modelos de IA éticos y conformes. Integrarían el servicio en su pipeline de procesamiento de datos. Antes del entrenamiento, consultarían el registro para identificar y excluir los datos de las personas que se han excluido. Esto les ayuda a evitar problemas legales y mantener una imagen pública positiva.

Ética de la investigación

Una institución de investigación está desarrollando modelos de IA con fines académicos. Utilizarían el servicio para asegurarse de que están respetando la privacidad de las personas cuyos datos podrían utilizarse en su investigación. Esto les ayuda a adherirse a las directrices éticas y a mantener la integridad de su investigación.

Quién se beneficia de Spawning

Individuos

Personas preocupadas por el uso de sus datos para entrenar modelos de IA sin su consentimiento. Necesitan una forma de controlar sus datos y proteger su privacidad en la era de la IA. El servicio les proporciona un mecanismo directo para optar por no participar.

Entrenadores de IA

Desarrolladores y empresas de IA que desean construir modelos de IA éticos y conformes. Necesitan una forma sencilla y fiable de respetar la privacidad del usuario y evitar problemas legales. El servicio proporciona un registro centralizado para facilitar esto.

Investigadores

Investigadores en el ámbito académico y la industria que están desarrollando modelos de IA. Necesitan adherirse a las directrices éticas y garantizar la privacidad de las personas cuyos datos podrían utilizarse en su investigación. El servicio les ayuda a mantener la integridad de su investigación.

Precios de Spawning

El servicio se encuentra actualmente en mantenimiento. No hay detalles de precios disponibles en la página de destino.