One API

API unificada para LLMs

Freemium

Plataformas soportadas

web

Etiquetas de herramienta

Qué es One API

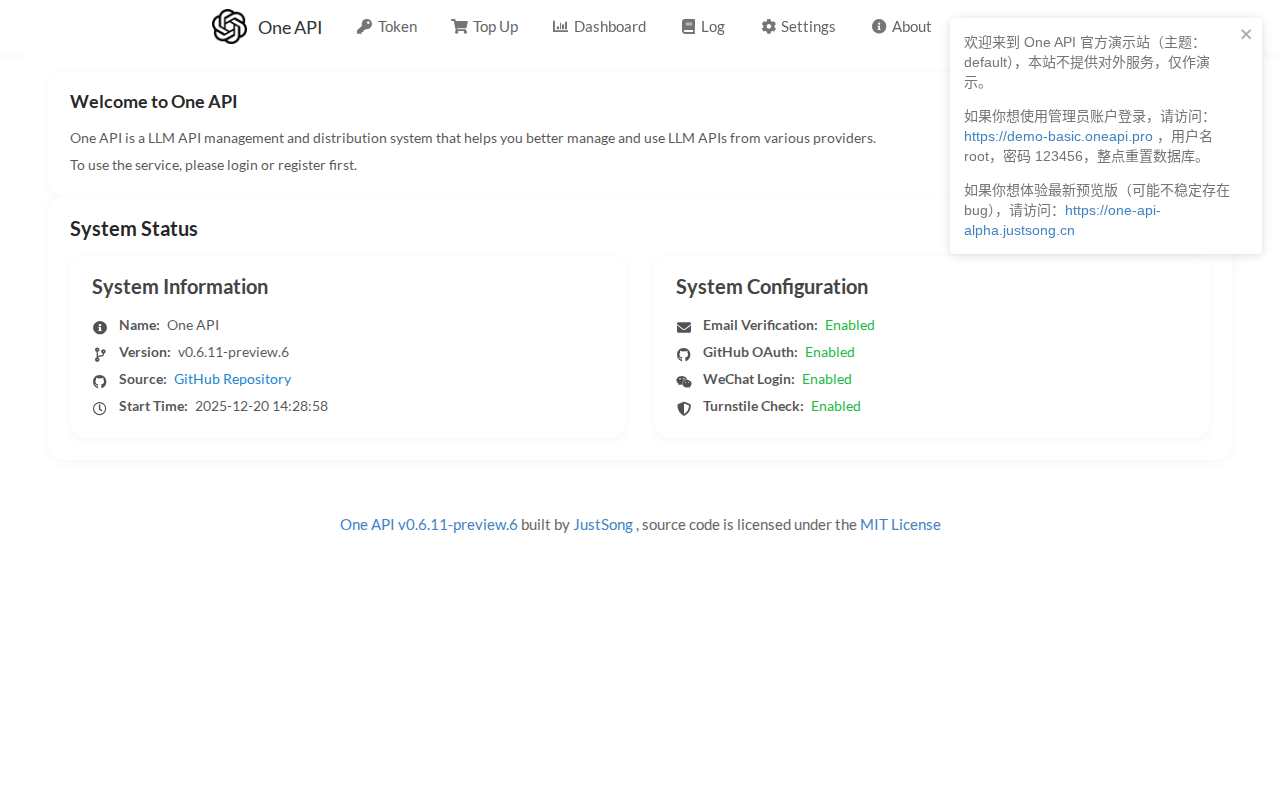

Una API proporciona una interfaz unificada para acceder a varios Modelos de Lenguaje Grandes (LLMs). Simplifica la integración de diferentes LLMs en aplicaciones al abstraer las complejidades de los endpoints de API individuales y los métodos de autenticación. Esto permite a los desarrolladores cambiar fácilmente entre modelos, gestionar costos e implementar funciones como el equilibrio de carga y la limitación de velocidad. A diferencia de las integraciones directas de API, One API ofrece gestión, monitoreo y control de versiones centralizados. Utiliza una arquitectura de proxy para enrutar las solicitudes al proveedor de LLM apropiado, soportando modelos de OpenAI, Cohere y otros. Esto es particularmente beneficioso para desarrolladores, investigadores y empresas que buscan construir aplicaciones impulsadas por IA sin estar atados a un único proveedor de LLM.

Funciones principales de One API

Interfaz API unificada

Ofrece un único endpoint de API consistente para acceder a múltiples LLMs. Esto simplifica la integración y reduce el código necesario para cambiar entre modelos. Por ejemplo, un desarrollador puede cambiar de GPT-3.5 a GPT-4 con un simple cambio de configuración, sin modificar la lógica central de la aplicación. Esta capa de abstracción también maneja las diferencias en los formatos de solicitud y las estructuras de respuesta.

Cambio y enrutamiento de modelos

Permite cambiar fácilmente entre diferentes LLMs según el rendimiento, el costo o la disponibilidad. Enruta inteligentemente las solicitudes al modelo más adecuado, optimizando factores como la latencia y el precio de los tokens. Esto permite realizar pruebas A/B de diferentes modelos y la asignación dinámica de recursos. La lógica de enrutamiento se puede personalizar en función de varios criterios, como el tamaño de la solicitud o la ubicación del usuario.

Gestión y optimización de costos

Proporciona herramientas para monitorear y controlar los costos de uso de LLM. Las funciones incluyen el seguimiento de costos, la presupuestación y la limitación de velocidad. Los usuarios pueden establecer límites de gasto y recibir alertas cuando se acercan a su presupuesto. La plataforma también ofrece funciones como el almacenamiento en caché inteligente y el procesamiento por lotes de solicitudes para reducir los costos. Los análisis detallados proporcionan información sobre los patrones de uso de los modelos.

Autenticación centralizada

Simplifica la autenticación al gestionar las claves API y las credenciales de acceso para todos los LLMs soportados en un solo lugar. Esto reduce el riesgo de exponer información sensible y agiliza el proceso de autenticación. Soporta varios métodos de autenticación, incluyendo claves API, OAuth y esquemas de autenticación personalizados. Almacena y gestiona de forma segura todas las claves API.

Monitoreo y análisis

Ofrece monitoreo en tiempo real del uso de la API, métricas de rendimiento y tasas de error. Proporciona paneles de análisis detallados para rastrear el volumen de solicitudes, la latencia y el costo por modelo. Esto permite a los usuarios identificar cuellos de botella, optimizar el rendimiento y solucionar problemas rápidamente. Hay disponibles paneles personalizables y funciones de alerta.

Cómo usar One API

Desafortunadamente, la URL proporcionada solo muestra un marcador de posición. Sin más información, no se puede crear una guía detallada de uso. Sin embargo, según la descripción del producto, los pasos generales probablemente involucrarían: 1. Registrarse para obtener una cuenta. 2. Obtener claves API para los proveedores de LLM deseados (por ejemplo, OpenAI). 3. Configurar la plataforma One API con sus claves API. 4. Usar los endpoints de One API en su aplicación para realizar solicitudes a los LLMs. 5. Monitorear el uso y gestionar los costos a través del panel de One API.

Casos de uso de One API

Desarrollo de chatbots de IA

Los desarrolladores que crean chatbots pueden usar One API para acceder a varios LLMs como GPT-3.5 o GPT-4. Pueden cambiar fácilmente entre modelos para optimizar la calidad de la respuesta, el costo o la latencia. Esto permite la creación rápida de prototipos y las pruebas A/B de diferentes configuraciones de LLM, lo que lleva a una mejor experiencia de usuario.

Generación de contenido

Los creadores de contenido pueden aprovechar One API para generar artículos, resúmenes y publicaciones en redes sociales utilizando diferentes LLMs. Pueden comparar los resultados de varios modelos y elegir el que mejor se adapte a sus necesidades. Esto agiliza el proceso de creación de contenido y permite la experimentación con diferentes estilos de escritura.

Integración de aplicaciones

Los desarrolladores de software pueden integrar LLMs en sus aplicaciones para proporcionar funciones como procesamiento del lenguaje natural, resumen de texto y análisis de sentimiento. One API simplifica el proceso de integración al proporcionar una interfaz unificada, reduciendo el tiempo y la complejidad del desarrollo. Esto permite a los desarrolladores centrarse en la creación de funciones en lugar de gestionar las integraciones de API.

Investigación y experimentación

Los investigadores pueden usar One API para experimentar con diferentes LLMs y comparar su rendimiento en varias tareas. Pueden cambiar fácilmente entre modelos, rastrear métricas de uso y analizar los resultados. Esto facilita la investigación sobre las capacidades de los LLM y ayuda a identificar los mejores modelos para aplicaciones específicas.

Quién se beneficia de One API

Desarrolladores de aplicaciones de IA

Desarrolladores que crean aplicaciones que utilizan LLMs. Necesitan una forma simplificada de acceder y gestionar múltiples LLMs sin tener que lidiar con las complejidades de las integraciones de API individuales, la autenticación y la gestión de costos.

Investigadores y científicos de datos

Investigadores y científicos de datos que necesitan experimentar con diferentes LLMs para sus proyectos. Se benefician de la capacidad de cambiar fácilmente entre modelos, rastrear métricas de rendimiento y gestionar los costos de manera efectiva.

Empresas y startups

Empresas y startups que buscan integrar IA en sus productos o servicios. Necesitan una solución rentable y escalable para acceder y gestionar LLMs, lo que les permite centrarse en su negocio principal.

Empresas

Grandes empresas que necesitan gestionar múltiples LLMs en diferentes equipos y proyectos. Requieren control centralizado, optimización de costos y capacidades de monitoreo robustas para garantizar un uso eficiente y seguro de los LLMs.

Precios de One API

Los detalles de precios no están disponibles en la URL proporcionada. Es probable que sea un modelo freemium con un nivel gratuito para el uso básico y planes de pago para límites de solicitud más altos y funciones avanzadas. Póngase en contacto con el proveedor para obtener precios específicos.