ONNX Runtime

Un moteur d'apprentissage automatique multiplateforme pour une inférence de modè

Freemium

Plateformes supportées

web

Qu'est-ce que ONNX Runtime

ONNX Runtime est un moteur d'IA de qualité production conçu pour résoudre le problème courant de l'optimisation des modèles d'apprentissage automatique pour divers environnements matériels et logiciels. En fournissant une interface unifiée pour l'entraînement et l'inférence, il permet aux équipes de déployer des modèles sur des processeurs (CPU), des cartes graphiques (GPU) et des unités de traitement neuronal (NPU) sans sacrifier les performances. Que vous travailliez avec des grands modèles de langage (LLM) ou des modèles prédictifs standards, ce moteur garantit que vos applications conservent une faible latence et un débit élevé, quelle que soit l'infrastructure sous-jacente. Conçu pour la flexibilité, le runtime prend en charge un large éventail de langages de programmation — notamment Python, C#, C++, Java, JavaScript et Rust — ce qui en fait un choix polyvalent pour les piles technologiques complexes. Il comble le fossé entre le développement et la production, permettant aux développeurs de maintenir un comportement de modèle cohérent sur Linux, Windows, macOS, les plateformes mobiles et les navigateurs web. En rationalisant l'exécution de modèles de pointe, il permet aux ingénieurs de se concentrer sur la création de fonctionnalités intelligentes plutôt que sur la résolution de problèmes de compatibilité matérielle ou de dégradation des performances.

Fonctionnalités principales de ONNX Runtime

Accélération matérielle

Optimise les performances en termes de latence, de débit et d'utilisation de la mémoire sur une large gamme de matériels, y compris les CPU, GPU et NPU, garantissant que vos modèles s'exécutent efficacement sur n'importe quel appareil.

Support multiplateforme

Offre une compatibilité robuste avec les principaux systèmes d'exploitation tels que Linux, Windows et macOS, ainsi qu'avec les plateformes mobiles et les navigateurs web, permettant une stratégie d'IA véritablement portable.

Support multilingue

Propose une intégration native pour les développeurs utilisant Python, C#, C++, Java, JavaScript et Rust, facilitant l'incorporation d'une IA haute performance dans des piles technologiques diverses et existantes.

Intégration de l'IA générative

Permet le déploiement de grands modèles de langage (LLM) de pointe, prenant en charge des tâches avancées comme la génération de texte et la synthèse d'images directement au sein de vos applications de production.

Comment utiliser ONNX Runtime

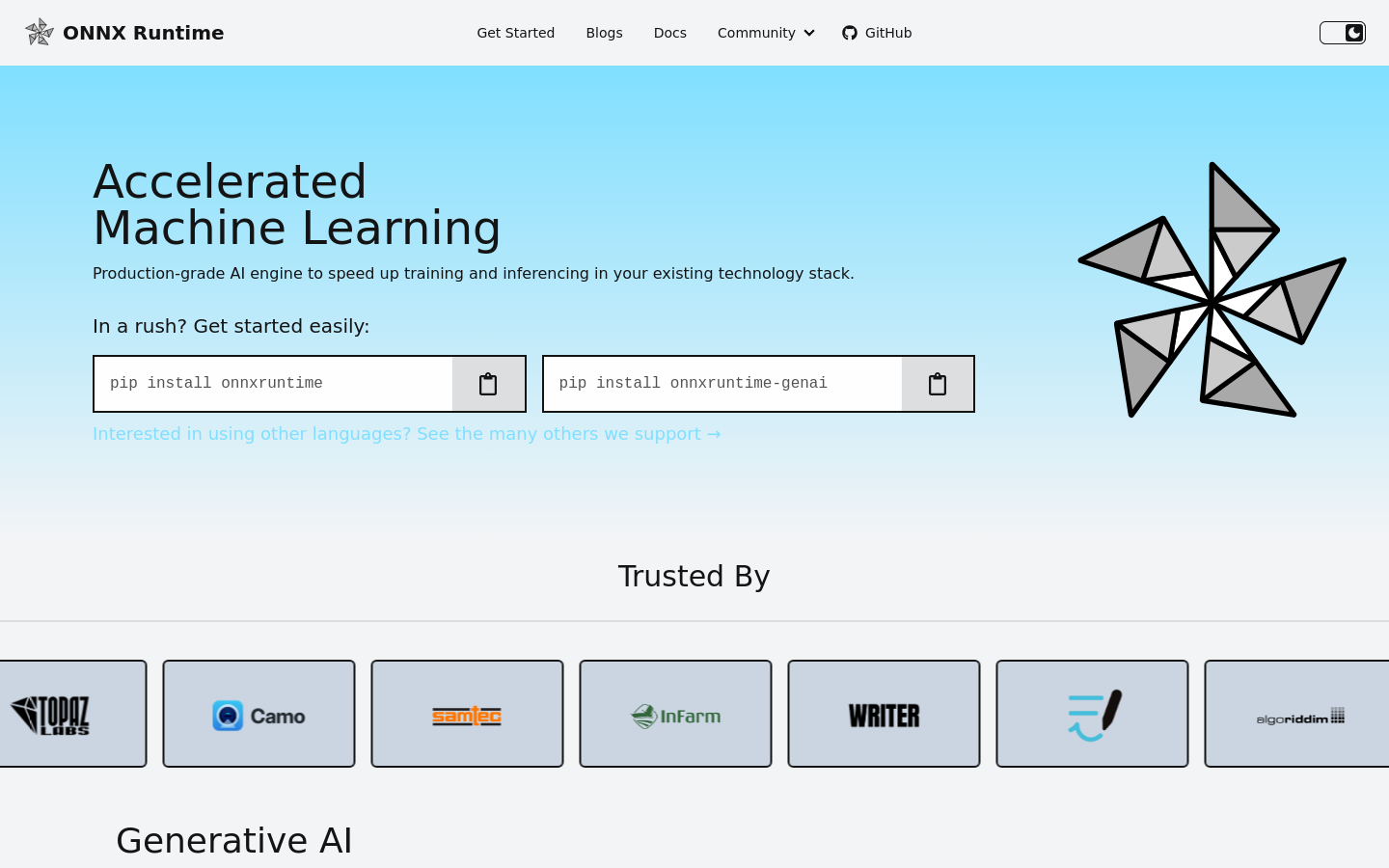

- Commencez par installer le package du runtime via votre gestionnaire de paquets préféré, tel que 'pip install onnxruntime' ou 'pip install onnxruntime-genai', pour configurer votre environnement.

- Initialisez le runtime en transmettant le chemin d'accès de votre modèle d'apprentissage automatique à la classe 'InferenceSession', ce qui prépare le moteur à exécuter votre modèle spécifique.

- Formatez vos données d'entrée dans la structure de tenseur requise, en vous assurant qu'elles correspondent au schéma d'entrée attendu par le modèle pour éviter les erreurs d'exécution lors du traitement.

- Exécutez le modèle en appelant la méthode 'session.run' avec vos données d'entrée préparées, ce qui déclenche le moteur pour générer efficacement des prédictions ou des résultats.

- Examinez les résultats renvoyés par la session pour intégrer de manière transparente les prédictions du modèle dans votre flux de travail applicatif ou votre logique de service existants.

Cas d’utilisation de ONNX Runtime

Déploiement d'IA en périphérie (Edge AI)

Les développeurs peuvent déployer des modèles d'IA haute performance sur des appareils aux ressources limitées, comme les téléphones mobiles ou le matériel IoT, en tirant parti de configurations de runtime optimisées.

Service de modèles en production

Les ingénieurs peuvent servir de manière fiable des modèles d'apprentissage automatique dans des environnements de production, garantissant que les applications des utilisateurs finaux bénéficient d'une faible latence et d'un débit élevé.

Développement d'applications multiplateformes

Les équipes créant des applications pour plusieurs plateformes peuvent utiliser un runtime unique et unifié pour maintenir des performances d'IA cohérentes sur les environnements de bureau, mobiles et web.

Qui bénéficie de ONNX Runtime

Ingénieurs en apprentissage automatique

Professionnels axés sur l'optimisation de la vitesse d'inférence des modèles et de l'efficacité des ressources pour garantir que leurs applications d'IA répondent aux normes de performance de qualité production.

Développeurs de logiciels

Développeurs intégrant l'IA dans des applications via divers langages et ayant besoin d'un moteur d'exécution fiable et haute performance qui s'adapte à leur pile technologique existante.

Tarification de ONNX Runtime

ONNX Runtime est un projet open source gratuit.