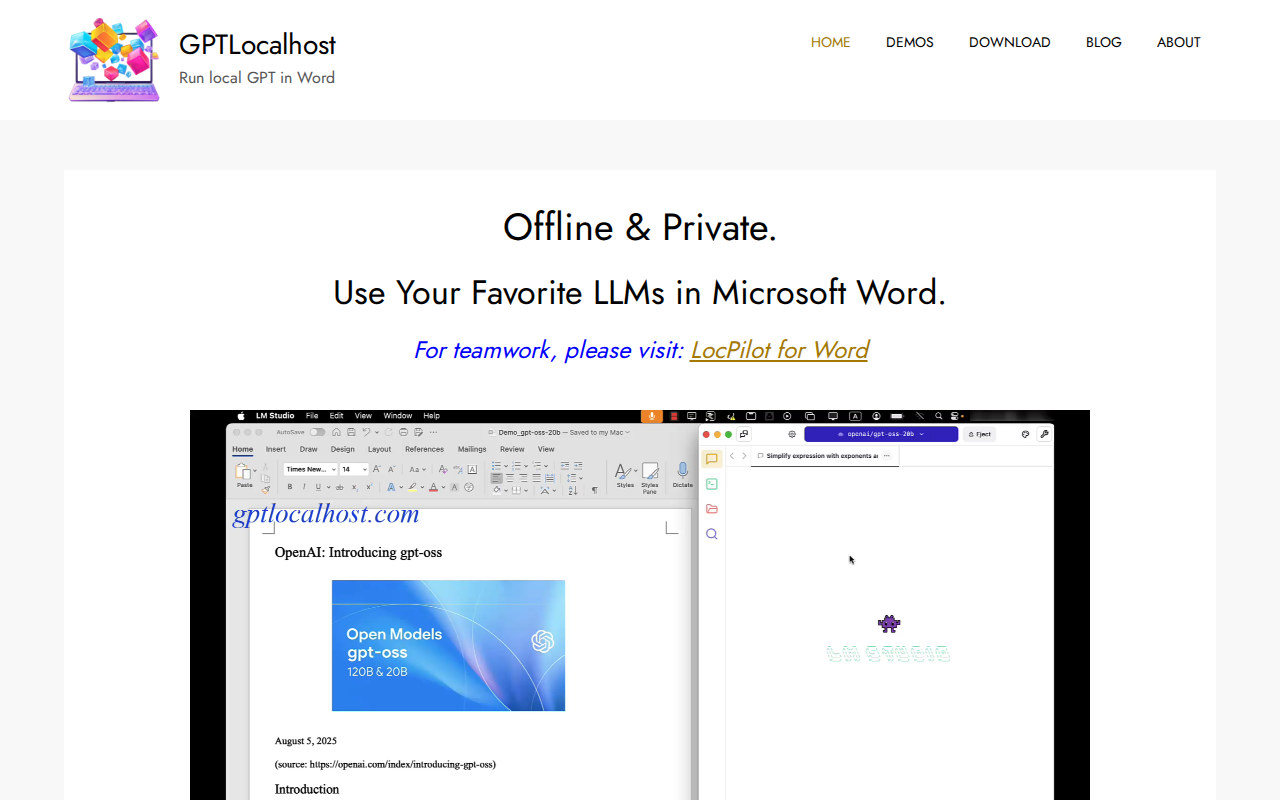

GPTLocalhost

Accès LLM local & changement de modèle

Gratuit

Plateformes supportées

web

Étiquettes d'outil

Qu'est-ce que GPTLocalhost

GPTLocalhost fournit un environnement local pour interagir avec les Large Language Models (LLMs). Il permet aux utilisateurs d'exécuter et d'expérimenter avec divers LLMs localement, offrant flexibilité et contrôle sur leurs interactions IA. Contrairement aux solutions basées sur le cloud, GPTLocalhost privilégie la confidentialité et réduit la latence en conservant les modèles sur votre machine. La plateforme prend en charge le changement de modèle transparent, permettant aux utilisateurs de comparer et de contraster différents LLMs, tels que IBM Granite 4, pour des tâches comme l'analyse de contrats. Ceci est réalisé grâce à une interface conviviale et à un processus d'installation simple, ce qui le rend accessible aux développeurs et aux chercheurs. Le principal avantage est la possibilité d'expérimenter avec les LLMs sans dépendre d'API externes ni encourir de coûts cloud, ce qui est idéal pour ceux qui privilégient la confidentialité des données et le prototypage rapide.

Fonctionnalités principales de GPTLocalhost

Exécution LLM locale

GPTLocalhost permet d'exécuter des LLMs directement sur votre machine locale, éliminant le besoin d'API basées sur le cloud. Cela réduit considérablement la latence, améliore la confidentialité des données et minimise les coûts associés aux appels d'API externes. Ceci est particulièrement bénéfique pour les données sensibles ou les applications nécessitant des réponses en temps réel. L'exécution locale exploite les ressources de votre machine (CPU/GPU) pour le traitement.

Changement de modèle transparent

Basculez facilement entre différents LLMs, tels que IBM Granite 4, pour comparer les performances et l'adéquation à diverses tâches. Cette fonctionnalité est cruciale pour l'expérimentation et la sélection du modèle optimal pour un cas d'utilisation spécifique. La plateforme fournit une interface unifiée pour interagir avec différents modèles, simplifiant le processus d'évaluation et permettant un prototypage rapide.

Conception axée sur la confidentialité

En exécutant les LLMs localement, GPTLocalhost garantit que vos données restent privées et sécurisées. Ceci est particulièrement important pour les applications traitant des informations sensibles ou se conformant à des réglementations strictes en matière de confidentialité des données. Le modèle d'exécution locale élimine le risque de violations de données ou d'accès non autorisé associé aux solutions basées sur le cloud.

Interface conviviale

GPTLocalhost offre une interface conviviale pour interagir avec les LLMs, ce qui la rend accessible aux développeurs et aux utilisateurs non techniques. L'interface simplifie le processus de soumission des invites, de réception des réponses et de gestion des différents modèles. Cette facilité d'utilisation accélère le processus d'expérimentation et de développement.

Disponibilité des démos

Fournit des démos facilement disponibles présentant les capacités de GPTLocalhost. Ces démos permettent aux utilisateurs de comprendre rapidement les fonctionnalités de la plateforme et les cas d'utilisation potentiels. Les démos incluent souvent des configurations pré-configurées et des exemples d'invites, permettant aux utilisateurs de démarrer rapidement sans configuration approfondie.

Comment utiliser GPTLocalhost

- Visitez le site web de GPTLocalhost et consultez les démos et la documentation disponibles.,2. Identifiez le LLM spécifique que vous souhaitez utiliser (par exemple, IBM Granite 4) et assurez-vous d'avoir l'accès ou les informations d'identification nécessaires.,3. Suivez les instructions d'installation fournies sur le site web pour configurer GPTLocalhost sur votre machine locale.,4. Configurez le LLM choisi dans GPTLocalhost, en fournissant les clés API ou les chemins de modèle requis.,5. Utilisez l'interface ou l'API fournie pour interagir avec le LLM, en soumettant des invites et en recevant des réponses.,6. Expérimentez avec différents modèles en basculant entre eux dans l'environnement GPTLocalhost pour comparer les performances.

Cas d’utilisation de GPTLocalhost

Analyse de contrats

Les professionnels du droit peuvent utiliser GPTLocalhost avec des modèles comme IBM Granite 4 pour analyser les contrats localement. Ils peuvent télécharger des documents, identifier les clauses clés et évaluer les risques potentiels sans envoyer de données sensibles à des serveurs externes. Cela améliore l'efficacité et garantit la confidentialité des données lors des processus d'examen des contrats.

Recherche et expérimentation en IA

Les chercheurs peuvent utiliser GPTLocalhost pour expérimenter avec divers LLMs, comparer leurs performances et affiner les modèles pour des tâches spécifiques. Ils peuvent tester différentes invites, évaluer la qualité des réponses et itérer sur leurs modèles d'IA dans un environnement local contrôlé, accélérant ainsi le cycle de recherche.

Développement local

Les développeurs peuvent intégrer des LLMs dans leurs applications sans dépendre d'API externes. Ils peuvent créer des chatbots, des outils de génération de contenu et d'autres fonctionnalités basées sur l'IA qui s'exécutent localement, réduisant la latence et améliorant la réactivité. Cette approche est idéale pour les applications hors ligne ou celles nécessitant une sécurité des données élevée.

Conformité à la confidentialité des données

Les organisations traitant des données sensibles peuvent utiliser GPTLocalhost pour se conformer aux réglementations en matière de confidentialité des données. En exécutant les LLMs localement, elles peuvent garantir que les données ne quittent jamais leur environnement sécurisé, réduisant ainsi le risque de violations de données et assurant la conformité au RGPD, à la HIPAA et à d'autres réglementations.

Qui bénéficie de GPTLocalhost

Chercheurs en IA

Les chercheurs bénéficient de la possibilité d'expérimenter avec différents LLMs localement, de comparer leurs performances et d'affiner les modèles sans les contraintes des API basées sur le cloud. Cela permet une itération plus rapide et plus de contrôle sur le processus de recherche.

Développeurs

Les développeurs peuvent intégrer des LLMs dans leurs applications avec un plus grand contrôle sur la confidentialité des données et la latence. GPTLocalhost leur permet de créer des fonctionnalités basées sur l'IA qui s'exécutent localement, améliorant la réactivité et réduisant la dépendance aux services externes.

Professionnels du droit

Les professionnels du droit peuvent utiliser GPTLocalhost pour analyser les contrats et autres documents juridiques localement, garantissant la confidentialité des données et réduisant le risque de violations de données. Cela améliore l'efficacité et la sécurité lors du processus d'examen des contrats.

Data Scientists

Les data scientists peuvent utiliser GPTLocalhost pour prototyper et tester des solutions basées sur les LLMs dans un environnement sécurisé et contrôlé. La possibilité de basculer entre les modèles et de les exécuter localement accélère le développement et l'évaluation des applications d'IA.

Tarification de GPTLocalhost

Les détails de tarification ne sont pas explicitement mentionnés sur la page de démonstration fournie. Cependant, la nature du produit suggère un modèle gratuit ou open-source, car il se concentre sur l'exécution locale et le changement de modèle.

Autres outils similaires à GPTLocalhost

ChatGPT

ChatGPT est un outil d'IA conversationnelle avancé qui génère des réponses textuelles semblables à celles d'un humain.

Kimi

Kimi est un chatbot alimenté par l'IA conçu pour aider les utilisateurs avec diverses demandes et tâches.