Apache Airflow

Orchestration de flux de travail

Gratuit

Plateformes supportées

web

Étiquettes d'outil

Qu'est-ce que Apache Airflow

Apache Airflow est une plateforme pour la création, la planification et la surveillance programmatiques de flux de travail. Il permet aux utilisateurs de définir des pipelines sous forme de code Python, offrant flexibilité et contrôle sur les tâches de traitement des données. La valeur fondamentale d'Airflow réside dans sa capacité à orchestrer des flux de travail complexes, en veillant à ce que les tâches s'exécutent dans le bon ordre et gèrent efficacement les dépendances. Contrairement aux tâches cron traditionnelles ou aux scripts, Airflow offre une interface utilisateur robuste pour la surveillance, la journalisation et la gestion des flux de travail à grande échelle. Son architecture modulaire et ses nombreuses intégrations avec les fournisseurs de cloud et les services tiers le rendent adaptable à divers environnements. Les ingénieurs de données, les scientifiques des données et les équipes DevOps bénéficient de la capacité d'Airflow à automatiser et à rationaliser les pipelines de données, l'entraînement des modèles d'apprentissage automatique et la gestion de l'infrastructure.

Fonctionnalités principales de Apache Airflow

Définition de flux de travail basée sur Python

Airflow utilise Python pour définir les flux de travail (DAG), ce qui permet aux développeurs de tirer parti de toute la puissance de l'écosystème Python. Cela inclut l'utilisation des fonctionnalités Python standard comme les boucles, les instructions conditionnelles et les formats de date/heure pour la planification. Cette approche offre une flexibilité et évite les limitations des définitions de flux de travail basées sur la ligne de commande ou XML, permettant la génération dynamique de pipelines et la mise en œuvre d'une logique complexe.

Architecture évolutive et modulaire

La conception modulaire d'Airflow lui permet de s'adapter pour gérer un grand nombre de tâches simultanées. Il utilise une file d'attente de messages (par exemple, Celery, RabbitMQ) pour orchestrer les workers, ce qui permet une mise à l'échelle horizontale en ajoutant davantage de nœuds de worker. Cette architecture garantit qu'Airflow peut gérer des flux de travail complexes avec de nombreuses dépendances et des volumes de données élevés, ce qui le rend adapté aux déploiements au niveau de l'entreprise.

Interface utilisateur web robuste

Airflow fournit une interface utilisateur web conviviale pour la surveillance, la planification et la gestion des flux de travail. L'interface utilisateur offre des mises à jour de l'état des tâches en temps réel, des journaux détaillés et la possibilité de déclencher, de mettre en pause et de relancer les tâches. Cette interface centralisée simplifie la gestion des flux de travail, fournit des informations sur les performances des pipelines et réduit le besoin d'intervention manuelle, améliorant ainsi l'efficacité opérationnelle.

Intégrations étendues

Airflow offre un large éventail d'opérateurs pré-intégrés pour l'intégration avec divers services, notamment Google Cloud Platform, Amazon Web Services, Microsoft Azure et de nombreux outils tiers. Ces opérateurs simplifient le processus d'exécution des tâches sur différentes plateformes, réduisant ainsi le besoin de scripts personnalisés et accélérant le développement des pipelines de données et autres flux de travail.

Génération dynamique de pipelines

Airflow permet la génération dynamique de pipelines via le code Python. Cela signifie que vous pouvez écrire du code qui instancie les pipelines de manière dynamique, en fonction des données ou d'autres paramètres. Cette fonctionnalité est particulièrement utile pour gérer les tâches récurrentes, traiter les données provenant de plusieurs sources ou créer des pipelines qui s'adaptent à l'évolution des exigences de l'entreprise, améliorant ainsi la flexibilité et l'automatisation.

Open Source et axé sur la communauté

Airflow est un projet open source avec une communauté dynamique. Cela signifie que les utilisateurs peuvent contribuer au projet, partager leurs expériences et accéder à une multitude de ressources et de supports. La nature open source favorise la transparence, la collaboration et l'amélioration continue, garantissant qu'Airflow reste une plateforme d'orchestration de flux de travail puissante et adaptable.

Comment utiliser Apache Airflow

- Installez Airflow en utilisant pip :

pip install apache-airflow.,2. Initialisez la base de données Airflow :airflow db init.,3. Créez un DAG (Directed Acyclic Graph) en Python, en définissant les tâches et les dépendances de votre flux de travail.,4. Placez votre fichier DAG dans le dossierdagsde votre répertoire d'accueil Airflow.,5. Démarrez le serveur web et le planificateur Airflow :airflow webserver -p 8080etairflow scheduler.,6. Accédez à l'interface utilisateur d'Airflow dans votre navigateur (généralement àhttp://localhost:8080) pour surveiller et gérer vos flux de travail.

Cas d’utilisation de Apache Airflow

Automatisation des pipelines de données

Les ingénieurs de données utilisent Airflow pour automatiser le processus ETL (Extraction, Transformation, Chargement). Ils définissent des DAG pour extraire les données de diverses sources, les transformer à l'aide d'outils tels que Spark ou Pandas, et les charger dans un entrepôt de données. Cela garantit que les données sont constamment mises à jour et prêtes pour l'analyse, ce qui permet de gagner du temps et des ressources.

Entraînement de modèles d'apprentissage automatique

Les scientifiques des données utilisent Airflow pour planifier et gérer l'entraînement des modèles d'apprentissage automatique. Ils créent des DAG pour orchestrer le prétraitement des données, l'entraînement des modèles, l'évaluation et le déploiement. Cela automatise le cycle de vie du ML, garantissant que les modèles sont régulièrement réentraînés avec les dernières données et déployés efficacement.

Gestion de l'infrastructure

Les ingénieurs DevOps utilisent Airflow pour automatiser les tâches d'infrastructure, telles que le provisionnement des serveurs, le déploiement des applications et la gestion des ressources cloud. Ils créent des DAG pour orchestrer ces tâches, en veillant à ce qu'elles soient exécutées dans le bon ordre et avec les dépendances nécessaires, ce qui améliore l'efficacité opérationnelle.

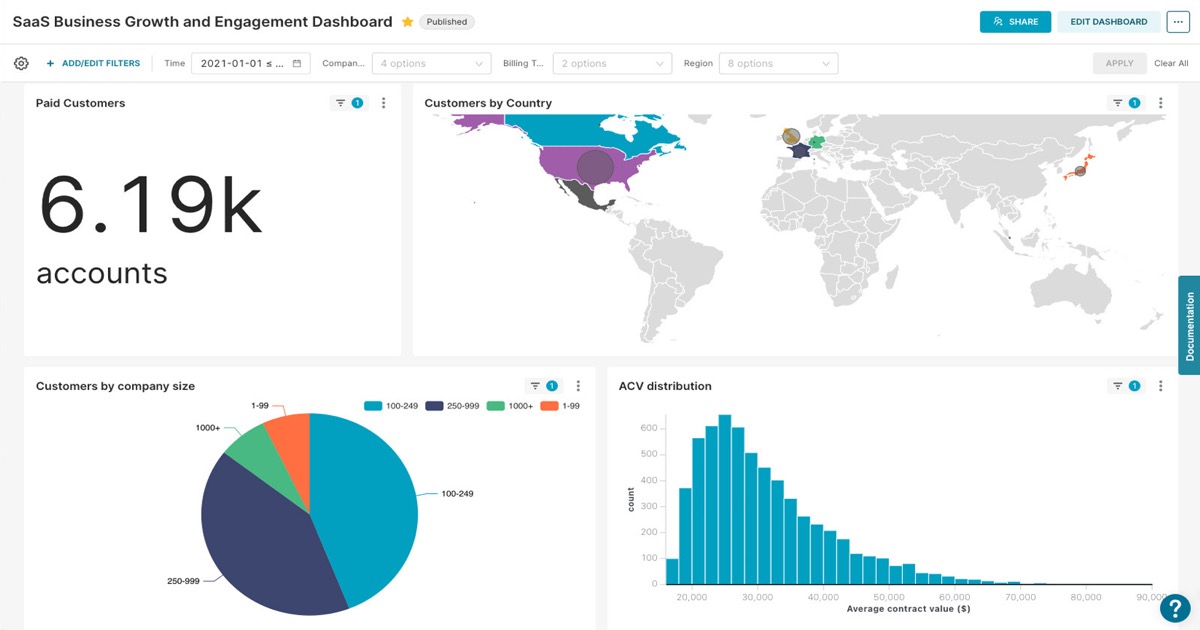

Reporting et analyse

Les analystes utilisent Airflow pour automatiser la génération de rapports et de tableaux de bord. Ils définissent des DAG pour extraire les données des bases de données, les transformer et générer des rapports à l'aide d'outils tels que SQL ou des scripts Python. Cela garantit que les rapports sont générés selon un calendrier régulier et fournissent des informations à jour.

Qui bénéficie de Apache Airflow

Ingénieurs de données

Les ingénieurs de données ont besoin d'Airflow pour construire et gérer des pipelines de données. Ils l'utilisent pour automatiser les processus ETL, en veillant à ce que les données soient transformées et chargées efficacement. Les capacités de planification et de surveillance d'Airflow les aident à maintenir la qualité des données et à réduire l'intervention manuelle.

Scientifiques des données

Les scientifiques des données utilisent Airflow pour automatiser le cycle de vie de l'apprentissage automatique. Ils créent des flux de travail pour le prétraitement des données, l'entraînement des modèles, l'évaluation et le déploiement. Cela leur permet de se concentrer sur le développement et l'analyse des modèles plutôt que sur l'orchestration manuelle.

Ingénieurs DevOps

Les ingénieurs DevOps utilisent Airflow pour automatiser les tâches d'infrastructure. Ils créent des flux de travail pour le provisionnement des serveurs, le déploiement des applications et la gestion des ressources cloud. Cela améliore l'efficacité opérationnelle et réduit le risque d'erreurs.

Analystes commerciaux

Les analystes commerciaux utilisent Airflow pour automatiser les processus de reporting et d'analyse. Ils créent des flux de travail pour extraire les données, les transformer et générer des rapports. Cela garantit que les rapports sont générés selon un calendrier régulier et fournissent des informations à jour.

Tarification de Apache Airflow

Licence Apache 2.0 (Open Source). Libre d'utilisation, de modification et de distribution.