Cleanlab

Scores de confiance LLM en temps réel

Payant

Plateformes supportées

web

Étiquettes d'outil

Qu'est-ce que Cleanlab

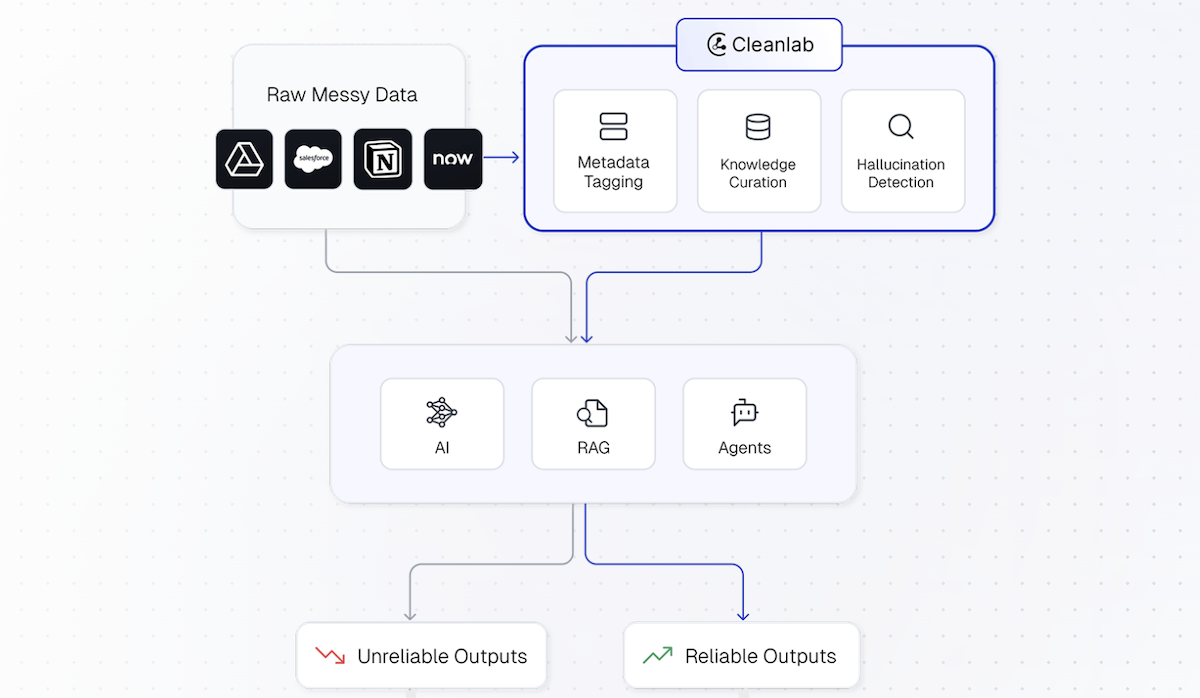

Le modèle linguistique fiable (TLM) de Cleanlab fournit des scores de fiabilité en temps réel pour les sorties des grands modèles linguistiques (LLM), atténuant le risque d'hallucinations et de réponses incorrectes. Il aide les utilisateurs à identifier les réponses LLM fiables, garantissant l'exactitude et la fiabilité des applications basées sur l'IA. Contrairement aux outils d'évaluation LLM génériques, TLM se concentre sur la notation en temps réel, s'intégrant de manière transparente dans les flux de travail existants. Il utilise des algorithmes avancés pour évaluer la fiabilité des sorties LLM, fournissant des informations exploitables pour améliorer la fiabilité de l'IA. TLM est idéal pour les entreprises et les développeurs qui cherchent à créer des solutions d'IA fiables, telles que les chatbots, les outils d'extraction de données et les systèmes basés sur des agents. Il permet aux utilisateurs de prendre des décisions éclairées basées sur la fiabilité des réponses LLM, améliorant l'expérience utilisateur et les résultats commerciaux.

Fonctionnalités principales de Cleanlab

Notation de confiance en temps réel

TLM fournit des scores de fiabilité immédiats pour les sorties LLM, permettant une prise de décision dynamique pendant l'exécution. Cela contraste avec les méthodes de traitement par lots, permettant l'identification immédiate des réponses non fiables. La notation est basée sur un algorithme propriétaire qui analyse divers facteurs, notamment la confiance du LLM, la cohérence de la réponse et la présence d'erreurs factuelles. Cette capacité en temps réel est cruciale pour les applications où la précision immédiate est primordiale.

Détection des hallucinations

TLM est conçu pour détecter et signaler les hallucinations générées par LLM, qui sont des réponses incorrectes ou fabriquées. Il utilise des techniques avancées pour identifier les incohérences et les inexactitudes factuelles dans la sortie du LLM. Cette fonctionnalité est essentielle pour les applications où la précision est primordiale, telles que le diagnostic médical ou l'analyse financière, où des informations incorrectes peuvent avoir de graves conséquences. Le système fournit un score de confiance indiquant la probabilité d'une hallucination.

Critères d'évaluation personnalisables

TLM permet aux utilisateurs de définir des critères d'évaluation personnalisés adaptés à leurs cas d'utilisation et à leurs données spécifiques. Cette flexibilité permet aux utilisateurs d'adapter la notation de fiabilité à leurs besoins spécifiques, garantissant que le système correspond à leurs exigences uniques. Les utilisateurs peuvent spécifier les types d'erreurs à prioriser et les niveaux de risque acceptables. Cette personnalisation est essentielle pour optimiser les performances des applications LLM dans divers domaines.

Intégration avec divers LLM

TLM prend en charge l'intégration avec une large gamme de LLM, y compris les modèles OpenAI et autres, offrant une large compatibilité. Cela permet aux utilisateurs d'appliquer les capacités de notation de fiabilité de TLM quel que soit leur fournisseur de LLM choisi. Le système est conçu pour être adaptable à différentes architectures LLM et formats de sortie, garantissant une intégration transparente. Cette flexibilité simplifie le processus d'incorporation de TLM dans les flux de travail d'IA existants.

Solutions spécifiques aux cas d'utilisation

Cleanlab propose des solutions et des guides pré-construits pour divers cas d'utilisation, tels que les chatbots RAG fiables, l'extraction de données et les systèmes basés sur des agents. Ces solutions constituent un point de départ pour la mise en œuvre de TLM dans des applications spécifiques, rationalisant le processus de développement. Les guides offrent les meilleures pratiques et des exemples pour l'intégration de TLM dans différents flux de travail. Cette approche ciblée aide les utilisateurs à déployer et à bénéficier rapidement des capacités de TLM.

Comment utiliser Cleanlab

- Accédez à la documentation Cleanlab TLM et familiarisez-vous avec les API et SDK disponibles. 2. Intégrez l'API TLM dans votre application ou flux de travail basé sur LLM existant. 3. Envoyez les réponses LLM à l'API TLM pour une notation de fiabilité en temps réel. 4. Analysez les scores de confiance renvoyés pour identifier les sorties LLM potentiellement non fiables. 5. Mettez en œuvre des stratégies pour gérer les faibles scores de confiance, telles que la reformulation des invites, la validation croisée des réponses ou la fourniture de réponses alternatives. 6. Surveillez et affinez en permanence votre application LLM en fonction des informations de TLM pour améliorer la précision et la fiabilité.

Cas d’utilisation de Cleanlab

Chatbots fiables

Les développeurs peuvent utiliser TLM pour créer des chatbots qui fournissent des informations fiables et précises en notant la fiabilité de chaque réponse. Cela garantit que le chatbot évite de générer des réponses incorrectes ou trompeuses, améliorant ainsi la confiance et la satisfaction des utilisateurs. Par exemple, un chatbot de service client peut utiliser TLM pour vérifier l'exactitude de ses réponses avant de les fournir à un utilisateur.

Extraction de données

TLM peut être utilisé pour améliorer la précision de l'extraction de données à partir de texte non structuré. En notant la fiabilité des informations extraites, les utilisateurs peuvent identifier et corriger les erreurs, garantissant ainsi la qualité des données. Par exemple, une entreprise peut utiliser TLM pour extraire des informations clés de contrats, en vérifiant l'exactitude des données extraites avant de les utiliser.

Systèmes basés sur des agents

TLM peut être intégré dans des systèmes basés sur des agents pour garantir la fiabilité des actions et des décisions des agents. En notant la fiabilité des sorties des agents, les développeurs peuvent empêcher les agents de prendre des mesures basées sur des informations incorrectes. Par exemple, un agent de trading financier peut utiliser TLM pour vérifier l'exactitude des données de marché avant de faire des transactions.

Prise de décision oui/non

TLM peut être appliqué pour améliorer la précision des processus de prise de décision oui/non. En notant la fiabilité des réponses du LLM, les utilisateurs peuvent prendre des décisions plus éclairées basées sur des informations fiables. Par exemple, un outil de diagnostic médical peut utiliser TLM pour évaluer la fiabilité du diagnostic du LLM avant de le fournir à un médecin.

Qui bénéficie de Cleanlab

Développeurs IA

Les développeurs IA bénéficient de TLM en obtenant un outil pour améliorer la fiabilité et la précision de leurs applications basées sur LLM. Ils peuvent utiliser TLM pour identifier et atténuer les risques associés aux hallucinations LLM, en veillant à ce que leurs applications fournissent des informations fiables et offrent une meilleure expérience utilisateur.

Data Scientists

Les data scientists peuvent tirer parti de TLM pour améliorer la qualité des données extraites des LLM. En notant la fiabilité des sorties LLM, les data scientists peuvent améliorer la précision de leurs ensembles de données et de leurs modèles, ce qui conduit à des informations plus fiables et à une meilleure prise de décision. Ceci est particulièrement utile pour des tâches telles que l'annotation de données et la recherche d'informations.

Dirigeants d'entreprise

Les dirigeants d'entreprise peuvent utiliser TLM pour renforcer la confiance dans leurs produits et services basés sur l'IA. En garantissant la fiabilité des réponses LLM, ils peuvent améliorer la satisfaction de la clientèle, réduire le risque de désinformation et acquérir un avantage concurrentiel. Ceci est crucial pour les applications qui impliquent des informations sensibles ou une prise de décision critique.

Tarification de Cleanlab

Les détails de tarification ne sont pas disponibles dans la documentation fournie. Veuillez consulter le site Web de Cleanlab pour connaître les plans de tarification actuels.