One API

API unifiée pour accès LLM

Freemium

Plateformes supportées

web

Étiquettes d'outil

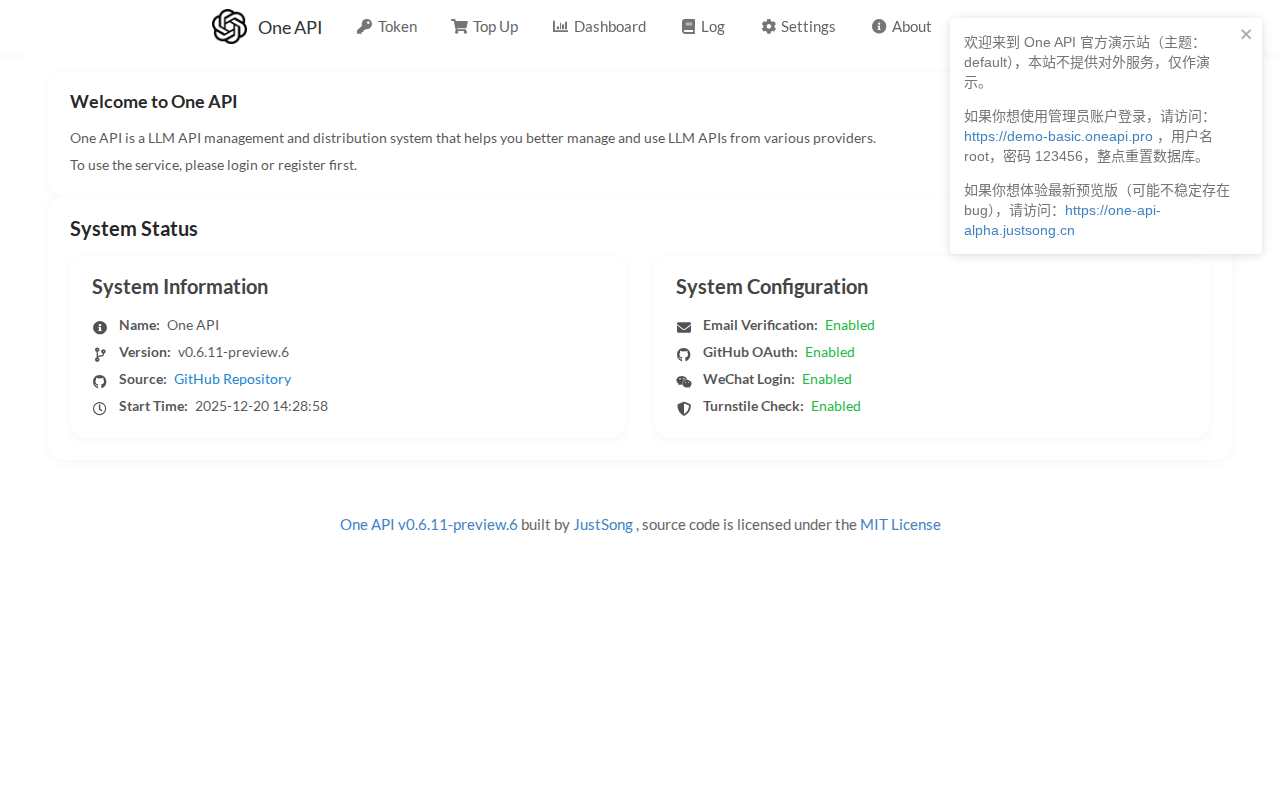

Qu'est-ce que One API

Une API unique fournit une interface unifiée pour accéder à divers modèles linguistiques volumineux (LLM). Elle simplifie l'intégration de différents LLM dans les applications en abstraisant les complexités des points de terminaison d'API individuels et des méthodes d'authentification. Cela permet aux développeurs de basculer facilement entre les modèles, de gérer les coûts et de mettre en œuvre des fonctionnalités telles que l'équilibrage de charge et la limitation du débit. Contrairement aux intégrations directes d'API, One API offre une gestion, une surveillance et un contrôle de version centralisés. Elle utilise une architecture de proxy pour acheminer les requêtes vers le fournisseur de LLM approprié, prenant en charge les modèles d'OpenAI, Cohere et autres. Ceci est particulièrement bénéfique pour les développeurs, les chercheurs et les entreprises qui cherchent à créer des applications basées sur l'IA sans être liés à un seul fournisseur de LLM.

Fonctionnalités principales de One API

Interface API unifiée

Offre un point de terminaison d'API unique et cohérent pour accéder à plusieurs LLM. Cela simplifie l'intégration et réduit le code nécessaire pour basculer entre les modèles. Par exemple, un développeur peut passer de GPT-3.5 à GPT-4 avec un simple changement de configuration, sans modifier la logique de base de l'application. Cette couche d'abstraction gère également les différences de formats de requêtes et de structures de réponses.

Changement et routage de modèles

Permet de basculer facilement entre différents LLM en fonction des performances, du coût ou de la disponibilité. Elle achemine intelligemment les requêtes vers le modèle le plus approprié, en optimisant des facteurs tels que la latence et le prix des jetons. Cela permet des tests A/B de différents modèles et une allocation dynamique des ressources. La logique de routage peut être personnalisée en fonction de divers critères, tels que la taille de la requête ou l'emplacement de l'utilisateur.

Gestion et optimisation des coûts

Fournit des outils pour surveiller et contrôler les coûts d'utilisation des LLM. Les fonctionnalités incluent le suivi des coûts, la budgétisation et la limitation du débit. Les utilisateurs peuvent définir des limites de dépenses et recevoir des alertes lorsqu'ils approchent de leur budget. La plateforme propose également des fonctionnalités telles que la mise en cache intelligente et le regroupement des requêtes pour réduire les coûts. Des analyses détaillées fournissent des informations sur les schémas d'utilisation des modèles.

Authentification centralisée

Simplifie l'authentification en gérant les clés API et les informations d'identification d'accès pour tous les LLM pris en charge en un seul endroit. Cela réduit le risque d'exposer des informations sensibles et rationalise le processus d'authentification. Elle prend en charge diverses méthodes d'authentification, notamment les clés API, OAuth et les schémas d'authentification personnalisés. Stocke et gère en toute sécurité toutes les clés API.

Surveillance et analyse

Offre une surveillance en temps réel de l'utilisation de l'API, des mesures de performance et des taux d'erreur. Fournit des tableaux de bord d'analyse détaillés pour suivre le volume des requêtes, la latence et le coût par modèle. Cela permet aux utilisateurs d'identifier les goulots d'étranglement, d'optimiser les performances et de résoudre les problèmes rapidement. Des tableaux de bord personnalisables et des fonctionnalités d'alerte sont disponibles.

Comment utiliser One API

Malheureusement, l'URL fournie ne montre qu'un espace réservé. Sans plus d'informations, un guide d'utilisation détaillé ne peut être créé. Cependant, sur la base de la description du produit, les étapes générales impliqueraient probablement : 1. S'inscrire pour un compte. 2. Obtenir des clés API pour les fournisseurs de LLM souhaités (par exemple, OpenAI). 3. Configurer la plateforme One API avec vos clés API. 4. Utiliser les points de terminaison One API dans votre application pour faire des requêtes aux LLM. 5. Surveiller l'utilisation et gérer les coûts via le tableau de bord One API.

Cas d’utilisation de One API

Développement de chatbot IA

Les développeurs qui créent des chatbots peuvent utiliser One API pour accéder à divers LLM comme GPT-3.5 ou GPT-4. Ils peuvent facilement basculer entre les modèles pour optimiser la qualité des réponses, le coût ou la latence. Cela permet un prototypage rapide et des tests A/B de différentes configurations de LLM, ce qui conduit à une meilleure expérience utilisateur.

Génération de contenu

Les créateurs de contenu peuvent tirer parti de One API pour générer des articles, des résumés et des publications sur les réseaux sociaux en utilisant différents LLM. Ils peuvent comparer les résultats de divers modèles et choisir celui qui correspond le mieux à leurs besoins. Cela rationalise le processus de création de contenu et permet d'expérimenter différents styles d'écriture.

Intégration d'applications

Les développeurs de logiciels peuvent intégrer des LLM dans leurs applications pour fournir des fonctionnalités telles que le traitement du langage naturel, la synthèse de texte et l'analyse des sentiments. One API simplifie le processus d'intégration en fournissant une interface unifiée, réduisant le temps et la complexité du développement. Cela permet aux développeurs de se concentrer sur la création de fonctionnalités plutôt que sur la gestion des intégrations d'API.

Recherche et expérimentation

Les chercheurs peuvent utiliser One API pour expérimenter différents LLM et comparer leurs performances sur diverses tâches. Ils peuvent facilement basculer entre les modèles, suivre les mesures d'utilisation et analyser les résultats. Cela facilite la recherche sur les capacités des LLM et aide à identifier les meilleurs modèles pour des applications spécifiques.

Qui bénéficie de One API

Développeurs d'applications IA

Développeurs créant des applications qui utilisent des LLM. Ils ont besoin d'un moyen simplifié d'accéder et de gérer plusieurs LLM sans avoir à gérer les complexités des intégrations d'API individuelles, de l'authentification et de la gestion des coûts.

Chercheurs et scientifiques des données

Chercheurs et scientifiques des données qui ont besoin d'expérimenter différents LLM pour leurs projets. Ils bénéficient de la possibilité de basculer facilement entre les modèles, de suivre les mesures de performance et de gérer efficacement les coûts.

Entreprises et startups

Entreprises et startups cherchant à intégrer l'IA dans leurs produits ou services. Elles ont besoin d'une solution rentable et évolutive pour accéder et gérer les LLM, ce qui leur permet de se concentrer sur leur activité principale.

Entreprises

Grandes entreprises qui ont besoin de gérer plusieurs LLM dans différentes équipes et projets. Elles nécessitent un contrôle centralisé, une optimisation des coûts et des capacités de surveillance robustes pour garantir une utilisation efficace et sécurisée des LLM.

Tarification de One API

Les détails de la tarification ne sont pas disponibles à partir de l'URL fournie. Il s'agit probablement d'un modèle freemium avec un niveau gratuit pour une utilisation de base et des forfaits payants pour des limites de requêtes plus élevées et des fonctionnalités avancées. Contactez le fournisseur pour une tarification spécifique.