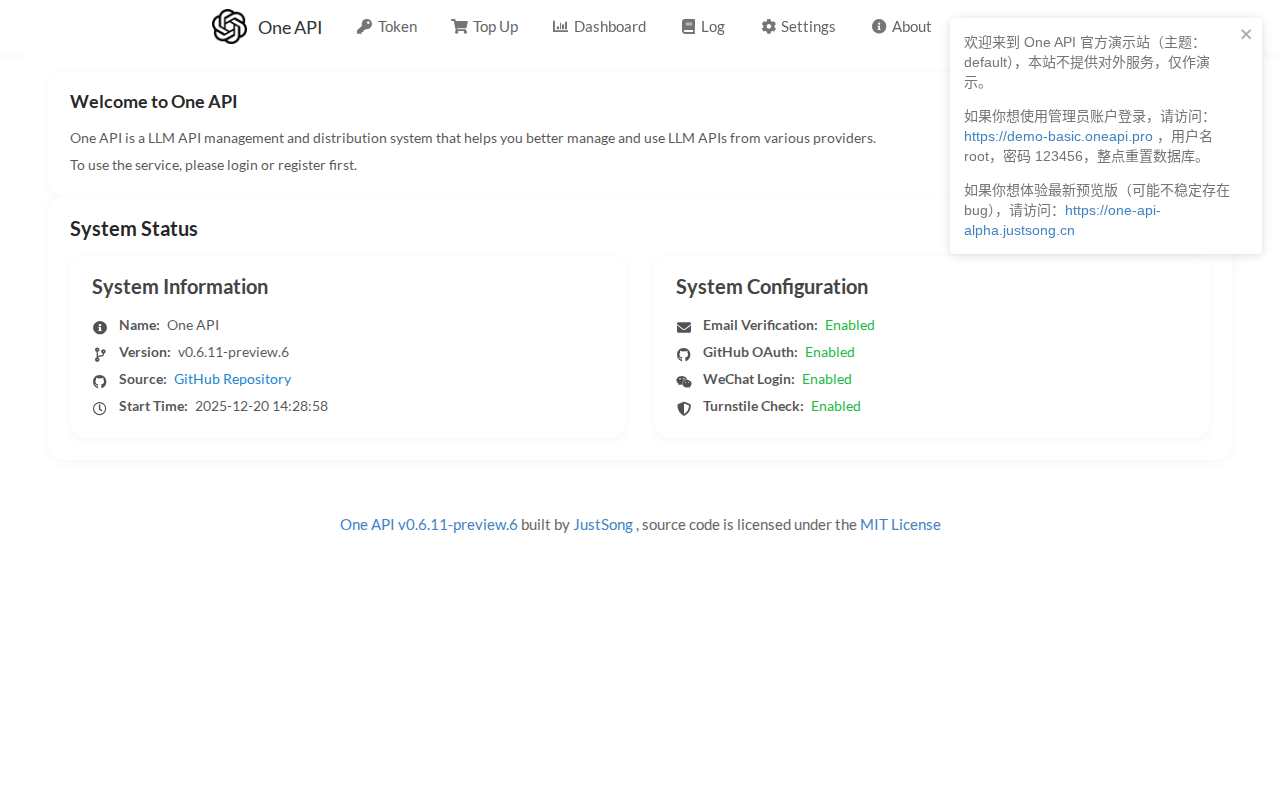

One API とは

1つのAPIが、様々な大規模言語モデル(LLM)へのアクセスを統合します。個々のAPIエンドポイントや認証方法の複雑さを抽象化することで、異なるLLMをアプリケーションに統合するプロセスを簡素化します。これにより、開発者はモデルを簡単に切り替え、コストを管理し、ロードバランシングやレート制限などの機能を実装できます。直接的なAPI統合とは異なり、One APIは集中管理、監視、バージョン管理を提供します。プロキシアーキテクチャを使用して、リクエストを適切なLLMプロバイダーにルーティングし、OpenAI、Cohereなどのモデルをサポートします。これは、単一のLLMプロバイダーに縛られることなく、AIを活用したアプリケーションを構築しようとする開発者、研究者、企業にとって特に有益です。

One API の主な機能

統合APIインターフェース

複数のLLMにアクセスするための単一で一貫したAPIエンドポイントを提供します。これにより、統合が簡素化され、モデルを切り替えるために必要なコードが削減されます。たとえば、開発者は、コアアプリケーションロジックを変更することなく、GPT-3.5からGPT-4に簡単な設定変更で切り替えることができます。この抽象化レイヤーは、リクエスト形式とレスポンス構造の違いも処理します。

モデルの切り替えとルーティング

パフォーマンス、コスト、または可用性に基づいて、異なるLLMを簡単に切り替えることができます。リクエストを最も適切なモデルにインテリジェントにルーティングし、レイテンシやトークン価格などの要素を最適化します。これにより、異なるモデルのA/Bテストとリソースの動的割り当てが可能になります。ルーティングロジックは、リクエストサイズやユーザーの場所など、さまざまな基準に基づいてカスタマイズできます。

コスト管理と最適化

LLMの使用コストを監視および制御するためのツールを提供します。コスト追跡、予算設定、レート制限などの機能が含まれます。ユーザーは、支出制限を設定し、予算に近づくとアラートを受け取ることができます。プラットフォームは、インテリジェントなキャッシングやリクエストバッチ処理などの機能も提供して、コストを削減します。詳細な分析により、モデルの使用パターンに関する洞察が得られます。

集中認証

すべてのサポートされているLLMのAPIキーとアクセス資格情報を一元的に管理することにより、認証を簡素化します。これにより、機密情報が漏洩するリスクが軽減され、認証プロセスが合理化されます。APIキー、OAuth、カスタム認証スキームなど、さまざまな認証方法をサポートしています。すべてのAPIキーを安全に保存および管理します。

監視と分析

APIの使用状況、パフォーマンスメトリクス、エラー率をリアルタイムで監視します。リクエスト量、レイテンシ、モデルごとのコストを追跡するための詳細な分析ダッシュボードを提供します。これにより、ユーザーはボトルネックを特定し、パフォーマンスを最適化し、問題を迅速にトラブルシューティングできます。カスタマイズ可能なダッシュボードとアラート機能が利用可能です。

One API の使い方

残念ながら、提供されたURLにはプレースホルダーしか表示されていません。詳細な情報がないため、詳細な使用方法ガイドを作成することはできません。ただし、製品の説明に基づくと、一般的な手順は次のようになります。1. アカウントにサインアップします。2. 必要なLLMプロバイダー(例:OpenAI)のAPIキーを取得します。3. APIキーを使用してOne APIプラットフォームを設定します。4. アプリケーションでOne APIエンドポイントを使用して、LLMにリクエストを送信します。5. One APIダッシュボードを通じて使用状況を監視し、コストを管理します。

One API の利用シーン

AIチャットボット開発

チャットボットを構築する開発者は、One APIを使用して、GPT-3.5やGPT-4などのさまざまなLLMにアクセスできます。応答の品質、コスト、またはレイテンシを最適化するために、モデルを簡単に切り替えることができます。これにより、異なるLLM構成の迅速なプロトタイピングとA/Bテストが可能になり、より良いユーザーエクスペリエンスにつながります。

コンテンツ生成

コンテンツクリエイターは、One APIを活用して、さまざまなLLMを使用して記事、要約、ソーシャルメディアの投稿を生成できます。さまざまなモデルの出力を比較し、ニーズに最適なものを選択できます。これにより、コンテンツ作成プロセスが合理化され、さまざまなライティングスタイルを試すことができます。

アプリケーション統合

ソフトウェア開発者は、LLMをアプリケーションに統合して、自然言語処理、テキスト要約、感情分析などの機能を提供できます。One APIは、統合インターフェースを提供することにより、統合プロセスを簡素化し、開発時間と複雑さを軽減します。これにより、開発者はAPI統合の管理ではなく、機能の構築に集中できます。

研究と実験

研究者は、One APIを使用して、さまざまなLLMを実験し、さまざまなタスクでのパフォーマンスを比較できます。モデルを簡単に切り替え、使用状況メトリクスを追跡し、結果を分析できます。これにより、LLMの機能に関する研究が促進され、特定のアプリケーションに最適なモデルを特定するのに役立ちます。

One API が役立つ人

AIアプリケーション開発者

LLMを利用するアプリケーションを構築する開発者。個々のAPI統合、認証、およびコスト管理の複雑さに対処することなく、複数のLLMにアクセスして管理するための簡素化された方法が必要です。

研究者とデータサイエンティスト

プロジェクトでさまざまなLLMを実験する必要がある研究者とデータサイエンティスト。モデルを簡単に切り替え、パフォーマンスメトリクスを追跡し、コストを効果的に管理できるというメリットがあります。

企業とスタートアップ

製品またはサービスにAIを統合しようとしている企業とスタートアップ。LLMにアクセスして管理するための費用対効果が高く、スケーラブルなソリューションが必要であり、コアビジネスに集中できます。

企業

さまざまなチームとプロジェクトで複数のLLMを管理する必要がある大企業。効率的で安全なLLMの使用を確保するために、集中管理、コスト最適化、および堅牢な監視機能が必要です。

One API の料金プラン

提供されたURLからは価格の詳細を入手できません。基本的な使用のための無料ティアと、より高いリクエスト制限と高度な機能のための有料プランがあるフリーミアムモデルである可能性があります。具体的な価格については、ベンダーにお問い合わせください。