Apache Airflow

프로그래밍 방식 워크플로우 오케스트레이션

무료

지원 플랫폼

web

Apache Airflow란 무엇인가요

Apache Airflow는 프로그래밍 방식으로 워크플로우를 작성, 예약 및 모니터링하기 위한 플랫폼입니다. 사용자가 파이프라인을 Python 코드로 정의할 수 있도록 하여 데이터 처리 작업에 대한 유연성과 제어 기능을 제공합니다. Airflow의 핵심 가치는 복잡한 워크플로우를 오케스트레이션하여 작업이 올바른 순서로 실행되고 종속성을 효과적으로 처리하도록 보장하는 데 있습니다. 기존 cron 작업 또는 스크립팅과 달리 Airflow는 대규모 워크플로우를 모니터링, 로깅 및 관리하기 위한 강력한 UI를 제공합니다. 모듈식 아키텍처와 클라우드 제공업체 및 타사 서비스와의 광범위한 통합을 통해 다양한 환경에 적응할 수 있습니다. 데이터 엔지니어, 데이터 과학자 및 DevOps 팀은 Airflow의 데이터 파이프라인, 머신 러닝 모델 교육 및 인프라 관리를 자동화하고 간소화하는 기능을 활용합니다.

Apache Airflow의 핵심 기능

Python 기반 워크플로우 정의

Airflow는 Python을 사용하여 워크플로우(DAG)를 정의하므로 개발자는 Python 생태계의 모든 기능을 활용할 수 있습니다. 여기에는 스케줄링을 위해 루프, 조건문 및 날짜/시간 형식과 같은 표준 Python 기능을 사용하는 것이 포함됩니다. 이 접근 방식은 유연성을 제공하고 명령줄 또는 XML 기반 워크플로우 정의의 제한 사항을 피하여 동적 파이프라인 생성 및 복잡한 논리 구현을 가능하게 합니다.

확장 가능하고 모듈식 아키텍처

Airflow의 모듈식 설계는 많은 수의 동시 작업을 처리하도록 확장할 수 있습니다. 메시지 큐(예: Celery, RabbitMQ)를 사용하여 작업자를 오케스트레이션하여 더 많은 작업자 노드를 추가하여 수평 확장을 가능하게 합니다. 이 아키텍처는 Airflow가 수많은 종속성 및 높은 데이터 볼륨을 가진 복잡한 워크플로우를 관리할 수 있도록 보장하여 엔터프라이즈급 배포에 적합하게 만듭니다.

강력한 웹 UI

Airflow는 워크플로우를 모니터링, 예약 및 관리하기 위한 사용자 친화적인 웹 UI를 제공합니다. UI는 실시간 작업 상태 업데이트, 자세한 로그 및 작업을 트리거, 일시 중지 및 재시도하는 기능을 제공합니다. 이 중앙 집중식 인터페이스는 워크플로우 관리를 단순화하고 파이프라인 성능에 대한 통찰력을 제공하며 수동 개입의 필요성을 줄여 운영 효율성을 향상시킵니다.

광범위한 통합

Airflow는 Google Cloud Platform, Amazon Web Services, Microsoft Azure 및 많은 타사 도구를 포함한 다양한 서비스와 통합하기 위한 광범위한 사전 구축된 연산자를 제공합니다. 이러한 연산자는 서로 다른 플랫폼에서 작업을 실행하는 프로세스를 단순화하여 사용자 지정 스크립팅의 필요성을 줄이고 데이터 파이프라인 및 기타 워크플로우의 개발을 가속화합니다.

동적 파이프라인 생성

Airflow는 Python 코드를 통해 동적 파이프라인 생성을 허용합니다. 즉, 데이터 또는 기타 매개변수를 기반으로 파이프라인을 동적으로 인스턴스화하는 코드를 작성할 수 있습니다. 이 기능은 반복적인 작업을 처리하거나, 여러 소스에서 데이터를 처리하거나, 변화하는 비즈니스 요구 사항에 적응하는 파이프라인을 생성하는 데 특히 유용하여 유연성과 자동화를 향상시킵니다.

오픈 소스 및 커뮤니티 주도

Airflow는 활발한 커뮤니티가 있는 오픈 소스 프로젝트입니다. 즉, 사용자는 프로젝트에 기여하고, 경험을 공유하고, 풍부한 리소스와 지원에 액세스할 수 있습니다. 오픈 소스 특성은 투명성, 협업 및 지속적인 개선을 촉진하여 Airflow가 강력하고 적응 가능한 워크플로우 오케스트레이션 플랫폼으로 유지되도록 보장합니다.

Apache Airflow 사용 방법

- pip를 사용하여 Airflow 설치:

pip install apache-airflow.,2. Airflow 데이터베이스 초기화:airflow db init.,3. 워크플로우 작업 및 종속성을 정의하는 DAG(Directed Acyclic Graph)를 Python으로 생성.,4. DAG 파일을 Airflow 홈 디렉토리 내의dags폴더에 배치.,5. Airflow 웹 서버 및 스케줄러 시작:airflow webserver -p 8080및airflow scheduler.,6. 브라우저에서 Airflow UI에 액세스하여(일반적으로http://localhost:8080) 워크플로우를 모니터링하고 관리.

Apache Airflow의 활용 사례

데이터 파이프라인 자동화

데이터 엔지니어는 Airflow를 사용하여 ETL(Extract, Transform, Load) 프로세스를 자동화합니다. 다양한 소스에서 데이터를 추출하고, Spark 또는 Pandas와 같은 도구를 사용하여 변환하고, 데이터 웨어하우스에 로드하기 위해 DAG를 정의합니다. 이렇게 하면 데이터가 일관되게 업데이트되고 분석 준비가 되어 시간과 리소스를 절약할 수 있습니다.

머신 러닝 모델 교육

데이터 과학자는 Airflow를 사용하여 머신 러닝 모델의 교육을 예약하고 관리합니다. 데이터 전처리, 모델 교육, 평가 및 배포를 오케스트레이션하기 위해 DAG를 생성합니다. 이렇게 하면 ML 수명 주기가 자동화되어 모델이 최신 데이터로 정기적으로 재교육되고 효율적으로 배포됩니다.

인프라 관리

DevOps 엔지니어는 Airflow를 사용하여 인프라 작업을 자동화합니다. 서버 프로비저닝, 애플리케이션 배포 및 클라우드 리소스 관리를 위한 워크플로우를 생성합니다. 이러한 작업을 올바른 순서로, 필요한 종속성과 함께 실행하여 운영 효율성을 향상시킵니다.

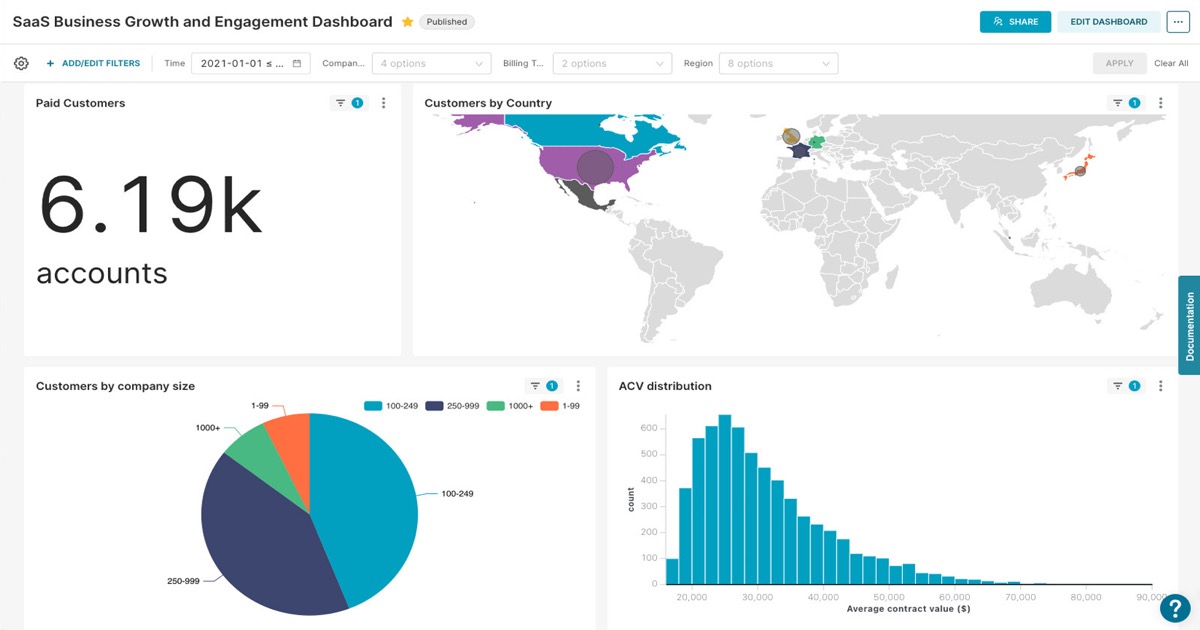

보고 및 분석

분석가는 Airflow를 사용하여 보고서 및 대시보드 생성을 자동화합니다. 데이터베이스에서 데이터를 추출하고, 변환하고, SQL 또는 Python 스크립트와 같은 도구를 사용하여 보고서를 생성하기 위해 DAG를 정의합니다. 이렇게 하면 보고서가 정기적으로 생성되고 최신 통찰력을 제공합니다.

Apache Airflow이 도움이 되는 사람

데이터 엔지니어

데이터 엔지니어는 데이터 파이프라인을 구축하고 관리하기 위해 Airflow가 필요합니다. ETL 프로세스를 자동화하여 데이터가 효율적으로 변환되고 로드되도록 합니다. Airflow의 예약 및 모니터링 기능은 데이터 품질을 유지하고 수동 개입을 줄이는 데 도움이 됩니다.

데이터 과학자

데이터 과학자는 머신 러닝 수명 주기를 자동화하기 위해 Airflow를 사용합니다. 데이터 전처리, 모델 교육, 평가 및 배포를 위한 워크플로우를 생성합니다. 이를 통해 수동 오케스트레이션 대신 모델 개발 및 분석에 집중할 수 있습니다.

DevOps 엔지니어

DevOps 엔지니어는 인프라 작업을 자동화하기 위해 Airflow를 사용합니다. 서버 프로비저닝, 애플리케이션 배포 및 클라우드 리소스 관리를 위한 워크플로우를 생성합니다. 이렇게 하면 운영 효율성이 향상되고 오류 위험이 줄어듭니다.

비즈니스 분석가

비즈니스 분석가는 보고 및 분석 프로세스를 자동화하기 위해 Airflow를 사용합니다. 데이터를 추출하고, 변환하고, 보고서를 생성하기 위한 워크플로우를 생성합니다. 이렇게 하면 보고서가 정기적으로 생성되고 최신 통찰력을 제공합니다.

Apache Airflow의 요금제

Apache License 2.0 (오픈 소스). 사용, 수정 및 배포가 무료입니다.