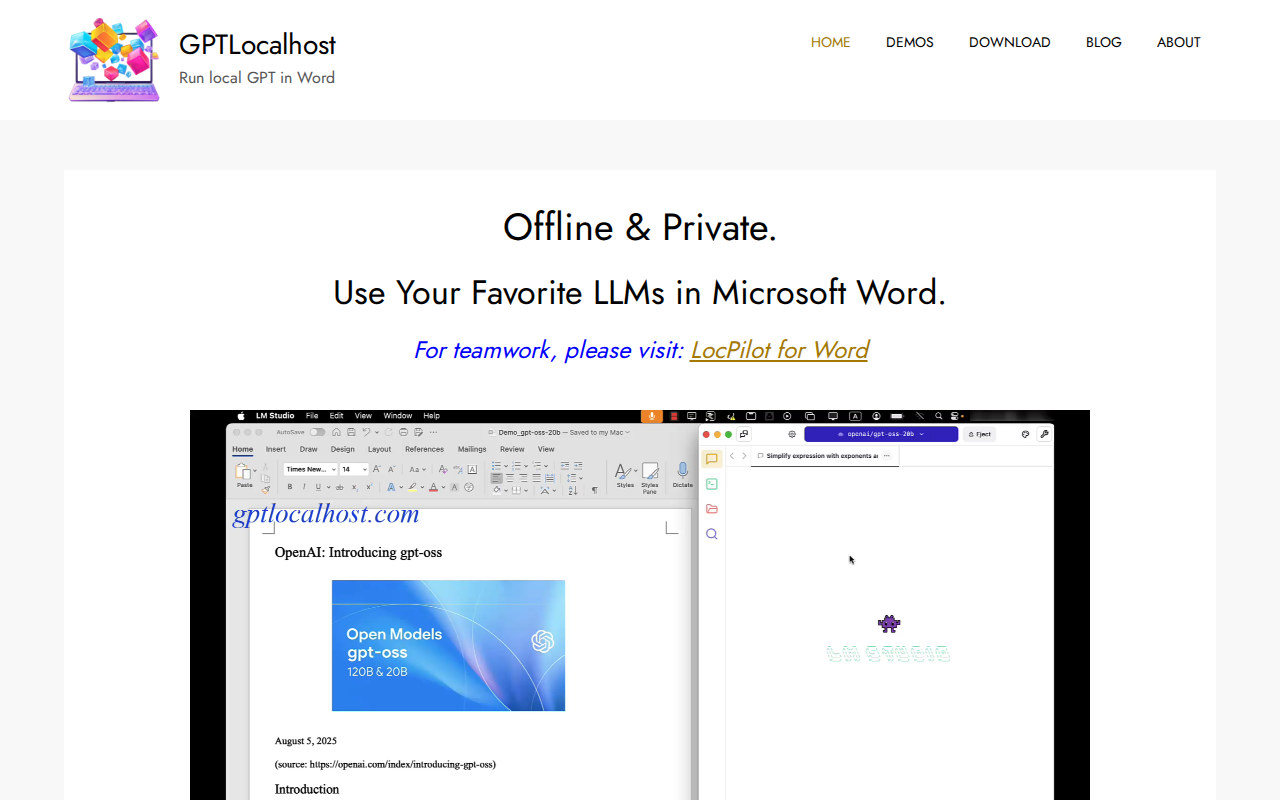

GPTLocalhost

Acesso LLM local e troca de modelos

Grátis

Plataformas suportadas

web

Tags de ferramenta

O que é GPTLocalhost

GPTLocalhost fornece um ambiente local para interagir com Modelos de Linguagem Grandes (LLMs). Ele permite que os usuários executem e experimentem com vários LLMs localmente, oferecendo flexibilidade e controle sobre suas interações de IA. Ao contrário das soluções baseadas em nuvem, o GPTLocalhost prioriza a privacidade e reduz a latência, mantendo os modelos em sua máquina. A plataforma suporta a troca perfeita de modelos, permitindo que os usuários comparem e contrastem diferentes LLMs, como o IBM Granite 4, para tarefas como análise de contratos. Isso é alcançado por meio de uma interface amigável e um processo de instalação simples, tornando-o acessível a desenvolvedores e pesquisadores. O principal benefício é a capacidade de experimentar com LLMs sem depender de APIs externas ou incorrer em custos de nuvem, tornando-o ideal para quem prioriza a privacidade de dados e a prototipagem rápida.

Principais recursos do GPTLocalhost

Execução LLM local

GPTLocalhost permite executar LLMs diretamente em sua máquina local, eliminando a necessidade de APIs baseadas em nuvem. Isso reduz significativamente a latência, melhora a privacidade dos dados e minimiza os custos associados às chamadas de API externas. Isso é particularmente benéfico para dados confidenciais ou aplicativos que exigem respostas em tempo real. A execução local utiliza os recursos da sua máquina (CPU/GPU) para processamento.

Troca perfeita de modelos

Alterne facilmente entre diferentes LLMs, como o IBM Granite 4, para comparar o desempenho e a adequação para várias tarefas. Esse recurso é crucial para experimentação e seleção do modelo ideal para um caso de uso específico. A plataforma fornece uma interface unificada para interagir com diferentes modelos, simplificando o processo de avaliação e permitindo a prototipagem rápida.

Design focado na privacidade

Ao executar LLMs localmente, o GPTLocalhost garante que seus dados permaneçam privados e seguros. Isso é particularmente importante para aplicativos que lidam com informações confidenciais ou que estão em conformidade com regulamentos rigorosos de privacidade de dados. O modelo de execução local elimina o risco de violações de dados ou acesso não autorizado associado a soluções baseadas em nuvem.

Interface amigável

O GPTLocalhost oferece uma interface amigável para interagir com LLMs, tornando-o acessível a desenvolvedores e usuários não técnicos. A interface simplifica o processo de envio de prompts, recebimento de respostas e gerenciamento de diferentes modelos. Essa facilidade de uso acelera o processo de experimentação e desenvolvimento.

Disponibilidade de demonstração

Fornece demonstrações prontamente disponíveis, mostrando os recursos do GPTLocalhost. Essas demonstrações permitem que os usuários entendam rapidamente a funcionalidade da plataforma e os possíveis casos de uso. As demonstrações geralmente incluem configurações pré-configuradas e exemplos de prompts, permitindo que os usuários comecem rapidamente sem configuração extensa.

Como usar o GPTLocalhost

- Visite o site do GPTLocalhost e revise as demonstrações e documentação disponíveis.,2. Identifique o LLM específico que você deseja usar (por exemplo, IBM Granite 4) e certifique-se de ter o acesso ou as credenciais necessárias.,3. Siga as instruções de instalação fornecidas no site para configurar o GPTLocalhost em sua máquina local.,4. Configure o LLM escolhido dentro do GPTLocalhost, fornecendo quaisquer chaves de API ou caminhos de modelo necessários.,5. Use a interface ou API fornecida para interagir com o LLM, enviando prompts e recebendo respostas.,6. Experimente com diferentes modelos, alternando entre eles dentro do ambiente GPTLocalhost para comparar o desempenho.

Casos de uso do GPTLocalhost

Análise de contratos

Profissionais jurídicos podem usar o GPTLocalhost com modelos como o IBM Granite 4 para analisar contratos localmente. Eles podem carregar documentos, identificar cláusulas-chave e avaliar riscos potenciais sem enviar dados confidenciais para servidores externos. Isso melhora a eficiência e garante a privacidade dos dados durante os processos de revisão de contratos.

Pesquisa e experimentação em IA

Pesquisadores podem aproveitar o GPTLocalhost para experimentar vários LLMs, comparar seu desempenho e ajustar modelos para tarefas específicas. Eles podem testar diferentes prompts, avaliar a qualidade das respostas e iterar em seus modelos de IA em um ambiente local controlado, acelerando o ciclo de pesquisa.

Desenvolvimento local

Desenvolvedores podem integrar LLMs em seus aplicativos sem depender de APIs externas. Eles podem criar chatbots, ferramentas de geração de conteúdo e outros recursos com tecnologia de IA que são executados localmente, reduzindo a latência e melhorando a capacidade de resposta. Essa abordagem é ideal para aplicativos offline ou aqueles que exigem alta segurança de dados.

Conformidade com a privacidade de dados

Organizações que lidam com dados confidenciais podem usar o GPTLocalhost para cumprir os regulamentos de privacidade de dados. Ao executar LLMs localmente, eles podem garantir que os dados nunca saiam de seu ambiente seguro, reduzindo o risco de violações de dados e garantindo a conformidade com o GDPR, HIPAA e outros regulamentos.

Quem se beneficia do GPTLocalhost

Pesquisadores de IA

Os pesquisadores se beneficiam da capacidade de experimentar diferentes LLMs localmente, comparar seu desempenho e ajustar modelos sem as restrições das APIs baseadas em nuvem. Isso permite uma iteração mais rápida e mais controle sobre o processo de pesquisa.

Desenvolvedores

Os desenvolvedores podem integrar LLMs em seus aplicativos com maior controle sobre a privacidade e a latência dos dados. O GPTLocalhost permite que eles criem recursos com tecnologia de IA que são executados localmente, melhorando a capacidade de resposta e reduzindo a dependência de serviços externos.

Profissionais jurídicos

Profissionais jurídicos podem usar o GPTLocalhost para analisar contratos e outros documentos jurídicos localmente, garantindo a privacidade dos dados e reduzindo o risco de violações de dados. Isso melhora a eficiência e a segurança durante o processo de revisão de contratos.

Cientistas de dados

Cientistas de dados podem aproveitar o GPTLocalhost para prototipar e testar soluções baseadas em LLM em um ambiente seguro e controlado. A capacidade de alternar entre modelos e executá-los localmente acelera o desenvolvimento e a avaliação de aplicativos de IA.

Preços do GPTLocalhost

Os detalhes de preços não são explicitamente mencionados na página de demonstração fornecida. No entanto, a natureza do produto sugere um modelo gratuito ou de código aberto, pois se concentra na execução local e na troca de modelos.

Mais ferramentas semelhantes ao GPTLocalhost

ChatGPT

ChatGPT é uma ferramenta avançada de IA conversacional que gera respostas de texto semelhantes às humanas.

Kimi

Kimi é um chatbot com tecnologia de IA projetado para auxiliar usuários com várias dúvidas e tarefas.