Apache Airflow

Orquestração de Fluxos Program.

Grátis

Plataformas suportadas

web

Tags de ferramenta

O que é Apache Airflow

Apache Airflow é uma plataforma para criar, agendar e monitorar fluxos de trabalho programaticamente. Ele permite que os usuários definam pipelines como código Python, proporcionando flexibilidade e controle sobre as tarefas de processamento de dados. O valor principal do Airflow reside em sua capacidade de orquestrar fluxos de trabalho complexos, garantindo que as tarefas sejam executadas na ordem correta e lidem com as dependências de forma eficaz. Ao contrário dos trabalhos cron tradicionais ou scripts, o Airflow oferece uma interface de usuário robusta para monitorar, registrar e gerenciar fluxos de trabalho em escala. Sua arquitetura modular e extensas integrações com provedores de nuvem e serviços de terceiros o tornam adaptável a diversos ambientes. Engenheiros de dados, cientistas de dados e equipes de DevOps se beneficiam da capacidade do Airflow de automatizar e otimizar pipelines de dados, treinamento de modelos de machine learning e gerenciamento de infraestrutura.

Principais recursos do Apache Airflow

Definição de Fluxo em Python

O Airflow usa Python para definir fluxos de trabalho (DAGs), permitindo que os desenvolvedores aproveitem todo o poder do ecossistema Python. Isso inclui o uso de recursos Python padrão, como loops, instruções condicionais e formatos de data/hora para agendamento. Essa abordagem oferece flexibilidade e evita as limitações das definições de fluxo de trabalho baseadas em linha de comando ou XML, permitindo a geração dinâmica de pipeline e a implementação de lógica complexa.

Arquitetura Escalável e Modular

O design modular do Airflow permite que ele seja dimensionado para lidar com um grande número de tarefas simultâneas. Ele usa uma fila de mensagens (por exemplo, Celery, RabbitMQ) para orquestrar os workers, permitindo o dimensionamento horizontal adicionando mais nós de worker. Essa arquitetura garante que o Airflow possa gerenciar fluxos de trabalho complexos com inúmeras dependências e altos volumes de dados, tornando-o adequado para implantações em nível empresarial.

Interface Web Robusta

O Airflow fornece uma interface web amigável para monitorar, agendar e gerenciar fluxos de trabalho. A interface do usuário oferece atualizações de status de tarefas em tempo real, logs detalhados e a capacidade de acionar, pausar e repetir tarefas. Essa interface centralizada simplifica o gerenciamento do fluxo de trabalho, fornece informações sobre o desempenho do pipeline e reduz a necessidade de intervenção manual, melhorando a eficiência operacional.

Extensas Integrações

O Airflow oferece uma ampla gama de operadores pré-construídos para integração com vários serviços, incluindo Google Cloud Platform, Amazon Web Services, Microsoft Azure e muitas ferramentas de terceiros. Esses operadores simplificam o processo de execução de tarefas em diferentes plataformas, reduzindo a necessidade de scripts personalizados e acelerando o desenvolvimento de pipelines de dados e outros fluxos de trabalho.

Geração Dinâmica de Pipeline

O Airflow permite a geração dinâmica de pipeline por meio de código Python. Isso significa que você pode escrever código que instancia pipelines dinamicamente, com base em dados ou outros parâmetros. Esse recurso é particularmente útil para lidar com tarefas recorrentes, processar dados de várias fontes ou criar pipelines que se adaptam às mudanças nos requisitos de negócios, aprimorando a flexibilidade e a automação.

Código Aberto e Orientado pela Comunidade

O Airflow é um projeto de código aberto com uma comunidade vibrante. Isso significa que os usuários podem contribuir para o projeto, compartilhar suas experiências e acessar uma riqueza de recursos e suporte. A natureza de código aberto promove a transparência, a colaboração e a melhoria contínua, garantindo que o Airflow permaneça uma plataforma de orquestração de fluxo de trabalho poderosa e adaptável.

Como usar o Apache Airflow

- Instale o Airflow usando pip:

pip install apache-airflow.,2. Inicialize o banco de dados do Airflow:airflow db init.,3. Crie um DAG (Directed Acyclic Graph) em Python, definindo suas tarefas e dependências de fluxo de trabalho.,4. Coloque seu arquivo DAG na pastadagsdentro do seu diretório home do Airflow.,5. Inicie o servidor web e o agendador do Airflow:airflow webserver -p 8080eairflow scheduler.,6. Acesse a interface do usuário do Airflow em seu navegador (geralmente emhttp://localhost:8080) para monitorar e gerenciar seus fluxos de trabalho.

Casos de uso do Apache Airflow

Automação de Pipeline de Dados

Engenheiros de dados usam o Airflow para automatizar o processo ETL (Extract, Transform, Load). Eles definem DAGs para extrair dados de várias fontes, transformá-los usando ferramentas como Spark ou Pandas e carregá-los em um data warehouse. Isso garante que os dados sejam atualizados de forma consistente e estejam prontos para análise, economizando tempo e recursos.

Treinamento de Modelo de Machine Learning

Cientistas de dados usam o Airflow para agendar e gerenciar o treinamento de modelos de machine learning. Eles criam DAGs para orquestrar o pré-processamento de dados, treinamento de modelos, avaliação e implantação. Isso automatiza o ciclo de vida do ML, garantindo que os modelos sejam retreinados regularmente com os dados mais recentes e implantados de forma eficiente.

Gerenciamento de Infraestrutura

Engenheiros de DevOps usam o Airflow para automatizar tarefas de infraestrutura, como provisionamento de servidores, implantação de aplicativos e gerenciamento de recursos de nuvem. Eles criam DAGs para orquestrar essas tarefas, garantindo que sejam executadas na ordem correta e com as dependências necessárias, melhorando a eficiência operacional.

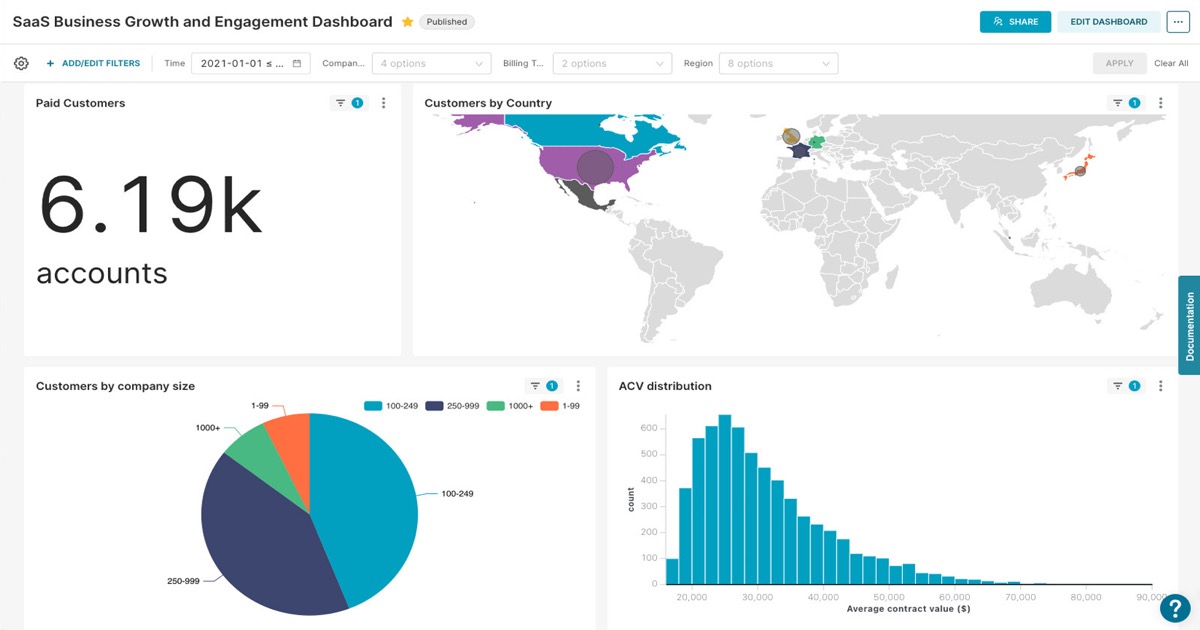

Relatórios e Análises

Analistas usam o Airflow para automatizar a geração de relatórios e painéis. Eles definem DAGs para extrair dados de bancos de dados, transformá-los e gerar relatórios usando ferramentas como SQL ou scripts Python. Isso garante que os relatórios sejam gerados em um cronograma regular e forneçam insights atualizados.

Quem se beneficia do Apache Airflow

Engenheiros de Dados

Engenheiros de dados precisam do Airflow para construir e gerenciar pipelines de dados. Eles o usam para automatizar processos ETL, garantindo que os dados sejam transformados e carregados de forma eficiente. Os recursos de agendamento e monitoramento do Airflow os ajudam a manter a qualidade dos dados e reduzir a intervenção manual.

Cientistas de Dados

Cientistas de dados usam o Airflow para automatizar o ciclo de vida do machine learning. Eles criam fluxos de trabalho para pré-processamento de dados, treinamento de modelos, avaliação e implantação. Isso lhes permite se concentrar no desenvolvimento e análise de modelos, em vez da orquestração manual.

Engenheiros de DevOps

Engenheiros de DevOps usam o Airflow para automatizar tarefas de infraestrutura. Eles criam fluxos de trabalho para provisionamento de servidores, implantação de aplicativos e gerenciamento de recursos de nuvem. Isso melhora a eficiência operacional e reduz o risco de erros.

Analistas de Negócios

Analistas de negócios usam o Airflow para automatizar processos de relatórios e análises. Eles criam fluxos de trabalho para extrair dados, transformá-los e gerar relatórios. Isso garante que os relatórios sejam gerados em um cronograma regular e forneçam insights atualizados.

Preços do Apache Airflow

Licença Apache 2.0 (Código Aberto). Livre para usar, modificar e distribuir.