Cleanlab

Scores de confiança LLM em tempo real

Pago

Plataformas suportadas

web

Tags de ferramenta

O que é Cleanlab

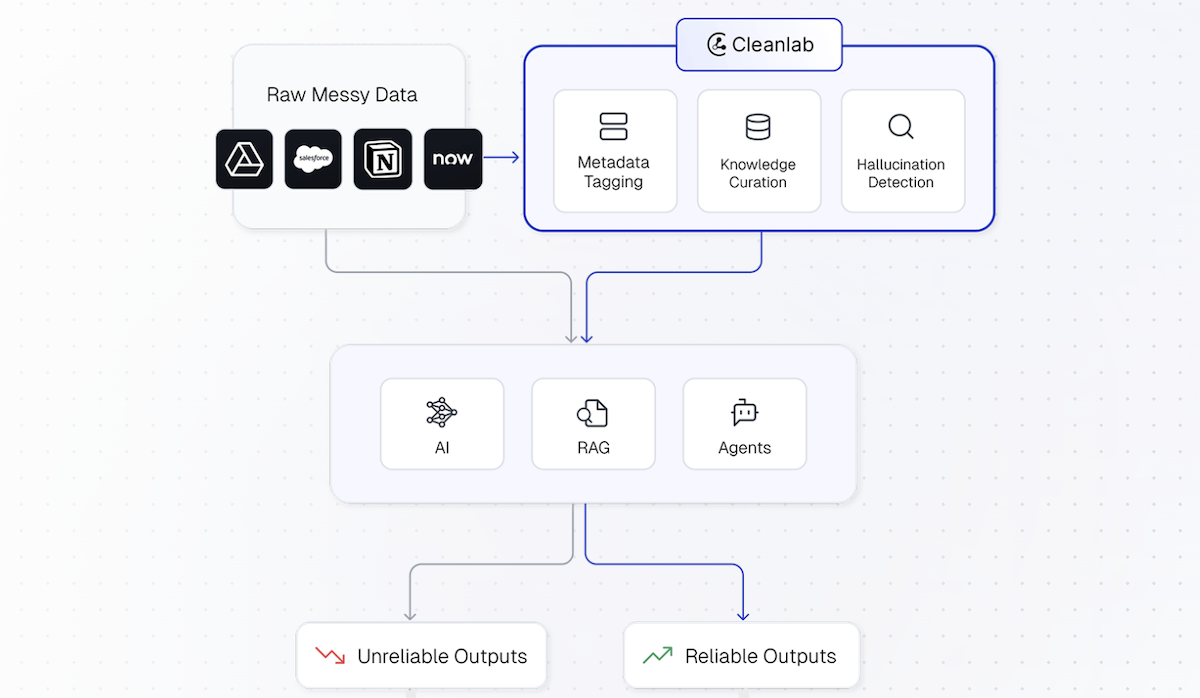

O Trustworthy Language Model (TLM) da Cleanlab fornece pontuações de confiabilidade em tempo real para as saídas de Large Language Models (LLM), mitigando o risco de alucinações e respostas incorretas. Ele ajuda os usuários a identificar respostas LLM confiáveis, garantindo a precisão e a confiabilidade de aplicações baseadas em IA. Ao contrário das ferramentas genéricas de avaliação de LLM, o TLM se concentra na pontuação em tempo real, integrando-se perfeitamente aos fluxos de trabalho existentes. Ele utiliza algoritmos avançados para avaliar a confiabilidade das saídas de LLM, fornecendo insights acionáveis para melhorar a confiabilidade da IA. O TLM é ideal para empresas e desenvolvedores que buscam construir soluções de IA confiáveis, como chatbots, ferramentas de extração de dados e sistemas baseados em agentes. Ele capacita os usuários a tomar decisões informadas com base na confiabilidade das respostas do LLM, aprimorando a experiência do usuário e os resultados dos negócios.

Principais recursos do Cleanlab

Pontuação de Confiança em Tempo Real

O TLM fornece pontuações de confiabilidade imediatas para as saídas do LLM, permitindo a tomada de decisões dinâmica durante o tempo de execução. Isso contrasta com os métodos de processamento em lote, permitindo a identificação imediata de respostas não confiáveis. A pontuação é baseada em um algoritmo proprietário que analisa vários fatores, incluindo a confiança do LLM, a consistência da resposta e a presença de erros factuais. Essa capacidade em tempo real é crucial para aplicações onde a precisão imediata é fundamental.

Detecção de Alucinações

O TLM foi projetado para detectar e sinalizar alucinações geradas pelo LLM, que são respostas incorretas ou fabricadas. Ele utiliza técnicas avançadas para identificar inconsistências e imprecisões factuais na saída do LLM. Esse recurso é fundamental para aplicações onde a precisão é fundamental, como diagnóstico médico ou análise financeira, onde informações incorretas podem ter sérias consequências. O sistema fornece uma pontuação de confiança indicando a probabilidade de uma alucinação.

Critérios de Avaliação Personalizáveis

O TLM permite que os usuários definam critérios de avaliação personalizados adaptados aos seus casos de uso e dados específicos. Essa flexibilidade permite que os usuários adaptem a pontuação de confiabilidade às suas necessidades específicas, garantindo que o sistema se alinhe aos seus requisitos exclusivos. Os usuários podem especificar os tipos de erros a serem priorizados e os níveis aceitáveis de risco. Essa personalização é essencial para otimizar o desempenho de aplicações LLM em diversos domínios.

Integração com Vários LLMs

O TLM suporta a integração com uma ampla gama de LLMs, incluindo modelos OpenAI e outros, fornecendo ampla compatibilidade. Isso permite que os usuários apliquem os recursos de pontuação de confiabilidade do TLM, independentemente do seu provedor de LLM escolhido. O sistema foi projetado para ser adaptável a diferentes arquiteturas de LLM e formatos de saída, garantindo uma integração perfeita. Essa flexibilidade simplifica o processo de incorporação do TLM em fluxos de trabalho de IA existentes.

Soluções Específicas para Casos de Uso

A Cleanlab oferece soluções e guias pré-construídos para vários casos de uso, como chatbots RAG confiáveis, extração de dados e sistemas baseados em agentes. Essas soluções fornecem um ponto de partida para implementar o TLM em aplicações específicas, simplificando o processo de desenvolvimento. Os guias oferecem as melhores práticas e exemplos para integrar o TLM em diferentes fluxos de trabalho. Essa abordagem direcionada ajuda os usuários a implantar e se beneficiar rapidamente dos recursos do TLM.

Como usar o Cleanlab

- Acesse a documentação do Cleanlab TLM e familiarize-se com as APIs e SDKs disponíveis.,2. Integre a API TLM em sua aplicação ou fluxo de trabalho baseado em LLM existente.,3. Envie as respostas do LLM para a API TLM para pontuação de confiabilidade em tempo real.,4. Analise as pontuações de confiança retornadas para identificar saídas de LLM potencialmente não confiáveis.,5. Implemente estratégias para lidar com pontuações de baixa confiança, como reformular prompts, validar respostas cruzadas ou fornecer respostas alternativas.,6. Monitore e refine continuamente sua aplicação LLM com base nos insights do TLM para melhorar a precisão e a confiabilidade.

Casos de uso do Cleanlab

Chatbots Confiáveis

Os desenvolvedores podem usar o TLM para construir chatbots que fornecem informações confiáveis e precisas, pontuando a confiabilidade de cada resposta. Isso garante que o chatbot evite gerar respostas incorretas ou enganosas, melhorando a confiança e a satisfação do usuário. Por exemplo, um chatbot de atendimento ao cliente pode usar o TLM para verificar a precisão de suas respostas antes de fornecê-las a um usuário.

Extração de Dados

O TLM pode ser usado para melhorar a precisão da extração de dados de texto não estruturado. Ao pontuar a confiabilidade das informações extraídas, os usuários podem identificar e corrigir erros, garantindo a qualidade dos dados. Por exemplo, uma empresa pode usar o TLM para extrair informações-chave de contratos, verificando a precisão dos dados extraídos antes de usá-los.

Sistemas Baseados em Agentes

O TLM pode ser integrado em sistemas baseados em agentes para garantir a confiabilidade das ações e decisões dos agentes. Ao pontuar a confiabilidade das saídas dos agentes, os desenvolvedores podem impedir que os agentes tomem medidas com base em informações incorretas. Por exemplo, um agente de negociação financeira pode usar o TLM para verificar a precisão dos dados de mercado antes de fazer negociações.

Tomada de Decisão Sim/Não

O TLM pode ser aplicado para melhorar a precisão dos processos de tomada de decisão sim/não. Ao pontuar a confiabilidade das respostas do LLM, os usuários podem tomar decisões mais informadas com base em informações confiáveis. Por exemplo, uma ferramenta de diagnóstico médico pode usar o TLM para avaliar a confiabilidade do diagnóstico do LLM antes de fornecê-lo a um médico.

Quem se beneficia do Cleanlab

Desenvolvedores de IA

Os desenvolvedores de IA se beneficiam do TLM ao obter uma ferramenta para melhorar a confiabilidade e a precisão de suas aplicações baseadas em LLM. Eles podem usar o TLM para identificar e mitigar os riscos associados às alucinações do LLM, garantindo que suas aplicações forneçam informações confiáveis e ofereçam uma melhor experiência ao usuário.

Cientistas de Dados

Os cientistas de dados podem aproveitar o TLM para aprimorar a qualidade dos dados extraídos de LLMs. Ao pontuar a confiabilidade das saídas do LLM, os cientistas de dados podem melhorar a precisão de seus conjuntos de dados e modelos, levando a insights mais confiáveis e melhor tomada de decisão. Isso é especialmente útil para tarefas como anotação de dados e recuperação de informações.

Líderes de Negócios

Os líderes de negócios podem usar o TLM para construir confiança em seus produtos e serviços baseados em IA. Ao garantir a confiabilidade das respostas do LLM, eles podem melhorar a satisfação do cliente, reduzir o risco de desinformação e obter uma vantagem competitiva. Isso é crucial para aplicações que envolvem informações confidenciais ou tomada de decisão crítica.

Preços do Cleanlab

Detalhes de preços não disponíveis na documentação fornecida. Visite o site da Cleanlab para obter os planos de preços atuais.