Apache Airflow

Оркестрация рабочих процессов

Бесплатно

Поддерживаемые платформы

web

Теги инструментов

Что такое Apache Airflow

Apache Airflow — это платформа для программного создания, планирования и мониторинга рабочих процессов. Она позволяет пользователям определять конвейеры в виде кода Python, обеспечивая гибкость и контроль над задачами обработки данных. Основная ценность Airflow заключается в его способности оркестрировать сложные рабочие процессы, гарантируя, что задачи выполняются в правильном порядке и эффективно обрабатывают зависимости. В отличие от традиционных заданий cron или скриптов, Airflow предлагает надежный пользовательский интерфейс для мониторинга, ведения журналов и управления рабочими процессами в масштабе. Его модульная архитектура и широкая интеграция с облачными провайдерами и сторонними сервисами делают его адаптируемым к различным средам. Инженеры данных, специалисты по обработке данных и команды DevOps получают выгоду от способности Airflow автоматизировать и оптимизировать конвейеры данных, обучение моделей машинного обучения и управление инфраструктурой.

Основные функции Apache Airflow

Определение рабочих процессов на основе Python

Airflow использует Python для определения рабочих процессов (DAG), позволяя разработчикам использовать всю мощь экосистемы Python. Это включает в себя использование стандартных функций Python, таких как циклы, условные операторы и форматы даты/времени для планирования. Этот подход обеспечивает гибкость и позволяет избежать ограничений определений рабочих процессов на основе командной строки или XML, обеспечивая динамическую генерацию конвейеров и реализацию сложной логики.

Масштабируемая и модульная архитектура

Модульная конструкция Airflow позволяет масштабироваться для обработки большого количества одновременных задач. Он использует очередь сообщений (например, Celery, RabbitMQ) для оркестровки рабочих, обеспечивая горизонтальное масштабирование путем добавления дополнительных рабочих узлов. Эта архитектура гарантирует, что Airflow может управлять сложными рабочими процессами с многочисленными зависимостями и большими объемами данных, что делает его подходящим для развертываний на уровне предприятия.

Надежный веб-интерфейс

Airflow предоставляет удобный веб-интерфейс для мониторинга, планирования и управления рабочими процессами. Пользовательский интерфейс предлагает обновления статуса задач в реальном времени, подробные журналы и возможность запуска, приостановки и повторной попытки задач. Этот централизованный интерфейс упрощает управление рабочими процессами, предоставляет информацию о производительности конвейера и снижает потребность в ручном вмешательстве, повышая операционную эффективность.

Широкие интеграции

Airflow предлагает широкий спектр встроенных операторов для интеграции с различными сервисами, включая Google Cloud Platform, Amazon Web Services, Microsoft Azure и многие сторонние инструменты. Эти операторы упрощают процесс выполнения задач на разных платформах, уменьшая потребность в пользовательских скриптах и ускоряя разработку конвейеров данных и других рабочих процессов.

Динамическая генерация конвейеров

Airflow позволяет динамически генерировать конвейеры с помощью кода Python. Это означает, что вы можете писать код, который динамически создает конвейеры на основе данных или других параметров. Эта функция особенно полезна для обработки повторяющихся задач, обработки данных из нескольких источников или создания конвейеров, которые адаптируются к меняющимся бизнес-требованиям, повышая гибкость и автоматизацию.

Открытый исходный код и поддержка сообщества

Airflow — это проект с открытым исходным кодом с активным сообществом. Это означает, что пользователи могут вносить вклад в проект, делиться своим опытом и получать доступ к множеству ресурсов и поддержки. Открытый исходный код способствует прозрачности, сотрудничеству и постоянному совершенствованию, гарантируя, что Airflow остается мощной и адаптируемой платформой оркестровки рабочих процессов.

Как использовать Apache Airflow

- Установите Airflow с помощью pip:

pip install apache-airflow.,2. Инициализируйте базу данных Airflow:airflow db init.,3. Создайте DAG (направленный ациклический граф) на Python, определяющий задачи и зависимости вашего рабочего процесса.,4. Поместите файл DAG в папкуdagsв домашнем каталоге Airflow.,5. Запустите веб-сервер и планировщик Airflow:airflow webserver -p 8080иairflow scheduler.,6. Получите доступ к пользовательскому интерфейсу Airflow в своем браузере (обычно по адресуhttp://localhost:8080) для мониторинга и управления рабочими процессами.

Примеры использования Apache Airflow

Автоматизация конвейеров данных

Инженеры данных используют Airflow для автоматизации процесса ETL (Extract, Transform, Load). Они определяют DAG для извлечения данных из различных источников, преобразования их с помощью таких инструментов, как Spark или Pandas, и загрузки в хранилище данных. Это гарантирует, что данные постоянно обновляются и готовы к анализу, экономя время и ресурсы.

Обучение моделей машинного обучения

Специалисты по обработке данных используют Airflow для планирования и управления обучением моделей машинного обучения. Они создают DAG для оркестровки предварительной обработки данных, обучения моделей, оценки и развертывания. Это автоматизирует жизненный цикл ML, гарантируя, что модели регулярно переобучаются с использованием последних данных и эффективно развертываются.

Управление инфраструктурой

Инженеры DevOps используют Airflow для автоматизации задач инфраструктуры, таких как подготовка серверов, развертывание приложений и управление облачными ресурсами. Они создают DAG для оркестровки этих задач, гарантируя, что они выполняются в правильном порядке и с необходимыми зависимостями, повышая операционную эффективность.

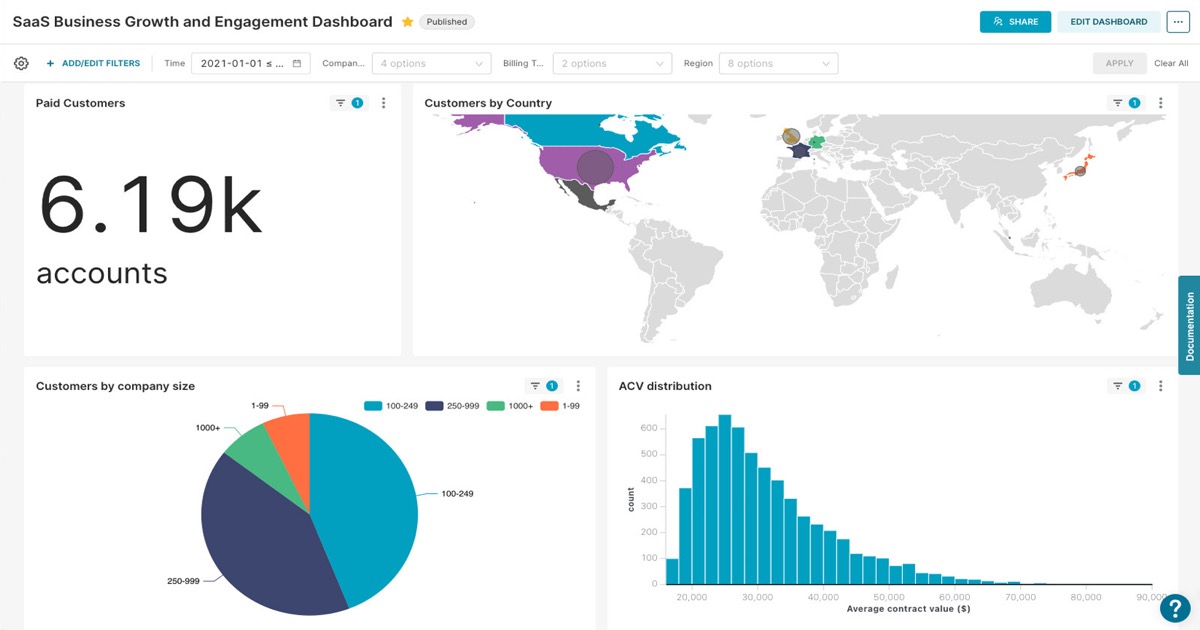

Отчетность и аналитика

Аналитики используют Airflow для автоматизации создания отчетов и панелей мониторинга. Они определяют DAG для извлечения данных из баз данных, их преобразования и создания отчетов с использованием таких инструментов, как SQL или скрипты Python. Это гарантирует, что отчеты генерируются по регулярному расписанию и предоставляют актуальную информацию.

Кому полезен Apache Airflow

Инженеры данных

Инженерам данных нужен Airflow для создания конвейеров данных и управления ими. Они используют его для автоматизации процессов ETL, обеспечивая эффективное преобразование и загрузку данных. Возможности планирования и мониторинга Airflow помогают им поддерживать качество данных и сокращать ручное вмешательство.

Специалисты по обработке данных

Специалисты по обработке данных используют Airflow для автоматизации жизненного цикла машинного обучения. Они создают рабочие процессы для предварительной обработки данных, обучения моделей, оценки и развертывания. Это позволяет им сосредоточиться на разработке моделей и анализе, а не на ручной оркестровке.

Инженеры DevOps

Инженеры DevOps используют Airflow для автоматизации задач инфраструктуры. Они создают рабочие процессы для подготовки серверов, развертывания приложений и управления облачными ресурсами. Это повышает операционную эффективность и снижает риск ошибок.

Бизнес-аналитики

Бизнес-аналитики используют Airflow для автоматизации процессов отчетности и аналитики. Они создают рабочие процессы для извлечения данных, их преобразования и создания отчетов. Это гарантирует, что отчеты генерируются по регулярному расписанию и предоставляют актуальную информацию.

Цены на Apache Airflow

Apache License 2.0 (Open Source). Бесплатное использование, изменение и распространение.