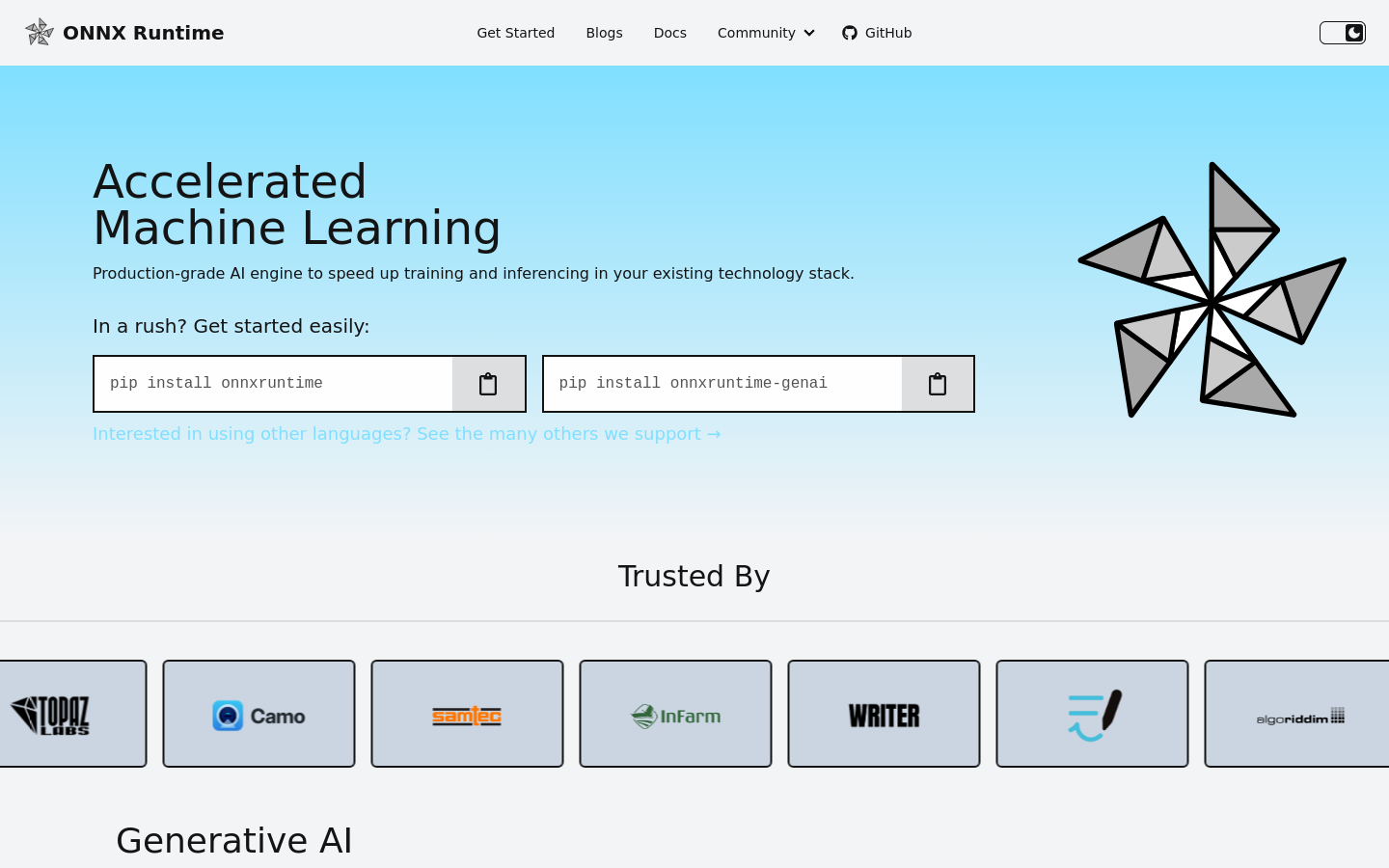

ONNX Runtime

เอนจิน Machine Learning แบบข้ามแพลตฟอร์มสำหรับการทำ Model Inference ที่มีประสิทธ

ฟรีเมียม

แพลตฟอร์มที่รองรับ

web

ONNX Runtime คืออะไร

ONNX Runtime คือ AI Engine ระดับโปรดักชันที่ออกแบบมาเพื่อแก้ปัญหาคอขวดทั่วไปในการปรับแต่งโมเดล Machine Learning ให้เหมาะสมกับสภาพแวดล้อมของฮาร์ดแวร์และซอฟต์แวร์ที่หลากหลาย ด้วยการจัดเตรียมอินเทอร์เฟซแบบรวมศูนย์สำหรับการเทรนและการทำ Inference ทำให้ทีมพัฒนาสามารถนำโมเดลไปใช้งานบน CPU, GPU และ NPU ได้โดยไม่สูญเสียประสิทธิภาพ ไม่ว่าคุณจะทำงานกับโมเดลภาษาขนาดใหญ่ (LLMs) หรือโมเดลคาดการณ์มาตรฐาน เอนจินนี้จะช่วยให้แอปพลิเคชันของคุณรักษาความหน่วงต่ำ (Low Latency) และมี Throughput สูงได้เสมอโดยไม่ขึ้นอยู่กับโครงสร้างพื้นฐานเบื้องหลัง ด้วยความยืดหยุ่นที่ออกแบบมาเป็นอย่างดี Runtime นี้จึงรองรับภาษาโปรแกรมที่หลากหลาย ไม่ว่าจะเป็น Python, C#, C++, Java, JavaScript และ Rust ทำให้เป็นตัวเลือกที่อเนกประสงค์สำหรับเทคโนโลยีสแต็กที่ซับซ้อน นอกจากนี้ยังช่วยเชื่อมช่องว่างระหว่างการพัฒนาและการใช้งานจริง ช่วยให้นักพัฒนาสามารถรักษาพฤติกรรมของโมเดลให้สอดคล้องกันได้ทั้งบน Linux, Windows, macOS, แพลตฟอร์มมือถือ และเว็บเบราว์เซอร์ การปรับปรุงกระบวนการทำงานของโมเดลที่ล้ำสมัยเหล่านี้ช่วยให้วิศวกรสามารถมุ่งเน้นไปที่การสร้างฟีเจอร์อัจฉริยะ แทนที่จะต้องเสียเวลากับปัญหาความเข้ากันได้ของฮาร์ดแวร์หรือประสิทธิภาพที่ลดลง

คุณสมบัติหลักของ ONNX Runtime

การเร่งความเร็วด้วยฮาร์ดแวร์ (Hardware Acceleration)

เพิ่มประสิทธิภาพทั้งในด้านความหน่วง (Latency), Throughput และการใช้หน่วยความจำบนฮาร์ดแวร์ที่หลากหลาย รวมถึง CPU, GPU และ NPU เพื่อให้มั่นใจว่าโมเดลของคุณทำงานได้อย่างมีประสิทธิภาพบนทุกอุปกรณ์

การรองรับข้ามแพลตฟอร์ม (Cross-Platform Support)

มอบความเข้ากันได้ที่แข็งแกร่งบนระบบปฏิบัติการหลัก เช่น Linux, Windows และ macOS รวมถึงแพลตฟอร์มมือถือและเว็บเบราว์เซอร์ ช่วยให้คุณมีกลยุทธ์ด้าน AI ที่สามารถพกพาไปใช้งานได้ทุกที่

การรองรับหลายภาษา (Multi-Language Support)

รองรับการใช้งานร่วมกับนักพัฒนาที่ใช้ Python, C#, C++, Java, JavaScript และ Rust ทำให้ง่ายต่อการนำ AI ประสิทธิภาพสูงไปรวมเข้ากับเทคโนโลยีสแต็กที่หลากหลายและมีอยู่เดิม

การรวม Generative AI (Generative AI Integration)

ช่วยให้สามารถนำโมเดลภาษาขนาดใหญ่ (LLMs) ที่ล้ำสมัยมาใช้งานได้จริง โดยรองรับงานขั้นสูง เช่น การสร้างข้อความและการสังเคราะห์ภาพภายในแอปพลิเคชันของคุณโดยตรง

วิธีใช้ ONNX Runtime

- เริ่มต้นด้วยการติดตั้งแพ็กเกจ Runtime ผ่านตัวจัดการแพ็กเกจที่คุณต้องการ เช่น 'pip install onnxruntime' หรือ 'pip install onnxruntime-genai' เพื่อตั้งค่าสภาพแวดล้อมของคุณ

- เริ่มต้นใช้งาน Runtime โดยการระบุเส้นทางไฟล์ของโมเดล Machine Learning ของคุณเข้าไปในคลาส 'InferenceSession' ซึ่งจะเป็นการเตรียมเอนจินให้พร้อมสำหรับการประมวลผลโมเดลของคุณ

- จัดรูปแบบข้อมูลนำเข้า (Input Data) ให้เป็นโครงสร้าง Tensor ตามที่กำหนด โดยตรวจสอบให้แน่ใจว่าตรงกับ Schema ข้อมูลนำเข้าที่โมเดลคาดหวัง เพื่อป้องกันข้อผิดพลาดระหว่างการประมวลผล

- รันโมเดลโดยเรียกใช้เมธอด 'session.run' พร้อมกับข้อมูลนำเข้าที่คุณเตรียมไว้ ซึ่งจะกระตุ้นให้เอนจินสร้างผลลัพธ์หรือการคาดการณ์ออกมาอย่างมีประสิทธิภาพ

- ตรวจสอบผลลัพธ์ที่ได้จาก Session เพื่อนำการคาดการณ์ของโมเดลไปรวมเข้ากับเวิร์กโฟลว์ของแอปพลิเคชันหรือตรรกะของบริการที่คุณมีอยู่ได้อย่างราบรื่น

กรณีการใช้งานของ ONNX Runtime

การปรับใช้ Edge AI

นักพัฒนาสามารถนำโมเดล AI ประสิทธิภาพสูงไปใช้งานบนอุปกรณ์ที่มีทรัพยากรจำกัด เช่น โทรศัพท์มือถือหรือฮาร์ดแวร์ IoT โดยใช้การตั้งค่า Runtime ที่ปรับแต่งมาเป็นพิเศษ

การให้บริการโมเดลในระดับโปรดักชัน

วิศวกรสามารถให้บริการโมเดล Machine Learning ในสภาพแวดล้อมการใช้งานจริงได้อย่างน่าเชื่อถือ เพื่อให้มั่นใจว่าแอปพลิเคชันของผู้ใช้ปลายทางจะได้รับประโยชน์จากความหน่วงที่ต่ำและ Throughput ที่สูง

การพัฒนาแอปพลิเคชันข้ามแพลตฟอร์ม

ทีมที่สร้างแอปพลิเคชันสำหรับหลายแพลตฟอร์มสามารถใช้ Runtime เดียวที่รวมศูนย์ เพื่อรักษาประสิทธิภาพของ AI ให้สอดคล้องกันทั้งบนเดสก์ท็อป มือถือ และเว็บ

ใครที่ได้ประโยชน์จาก ONNX Runtime

วิศวกร Machine Learning

ผู้เชี่ยวชาญที่มุ่งเน้นการปรับแต่งความเร็วในการทำ Inference ของโมเดลและการใช้ทรัพยากรให้เกิดประสิทธิภาพสูงสุด เพื่อให้มั่นใจว่าแอปพลิเคชัน AI ของตนเป็นไปตามมาตรฐานประสิทธิภาพระดับโปรดักชัน

นักพัฒนาซอฟต์แวร์

นักพัฒนาที่ต้องการรวม AI เข้ากับแอปพลิเคชันผ่านภาษาโปรแกรมต่างๆ และต้องการเอนจินการประมวลผลที่มีประสิทธิภาพสูงและเชื่อถือได้ ซึ่งสามารถเข้ากับสแต็กเทคโนโลยีเดิมที่มีอยู่ได้

ราคา ONNX Runtime

ONNX Runtime เป็นซอฟต์แวร์โอเพนซอร์สที่ใช้งานได้ฟรี