Apache Airflow

การจัดระเบียบเวิร์กโฟลว์แบบโปรแกรม

แพลตฟอร์มที่รองรับ

web

แท็กเครื่องมือ

Apache Airflow คืออะไร

Apache Airflow เป็นแพลตฟอร์มสำหรับการเขียน กำหนดเวลา และตรวจสอบเวิร์กโฟลว์แบบโปรแกรม มันช่วยให้ผู้ใช้สามารถกำหนดไปป์ไลน์เป็นโค้ด Python ซึ่งให้ความยืดหยุ่นและการควบคุมงานประมวลผลข้อมูล คุณค่าหลักของ Airflow อยู่ที่ความสามารถในการจัดระเบียบเวิร์กโฟลว์ที่ซับซ้อน ทำให้มั่นใจได้ว่างานจะทำงานตามลำดับที่ถูกต้องและจัดการการพึ่งพาได้อย่างมีประสิทธิภาพ ซึ่งแตกต่างจากงาน cron หรือสคริปต์แบบดั้งเดิม Airflow มี UI ที่แข็งแกร่งสำหรับการตรวจสอบ การบันทึก และการจัดการเวิร์กโฟลว์ในระดับต่างๆ สถาปัตยกรรมแบบแยกส่วนและการผสานรวมที่ครอบคลุมกับผู้ให้บริการคลาวด์และบริการของบุคคลที่สามทำให้สามารถปรับให้เข้ากับสภาพแวดล้อมที่หลากหลายได้ วิศวกรข้อมูล นักวิทยาศาสตร์ข้อมูล และทีม DevOps ได้รับประโยชน์จากความสามารถของ Airflow ในการทำงานอัตโนมัติและปรับปรุงไปป์ไลน์ข้อมูล การฝึกอบรมโมเดลการเรียนรู้ของเครื่อง และการจัดการโครงสร้างพื้นฐาน

คุณสมบัติหลักของ Apache Airflow

การกำหนดเวิร์กโฟลว์ตาม Python

Airflow ใช้ Python สำหรับการกำหนดเวิร์กโฟลว์ (DAGs) ทำให้ผู้พัฒนามีอำนาจในการใช้ประโยชน์จากพลังทั้งหมดของระบบนิเวศ Python ซึ่งรวมถึงการใช้คุณสมบัติ Python มาตรฐาน เช่น ลูป คำสั่งเงื่อนไข และรูปแบบวันที่/เวลาสำหรับการกำหนดเวลา แนวทางนี้ให้ความยืดหยุ่นและหลีกเลี่ยงข้อจำกัดของการกำหนดเวิร์กโฟลว์บนบรรทัดคำสั่งหรือ XML ทำให้สามารถสร้างไปป์ไลน์แบบไดนามิกและการใช้งานตรรกะที่ซับซ้อนได้

สถาปัตยกรรมที่ปรับขนาดได้และเป็นโมดูล

การออกแบบแบบแยกส่วนของ Airflow ช่วยให้สามารถปรับขนาดเพื่อจัดการงานพร้อมกันจำนวนมากได้ มันใช้คิวข้อความ (เช่น Celery, RabbitMQ) เพื่อจัดระเบียบคนงาน ทำให้สามารถปรับขนาดในแนวนอนได้โดยการเพิ่มโหนดคนงานมากขึ้น สถาปัตยกรรมนี้ช่วยให้มั่นใจได้ว่า Airflow สามารถจัดการเวิร์กโฟลว์ที่ซับซ้อนพร้อมการพึ่งพาจำนวนมากและปริมาณข้อมูลสูง ทำให้เหมาะสำหรับการปรับใช้ระดับองค์กร

UI เว็บที่แข็งแกร่ง

Airflow มี UI เว็บที่เป็นมิตรต่อผู้ใช้สำหรับการตรวจสอบ กำหนดเวลา และจัดการเวิร์กโฟลว์ UI มีการอัปเดตสถานะงานแบบเรียลไทม์ บันทึกโดยละเอียด และความสามารถในการเรียกใช้ หยุดชั่วคราว และลองงานใหม่ อินเทอร์เฟซส่วนกลางนี้ช่วยลดความซับซ้อนในการจัดการเวิร์กโฟลว์ ให้ข้อมูลเชิงลึกเกี่ยวกับประสิทธิภาพของไปป์ไลน์ และลดความจำเป็นในการแทรกแซงด้วยตนเอง ซึ่งช่วยปรับปรุงประสิทธิภาพการดำเนินงาน

การผสานรวมที่ครอบคลุม

Airflow มีตัวดำเนินการที่สร้างไว้ล่วงหน้ามากมายสำหรับการผสานรวมกับบริการต่างๆ รวมถึง Google Cloud Platform, Amazon Web Services, Microsoft Azure และเครื่องมือของบุคคลที่สามมากมาย ตัวดำเนินการเหล่านี้ช่วยลดความซับซ้อนของกระบวนการดำเนินการงานบนแพลตฟอร์มต่างๆ ลดความจำเป็นในการเขียนสคริปต์แบบกำหนดเอง และเร่งการพัฒนาไปป์ไลน์ข้อมูลและเวิร์กโฟลว์อื่นๆ

การสร้างไปป์ไลน์แบบไดนามิก

Airflow อนุญาตให้สร้างไปป์ไลน์แบบไดนามิกผ่านโค้ด Python ซึ่งหมายความว่าคุณสามารถเขียนโค้ดที่สร้างไปป์ไลน์แบบไดนามิกตามข้อมูลหรือพารามิเตอร์อื่นๆ คุณสมบัตินี้มีประโยชน์อย่างยิ่งสำหรับการจัดการงานที่เกิดซ้ำ การประมวลผลข้อมูลจากหลายแหล่ง หรือการสร้างไปป์ไลน์ที่ปรับให้เข้ากับข้อกำหนดทางธุรกิจที่เปลี่ยนแปลงไป ซึ่งช่วยเพิ่มความยืดหยุ่นและระบบอัตโนมัติ

โอเพนซอร์สและขับเคลื่อนโดยชุมชน

Airflow เป็นโครงการโอเพนซอร์สที่มีชุมชนที่มีชีวิตชีวา ซึ่งหมายความว่าผู้ใช้สามารถมีส่วนร่วมในโครงการ แบ่งปันประสบการณ์ และเข้าถึงทรัพยากรและการสนับสนุนมากมาย ธรรมชาติแบบโอเพนซอร์สส่งเสริมความโปร่งใส การทำงานร่วมกัน และการปรับปรุงอย่างต่อเนื่อง ทำให้มั่นใจได้ว่า Airflow ยังคงเป็นแพลตฟอร์มการจัดระเบียบเวิร์กโฟลว์ที่มีประสิทธิภาพและปรับเปลี่ยนได้

วิธีใช้ Apache Airflow

- ติดตั้ง Airflow โดยใช้ pip:

pip install apache-airflow.,2. เริ่มต้นฐานข้อมูล Airflow:airflow db init.,3. สร้าง DAG (Directed Acyclic Graph) ใน Python กำหนดงานเวิร์กโฟลว์และการพึ่งพาของคุณ.,4. วางไฟล์ DAG ของคุณในโฟลเดอร์dagsภายในไดเรกทอรี home Airflow ของคุณ.,5. เริ่มเว็บเซิร์ฟเวอร์และตัวกำหนดตารางเวลา Airflow:airflow webserver -p 8080และairflow scheduler.,6. เข้าถึง UI Airflow ในเบราว์เซอร์ของคุณ (โดยปกติที่http://localhost:8080) เพื่อตรวจสอบและจัดการเวิร์กโฟลว์ของคุณ

กรณีการใช้งานของ Apache Airflow

ระบบอัตโนมัติไปป์ไลน์ข้อมูล

วิศวกรข้อมูลใช้ Airflow เพื่อทำให้กระบวนการ ETL (Extract, Transform, Load) เป็นไปโดยอัตโนมัติ พวกเขาจะกำหนด DAG เพื่อดึงข้อมูลจากแหล่งต่างๆ แปลงข้อมูลโดยใช้เครื่องมือต่างๆ เช่น Spark หรือ Pandas และโหลดลงในคลังข้อมูล สิ่งนี้ทำให้มั่นใจได้ว่าข้อมูลจะได้รับการอัปเดตอย่างสม่ำเสมอและพร้อมสำหรับการวิเคราะห์ ช่วยประหยัดเวลาและทรัพยากร

การฝึกอบรมโมเดลการเรียนรู้ของเครื่อง

นักวิทยาศาสตร์ข้อมูลใช้ Airflow เพื่อกำหนดเวลาและจัดการการฝึกอบรมโมเดลการเรียนรู้ของเครื่อง พวกเขาจะสร้าง DAG เพื่อจัดระเบียบการประมวลผลข้อมูลเบื้องต้น การฝึกอบรมโมเดล การประเมิน และการปรับใช้ สิ่งนี้ทำให้วงจรชีวิต ML เป็นไปโดยอัตโนมัติ ทำให้มั่นใจได้ว่าโมเดลจะได้รับการฝึกอบรมใหม่เป็นประจำด้วยข้อมูลล่าสุดและปรับใช้อย่างมีประสิทธิภาพ

การจัดการโครงสร้างพื้นฐาน

วิศวกร DevOps ใช้ Airflow เพื่อทำให้งานโครงสร้างพื้นฐานเป็นไปโดยอัตโนมัติ พวกเขาจะสร้าง DAG เพื่อจัดระเบียบงานเหล่านี้ ทำให้มั่นใจได้ว่าจะดำเนินการตามลำดับที่ถูกต้องและมีการพึ่งพาที่จำเป็น ซึ่งช่วยปรับปรุงประสิทธิภาพการดำเนินงาน

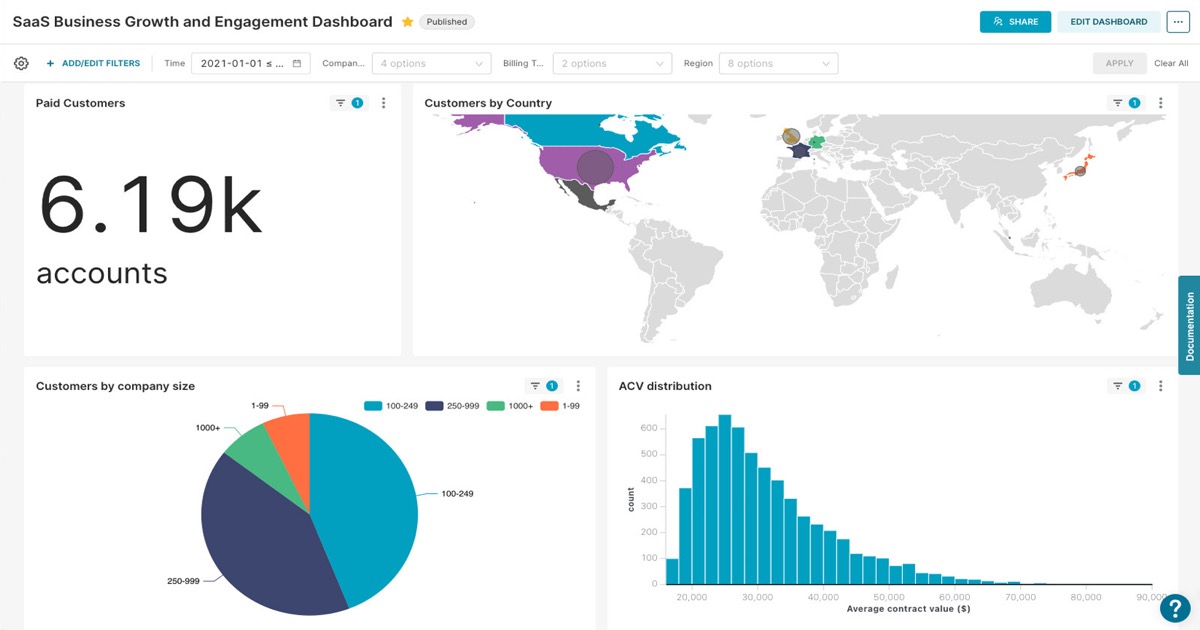

การรายงานและการวิเคราะห์

นักวิเคราะห์ใช้ Airflow เพื่อทำให้การสร้างรายงานและแดชบอร์ดเป็นไปโดยอัตโนมัติ พวกเขาจะกำหนด DAG เพื่อดึงข้อมูลจากฐานข้อมูล แปลงข้อมูล และสร้างรายงานโดยใช้เครื่องมือต่างๆ เช่น SQL หรือสคริปต์ Python สิ่งนี้ทำให้มั่นใจได้ว่ารายงานจะถูกสร้างขึ้นตามกำหนดการปกติและให้ข้อมูลเชิงลึกที่เป็นปัจจุบัน

ใครที่ได้ประโยชน์จาก Apache Airflow

วิศวกรข้อมูล

วิศวกรข้อมูลต้องการ Airflow เพื่อสร้างและจัดการไปป์ไลน์ข้อมูล พวกเขาใช้มันเพื่อทำให้กระบวนการ ETL เป็นไปโดยอัตโนมัติ ทำให้มั่นใจได้ว่าข้อมูลจะถูกแปลงและโหลดอย่างมีประสิทธิภาพ ความสามารถในการกำหนดเวลาและการตรวจสอบของ Airflow ช่วยให้พวกเขาคงไว้ซึ่งคุณภาพของข้อมูลและลดการแทรกแซงด้วยตนเอง

นักวิทยาศาสตร์ข้อมูล

นักวิทยาศาสตร์ข้อมูลใช้ Airflow เพื่อทำให้วงจรชีวิตการเรียนรู้ของเครื่องเป็นไปโดยอัตโนมัติ พวกเขาจะสร้างเวิร์กโฟลว์สำหรับการประมวลผลข้อมูลเบื้องต้น การฝึกอบรมโมเดล การประเมิน และการปรับใช้ สิ่งนี้ช่วยให้พวกเขามุ่งเน้นไปที่การพัฒนาและวิเคราะห์โมเดลมากกว่าการจัดระเบียบด้วยตนเอง

วิศวกร DevOps

วิศวกร DevOps ใช้ Airflow เพื่อทำให้งานโครงสร้างพื้นฐานเป็นไปโดยอัตโนมัติ พวกเขาจะสร้างเวิร์กโฟลว์สำหรับการจัดเตรียมเซิร์ฟเวอร์ การปรับใช้แอปพลิเคชัน และการจัดการทรัพยากรคลาวด์ ซึ่งช่วยปรับปรุงประสิทธิภาพการดำเนินงานและลดความเสี่ยงของข้อผิดพลาด

นักวิเคราะห์ธุรกิจ

นักวิเคราะห์ธุรกิจใช้ Airflow เพื่อทำให้กระบวนการรายงานและการวิเคราะห์เป็นไปโดยอัตโนมัติ พวกเขาจะสร้างเวิร์กโฟลว์เพื่อดึงข้อมูล แปลงข้อมูล และสร้างรายงาน สิ่งนี้ทำให้มั่นใจได้ว่ารายงานจะถูกสร้างขึ้นตามกำหนดการปกติและให้ข้อมูลเชิงลึกที่เป็นปัจจุบัน

ราคา Apache Airflow

Apache License 2.0 (โอเพนซอร์ส) ใช้งาน แก้ไข และแจกจ่ายได้ฟรี