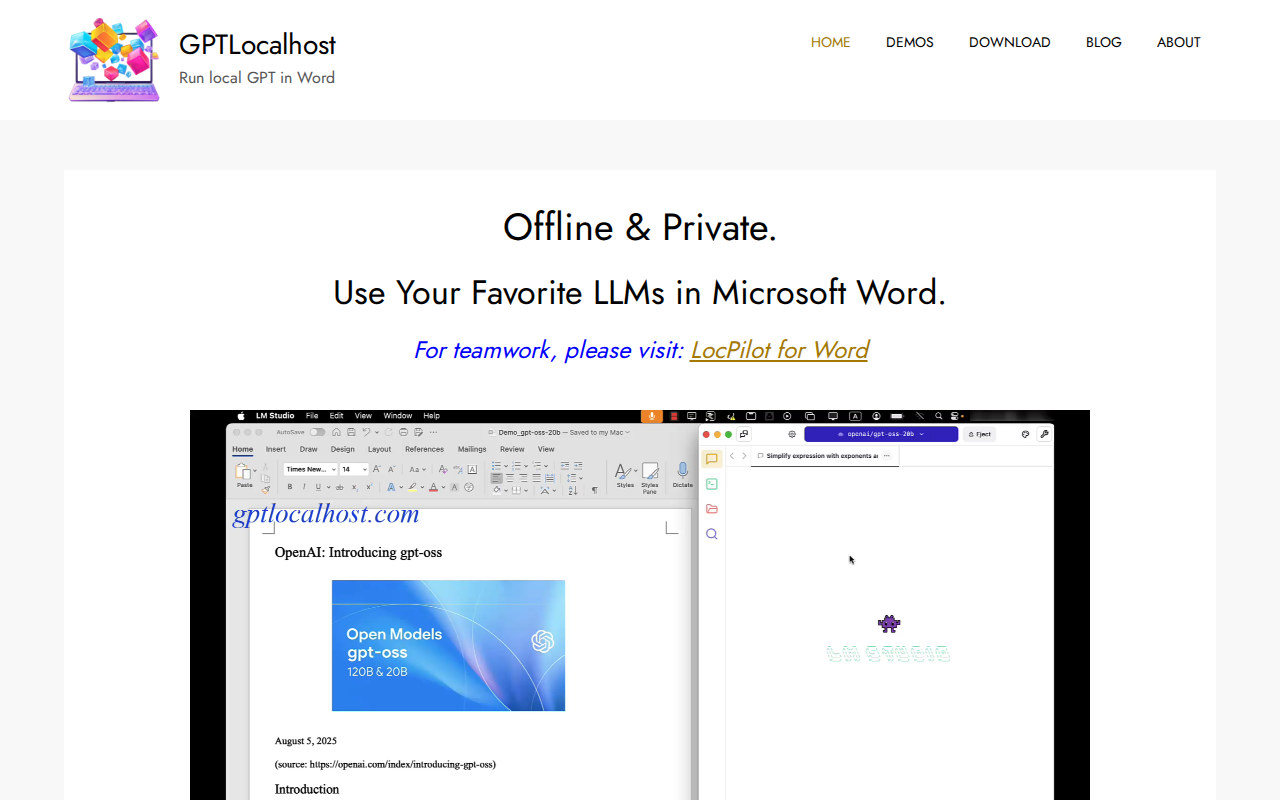

什麼是 GPTLocalhost

GPTLocalhost 提供本地環境,用於與大型語言模型 (LLM) 互動。它允許使用者在本地運行和實驗各種 LLM,提供 AI 互動的靈活性和控制。與基於雲端的解決方案不同,GPTLocalhost 優先考慮隱私並透過將模型保留在您的機器上來減少延遲。該平台支援無縫模型切換,使使用者能夠比較和對比不同的 LLM,例如 IBM Granite 4,以執行合約分析等任務。這透過使用者友善的介面和簡單的安裝過程實現,使其可供開發人員和研究人員使用。主要優點是能夠實驗 LLM,而無需依賴外部 API 或產生雲端成本,這使其成為優先考慮資料隱私和快速原型設計的理想選擇。

GPTLocalhost 的核心功能

本地 LLM 執行

GPTLocalhost 允許直接在您的本地機器上運行 LLM,無需基於雲端的 API。這顯著減少了延遲,提高了資料隱私性,並最大限度地減少了與外部 API 呼叫相關的成本。這對於敏感資料或需要即時回應的應用程式特別有利。本地執行利用您機器的資源(CPU/GPU)進行處理。

無縫模型切換

輕鬆在不同的 LLM 之間切換,例如 IBM Granite 4,以比較效能和對各種任務的適用性。此功能對於實驗和為特定用例選擇最佳模型至關重要。該平台提供了一個統一的介面,用於與不同的模型互動,簡化了評估過程並實現了快速原型設計。

注重隱私的設計

透過在本地運行 LLM,GPTLocalhost 確保您的資料保持私密和安全。這對於處理敏感資訊或遵守嚴格的資料隱私法規的應用程式尤其重要。本地執行模型消除了與基於雲端的解決方案相關的資料洩露或未經授權訪問的風險。

使用者友善的介面

GPTLocalhost 提供了一個使用者友善的介面,用於與 LLM 互動,使其可供開發人員和非技術使用者使用。該介面簡化了提交提示、接收回應和管理不同模型的過程。這種易用性加速了實驗和開發過程。

演示可用性

提供現成的演示,展示 GPTLocalhost 的功能。這些演示允許使用者快速了解平台的功能和潛在的用例。演示通常包括預先配置的設置和範例提示,使使用者無需大量配置即可快速上手。

如何使用 GPTLocalhost

- 訪問 GPTLocalhost 網站並查看可用的演示和文件。2. 確定您希望使用的特定 LLM(例如,IBM Granite 4)並確保您擁有必要的訪問權限或憑證。3. 按照網站上提供的安裝說明在您的本地機器上設置 GPTLocalhost。4. 在 GPTLocalhost 內配置所選的 LLM,提供任何所需的 API 金鑰或模型路徑。5. 使用提供的介面或 API 與 LLM 互動,提交提示並接收回應。6. 透過在 GPTLocalhost 環境中切換不同模型來進行實驗,以比較效能。

GPTLocalhost 的使用情境

合約分析

法律專業人士可以使用 GPTLocalhost 與 IBM Granite 4 等模型在本地分析合約。他們可以上傳文件、識別關鍵條款並評估潛在風險,而無需將敏感資料發送到外部伺服器。這提高了效率並確保了合約審查過程中的資料隱私。

AI 研究與實驗

研究人員可以利用 GPTLocalhost 來實驗各種 LLM,比較它們的效能,並針對特定任務微調模型。他們可以測試不同的提示、評估回應品質,並在受控的本地環境中迭代他們的 AI 模型,從而加速研究週期。

本地開發

開發人員可以將 LLM 整合到他們的應用程式中,而無需依賴外部 API。他們可以構建聊天機器人、內容生成工具和其他在本地運行的 AI 驅動功能,從而減少延遲並提高響應速度。這種方法非常適合離線應用程式或需要高資料安全性的應用程式。

資料隱私合規性

處理敏感資料的組織可以使用 GPTLocalhost 來遵守資料隱私法規。透過在本地運行 LLM,他們可以確保資料永遠不會離開其安全環境,從而降低資料洩露的風險並確保符合 GDPR、HIPAA 和其他法規。

誰適合使用 GPTLocalhost

AI 研究人員

研究人員受益於在本地實驗不同 LLM、比較其效能以及微調模型的能力,而無需雲端 API 的限制。這允許更快的迭代和對研究過程的更多控制。

開發人員

開發人員可以將 LLM 整合到他們的應用程式中,更好地控制資料隱私和延遲。GPTLocalhost 使他們能夠構建在本地運行的 AI 驅動功能,從而提高響應速度並減少對外部服務的依賴。

法律專業人士

法律專業人士可以使用 GPTLocalhost 在本地分析合約和其他法律文件,確保資料隱私並降低資料洩露的風險。這提高了合約審查過程中的效率和安全性。

資料科學家

資料科學家可以利用 GPTLocalhost 在安全且受控的環境中對基於 LLM 的解決方案進行原型設計和測試。在模型之間切換並在本地運行它們的能力加速了 AI 應用程式的開發和評估。

GPTLocalhost 的價格方案

在提供的演示頁面上未明確提及定價詳細資訊。但是,產品的性質表明它是一個免費或開源模型,因为它侧重于本地执行和模型切换。