什麼是 localbench

localbench 為 GGUF 格式的大型語言模型提供嚴謹且數據驅動的效能分析。與依賴 Wikipedia 等靜態數據集的通用基準測試不同,localbench 使用 25 萬個 token 的真實任務數據,透過 KL 散度(KL divergence)評估模型品質。它專門比較 Unsloth 和 Bartowski 等主要貢獻者的量化輸出,為開發者提供透明的視角,了解不同量化方法如何影響模型的困惑度(perplexity)與推理能力。對於需要在硬體限制與輸出保真度之間取得平衡的本地 LLM 部署工程師而言,此工具至關重要。

localbench 的核心功能

KL 散度基準測試

使用 KL 散度來衡量原始 FP16 模型與量化 GGUF 版本之間的統計距離。這為量化過程中的「資訊損失」提供了數學上嚴謹的指標,在評估模型壓縮後保留原始推理能力的程度方面,比單純的困惑度分數更準確。

真實任務評估

基準測試是在 25 萬個真實領域特定任務的 token 上進行,而非標準學術數據集。這確保了結果能反映模型在實際生產環境(如程式碼生成、摘要與指令遵循)中的行為,而不僅僅是測試對靜態文本的記憶能力。

上傳者比較分析

直接比較來自 Unsloth 和 Bartowski 等不同創作者的量化輸出。這讓使用者能識別哪些量化流程能產生最穩定且高保真的 GGUF 檔案,幫助開發者避免使用因次優量化參數或轉換腳本而導致效能下降的模型。

硬體感知優化

專注於 CPU/GPU 混合推理的行業標準 GGUF 格式。透過提供特定量化等級在消費級硬體上表現的清晰數據,localbench 協助開發者在不超過本地 VRAM 限制的情況下,最大化上下文視窗與 token 吞吐量。

透明的方法論

提供測試流程的完整可見性。透過記錄評估所使用的確切 token 數量與任務類型,localbench 實現了結果的可重現性,使社群能在投入大量下載或生產整合前,驗證特定模型上傳的品質。

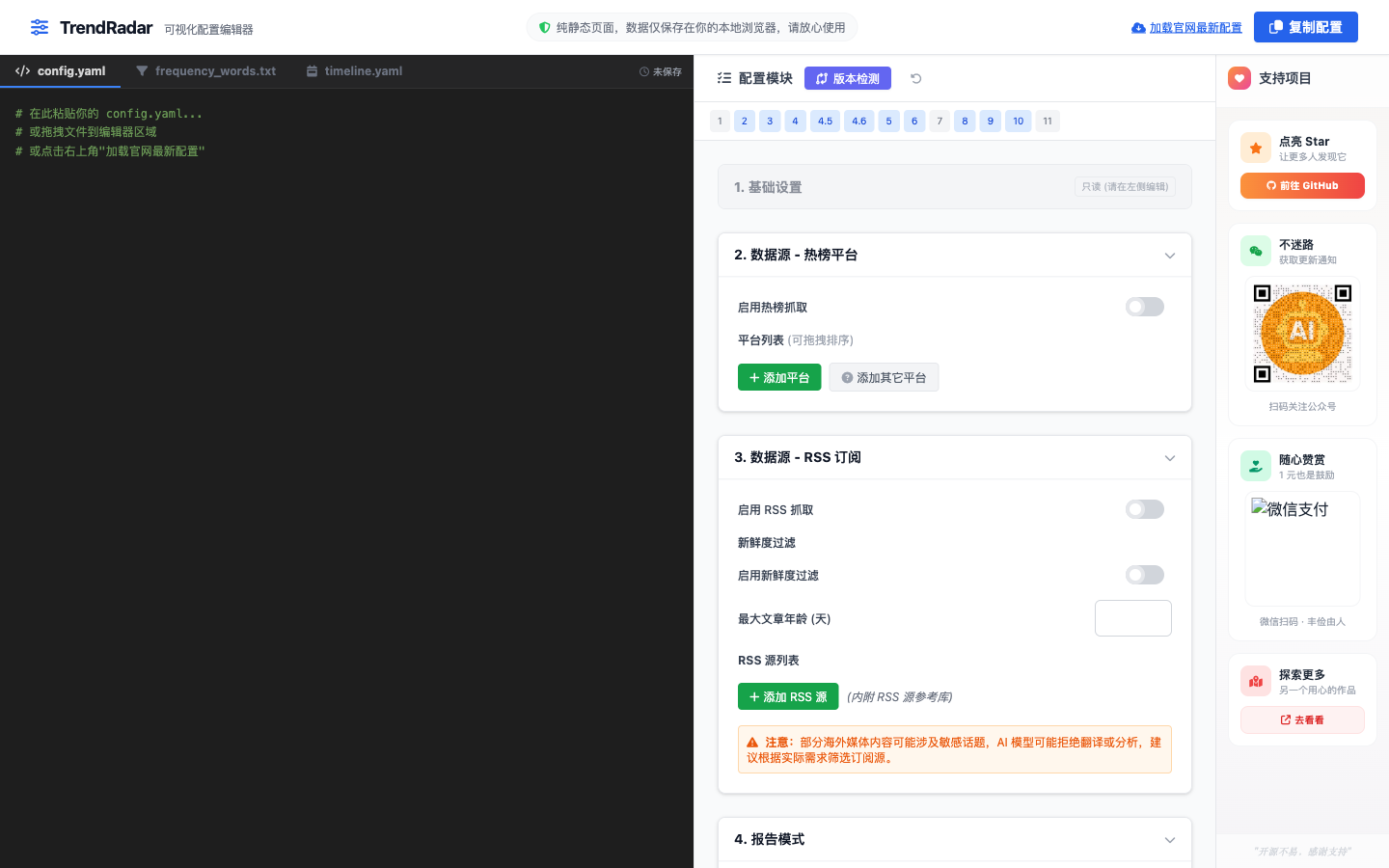

如何使用 localbench

- 前往 localbench Substack 存檔以獲取最新的量化報告。2. 識別與您硬體相關的模型架構與量化等級(例如 Q4_K_M、Q6_K)。3. 查看 KL 散度指標,比較不同上傳者之間的準確度損失。4. 選擇在 VRAM 使用量與特定任務效能之間達到最佳平衡的 GGUF 檔案。5. 從連結的儲存庫(如 HuggingFace)下載所選模型檔案,以用於您的本地推理引擎。

localbench 的使用情境

優化本地 LLM 推理

建構本地 RAG 流程的 AI 工程師使用 localbench 選擇效能最高的 Q4 或 Q5 量化版本,確保在 8GB 或 16GB VRAM 限制內維持高準確度。

生產環境模型選擇

在同一模型的多個 GGUF 版本間進行選擇的開發者,利用 KL 散度數據驗證哪位上傳者提供的輸出最可靠,從而降低模型產生幻覺的風險。

量化流程驗證

研究人員與模型微調人員使用這些基準測試來驗證自己的量化腳本,將結果與既有基準進行比較,以確保轉換過程未引入不必要的雜訊。

誰適合使用 localbench

AI 基礎設施工程師

需要在本地硬體上部署 LLM,並需要關於量化如何影響模型輸出品質的精確數據,以確保生產級的可靠性。

本地 LLM 愛好者

在本地執行 Llama 3 或 Mistral 等模型,並希望從消費級 GPU 中榨取最佳效能的進階使用者。

模型量化人員

將 GGUF 模型上傳至 HuggingFace,並希望根據行業標準驗證其轉換品質的創作者。

localbench 的價格方案

內容透過 localbench Substack 免費提供。無需訂閱即可存取研究與基準測試數據。