ONNX Runtime

Một công cụ học máy đa nền tảng dành cho việc suy luận mô hình với hiệu suất cao

Freemium

Nền tảng được hỗ trợ

web

ONNX Runtime là gì

ONNX Runtime là một công cụ AI cấp độ sản xuất được thiết kế để giải quyết nút thắt phổ biến trong việc tối ưu hóa các mô hình học máy cho nhiều môi trường phần cứng và phần mềm khác nhau. Bằng cách cung cấp một giao diện thống nhất cho cả quá trình huấn luyện và suy luận, công cụ này cho phép các đội ngũ triển khai mô hình trên CPU, GPU và NPU mà không làm giảm hiệu suất. Cho dù bạn đang làm việc với các Mô hình Ngôn ngữ Lớn (LLM) hay các mô hình dự đoán tiêu chuẩn, công cụ này đảm bảo rằng các ứng dụng của bạn duy trì độ trễ thấp và thông lượng cao, bất kể cơ sở hạ tầng bên dưới là gì. Được thiết kế để mang lại sự linh hoạt, runtime này hỗ trợ nhiều ngôn ngữ lập trình—bao gồm Python, C#, C++, Java, JavaScript và Rust—khiến nó trở thành lựa chọn đa năng cho các ngăn xếp công nghệ phức tạp. Nó thu hẹp khoảng cách giữa phát triển và sản xuất, cho phép các nhà phát triển duy trì hành vi mô hình nhất quán trên Linux, Windows, macOS, các nền tảng di động và trình duyệt web. Bằng cách hợp lý hóa việc thực thi các mô hình tiên tiến nhất, nó giúp các kỹ sư tập trung vào việc xây dựng các tính năng thông minh thay vì phải khắc phục sự cố tương thích phần cứng hoặc suy giảm hiệu suất.

Các tính năng chính của ONNX Runtime

Tăng tốc phần cứng

Tối ưu hóa hiệu suất về độ trễ, thông lượng và mức sử dụng bộ nhớ trên nhiều loại phần cứng, bao gồm CPU, GPU và NPU, đảm bảo mô hình của bạn chạy hiệu quả trên mọi thiết bị.

Hỗ trợ đa nền tảng

Cung cấp khả năng tương thích mạnh mẽ trên các hệ điều hành chính như Linux, Windows và macOS, cũng như các nền tảng di động và trình duyệt web, cho phép một chiến lược AI thực sự linh hoạt.

Hỗ trợ đa ngôn ngữ

Cung cấp khả năng tích hợp gốc cho các nhà phát triển sử dụng Python, C#, C++, Java, JavaScript và Rust, giúp dễ dàng kết hợp AI hiệu suất cao vào các ngăn xếp công nghệ đa dạng và hiện có.

Tích hợp AI tạo sinh

Cho phép triển khai các Mô hình Ngôn ngữ Lớn tiên tiến nhất, hỗ trợ các tác vụ phức tạp như tạo văn bản và tổng hợp hình ảnh trực tiếp trong các ứng dụng sản xuất của bạn.

Cách sử dụng ONNX Runtime

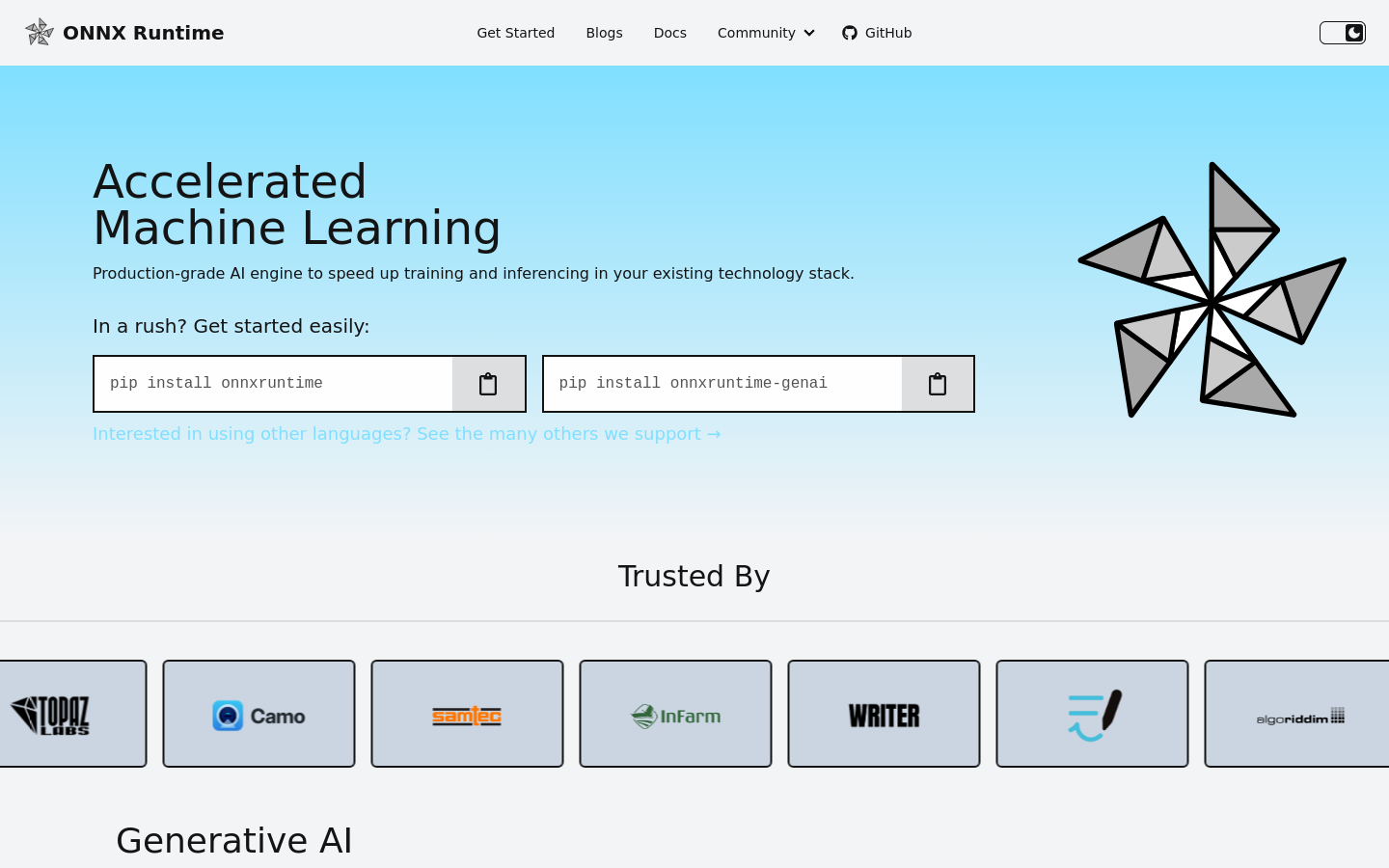

- Bắt đầu bằng việc cài đặt gói runtime thông qua trình quản lý gói ưa thích của bạn, chẳng hạn như 'pip install onnxruntime' hoặc 'pip install onnxruntime-genai', để thiết lập môi trường làm việc.

- Khởi tạo runtime bằng cách truyền đường dẫn tệp của mô hình học máy vào lớp 'InferenceSession', giúp chuẩn bị công cụ để thực thi mô hình cụ thể của bạn.

- Định dạng dữ liệu đầu vào của bạn thành cấu trúc tensor bắt buộc, đảm bảo nó khớp với lược đồ đầu vào dự kiến của mô hình để tránh lỗi runtime trong quá trình xử lý.

- Thực thi mô hình bằng cách gọi phương thức 'session.run' với dữ liệu đầu vào đã chuẩn bị, điều này sẽ kích hoạt công cụ để tạo ra các dự đoán hoặc kết quả đầu ra một cách hiệu quả.

- Xem xét các kết quả trả về từ phiên làm việc để tích hợp liền mạch các dự đoán của mô hình vào quy trình làm việc hoặc logic dịch vụ hiện có trong ứng dụng của bạn.

Các trường hợp sử dụng của ONNX Runtime

Triển khai Edge AI

Các nhà phát triển có thể triển khai các mô hình AI hiệu suất cao trên các thiết bị hạn chế tài nguyên như điện thoại di động hoặc phần cứng IoT bằng cách tận dụng các cấu hình runtime đã được tối ưu hóa.

Phục vụ mô hình trong sản xuất

Các kỹ sư có thể phục vụ các mô hình học máy một cách đáng tin cậy trong môi trường sản xuất, đảm bảo rằng các ứng dụng dành cho người dùng cuối được hưởng lợi từ độ trễ thấp và thông lượng cao.

Phát triển ứng dụng đa nền tảng

Các đội ngũ xây dựng ứng dụng cho nhiều nền tảng có thể sử dụng một runtime thống nhất duy nhất để duy trì hiệu suất AI nhất quán trên môi trường máy tính để bàn, di động và web.

Ai sẽ được lợi từ ONNX Runtime

Kỹ sư học máy

Các chuyên gia tập trung vào việc tối ưu hóa tốc độ suy luận mô hình và hiệu quả tài nguyên để đảm bảo các ứng dụng AI của họ đáp ứng các tiêu chuẩn hiệu suất cấp sản xuất.

Nhà phát triển phần mềm

Các nhà phát triển tích hợp AI vào ứng dụng trên nhiều ngôn ngữ khác nhau, những người cần một công cụ thực thi hiệu suất cao, đáng tin cậy và phù hợp với ngăn xếp công nghệ hiện có của họ.

Giá của ONNX Runtime

ONNX Runtime là một dự án mã nguồn mở hoàn toàn miễn phí.