Apache Airflow

Điều phối luồng công việc

Miễn phí

Nền tảng được hỗ trợ

web

Apache Airflow là gì

Apache Airflow là một nền tảng để lập trình, lên lịch và giám sát luồng công việc. Nó cho phép người dùng xác định các pipeline dưới dạng mã Python, cung cấp sự linh hoạt và kiểm soát các tác vụ xử lý dữ liệu. Giá trị cốt lõi của Airflow nằm ở khả năng điều phối các luồng công việc phức tạp, đảm bảo các tác vụ chạy theo đúng thứ tự và xử lý các phụ thuộc một cách hiệu quả. Không giống như các công việc cron truyền thống hoặc tập lệnh, Airflow cung cấp một giao diện người dùng (UI) mạnh mẽ để giám sát, ghi nhật ký và quản lý luồng công việc ở quy mô lớn. Kiến trúc mô-đun và tích hợp mở rộng của nó với các nhà cung cấp dịch vụ đám mây và các dịch vụ của bên thứ ba giúp nó thích ứng với nhiều môi trường khác nhau. Các kỹ sư dữ liệu, nhà khoa học dữ liệu và nhóm DevOps được hưởng lợi từ khả năng tự động hóa và hợp lý hóa các pipeline dữ liệu, đào tạo mô hình học máy và quản lý cơ sở hạ tầng của Airflow.

Các tính năng chính của Apache Airflow

Định nghĩa luồng công việc bằng Python

Airflow sử dụng Python để xác định luồng công việc (DAG), cho phép các nhà phát triển tận dụng toàn bộ sức mạnh của hệ sinh thái Python. Điều này bao gồm việc sử dụng các tính năng Python tiêu chuẩn như vòng lặp, câu lệnh điều kiện và định dạng ngày/giờ để lập lịch. Cách tiếp cận này cung cấp sự linh hoạt và tránh những hạn chế của các định nghĩa luồng công việc dựa trên dòng lệnh hoặc XML, cho phép tạo pipeline động và triển khai logic phức tạp.

Kiến trúc có thể mở rộng và mô-đun

Thiết kế mô-đun của Airflow cho phép nó mở rộng để xử lý một số lượng lớn các tác vụ đồng thời. Nó sử dụng hàng đợi tin nhắn (ví dụ: Celery, RabbitMQ) để điều phối công nhân, cho phép mở rộng theo chiều ngang bằng cách thêm nhiều nút công nhân hơn. Kiến trúc này đảm bảo rằng Airflow có thể quản lý các luồng công việc phức tạp với nhiều phụ thuộc và khối lượng dữ liệu lớn, làm cho nó phù hợp với việc triển khai cấp doanh nghiệp.

Giao diện người dùng web mạnh mẽ

Airflow cung cấp giao diện người dùng web thân thiện với người dùng để giám sát, lên lịch và quản lý luồng công việc. UI cung cấp các bản cập nhật trạng thái tác vụ theo thời gian thực, nhật ký chi tiết và khả năng kích hoạt, tạm dừng và thử lại các tác vụ. Giao diện tập trung này đơn giản hóa việc quản lý luồng công việc, cung cấp thông tin chi tiết về hiệu suất pipeline và giảm nhu cầu can thiệp thủ công, cải thiện hiệu quả hoạt động.

Tích hợp mở rộng

Airflow cung cấp một loạt các toán tử được tích hợp sẵn để tích hợp với các dịch vụ khác nhau, bao gồm Google Cloud Platform, Amazon Web Services, Microsoft Azure và nhiều công cụ của bên thứ ba. Các toán tử này đơn giản hóa quá trình thực hiện các tác vụ trên các nền tảng khác nhau, giảm nhu cầu viết script tùy chỉnh và tăng tốc sự phát triển của các pipeline dữ liệu và các luồng công việc khác.

Tạo pipeline động

Airflow cho phép tạo pipeline động thông qua mã Python. Điều này có nghĩa là bạn có thể viết mã để khởi tạo các pipeline một cách động, dựa trên dữ liệu hoặc các tham số khác. Tính năng này đặc biệt hữu ích để xử lý các tác vụ định kỳ, xử lý dữ liệu từ nhiều nguồn hoặc tạo các pipeline thích ứng với các yêu cầu kinh doanh đang thay đổi, tăng cường tính linh hoạt và tự động hóa.

Mã nguồn mở và do cộng đồng điều khiển

Airflow là một dự án mã nguồn mở với một cộng đồng sôi động. Điều này có nghĩa là người dùng có thể đóng góp cho dự án, chia sẻ kinh nghiệm của họ và truy cập vào vô số tài nguyên và hỗ trợ. Bản chất mã nguồn mở thúc đẩy tính minh bạch, cộng tác và cải tiến liên tục, đảm bảo rằng Airflow vẫn là một nền tảng điều phối luồng công việc mạnh mẽ và dễ thích ứng.

Cách sử dụng Apache Airflow

- Cài đặt Airflow bằng pip:

pip install apache-airflow.,2. Khởi tạo cơ sở dữ liệu Airflow:airflow db init.,3. Tạo DAG (Directed Acyclic Graph) trong Python, xác định các tác vụ và phụ thuộc luồng công việc của bạn.,4. Đặt tệp DAG của bạn trong thư mụcdagstrong thư mục gốc Airflow của bạn.,5. Khởi động webserver và scheduler của Airflow:airflow webserver -p 8080vàairflow scheduler.,6. Truy cập UI Airflow trong trình duyệt của bạn (thường tạihttp://localhost:8080) để giám sát và quản lý luồng công việc của bạn.

Các trường hợp sử dụng của Apache Airflow

Tự động hóa Pipeline dữ liệu

Các kỹ sư dữ liệu sử dụng Airflow để tự động hóa quy trình ETL (Trích xuất, Chuyển đổi, Tải). Họ xác định DAG để trích xuất dữ liệu từ nhiều nguồn khác nhau, chuyển đổi nó bằng các công cụ như Spark hoặc Pandas và tải nó vào một kho dữ liệu. Điều này đảm bảo dữ liệu được cập nhật nhất quán và sẵn sàng để phân tích, tiết kiệm thời gian và tài nguyên.

Đào tạo mô hình học máy

Các nhà khoa học dữ liệu sử dụng Airflow để lên lịch và quản lý việc đào tạo các mô hình học máy. Họ tạo DAG để điều phối việc xử lý trước dữ liệu, đào tạo mô hình, đánh giá và triển khai. Điều này tự động hóa vòng đời ML, đảm bảo các mô hình được đào tạo lại thường xuyên với dữ liệu mới nhất và được triển khai hiệu quả.

Quản lý cơ sở hạ tầng

Các kỹ sư DevOps sử dụng Airflow để tự động hóa các tác vụ cơ sở hạ tầng, chẳng hạn như cung cấp máy chủ, triển khai ứng dụng và quản lý tài nguyên đám mây. Họ tạo DAG để điều phối các tác vụ này, đảm bảo chúng được thực hiện theo đúng thứ tự và với các phụ thuộc cần thiết, cải thiện hiệu quả hoạt động.

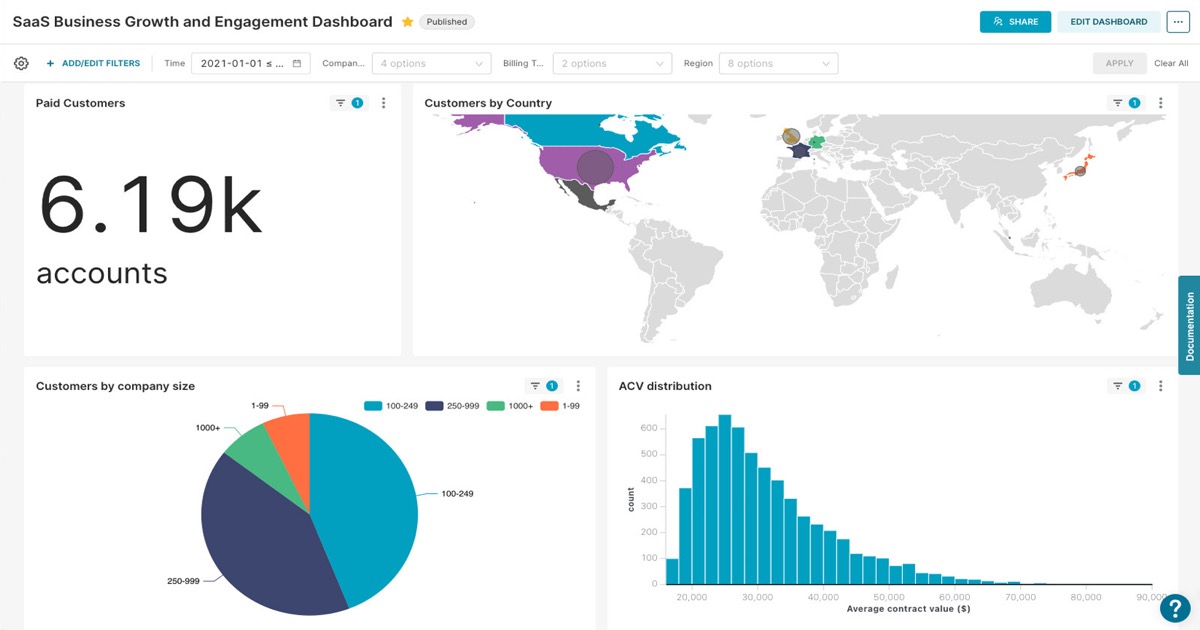

Báo cáo và phân tích

Các nhà phân tích sử dụng Airflow để tự động hóa việc tạo báo cáo và bảng điều khiển. Họ xác định DAG để trích xuất dữ liệu từ cơ sở dữ liệu, chuyển đổi nó và tạo báo cáo bằng các công cụ như SQL hoặc tập lệnh Python. Điều này đảm bảo rằng các báo cáo được tạo theo lịch trình thường xuyên và cung cấp thông tin chi tiết cập nhật.

Ai sẽ được lợi từ Apache Airflow

Kỹ sư dữ liệu

Kỹ sư dữ liệu cần Airflow để xây dựng và quản lý các pipeline dữ liệu. Họ sử dụng nó để tự động hóa các quy trình ETL, đảm bảo dữ liệu được chuyển đổi và tải hiệu quả. Khả năng lập lịch và giám sát của Airflow giúp họ duy trì chất lượng dữ liệu và giảm sự can thiệp thủ công.

Nhà khoa học dữ liệu

Các nhà khoa học dữ liệu sử dụng Airflow để tự động hóa vòng đời học máy. Họ tạo luồng công việc để xử lý trước dữ liệu, đào tạo mô hình, đánh giá và triển khai. Điều này cho phép họ tập trung vào phát triển và phân tích mô hình hơn là điều phối thủ công.

Kỹ sư DevOps

Kỹ sư DevOps sử dụng Airflow để tự động hóa các tác vụ cơ sở hạ tầng. Họ tạo luồng công việc để cung cấp máy chủ, triển khai ứng dụng và quản lý tài nguyên đám mây. Điều này cải thiện hiệu quả hoạt động và giảm nguy cơ lỗi.

Nhà phân tích kinh doanh

Các nhà phân tích kinh doanh sử dụng Airflow để tự động hóa các quy trình báo cáo và phân tích. Họ tạo luồng công việc để trích xuất dữ liệu, chuyển đổi nó và tạo báo cáo. Điều này đảm bảo rằng các báo cáo được tạo theo lịch trình thường xuyên và cung cấp thông tin chi tiết cập nhật.

Giá của Apache Airflow

Giấy phép Apache 2.0 (Mã nguồn mở). Miễn phí sử dụng, sửa đổi và phân phối.