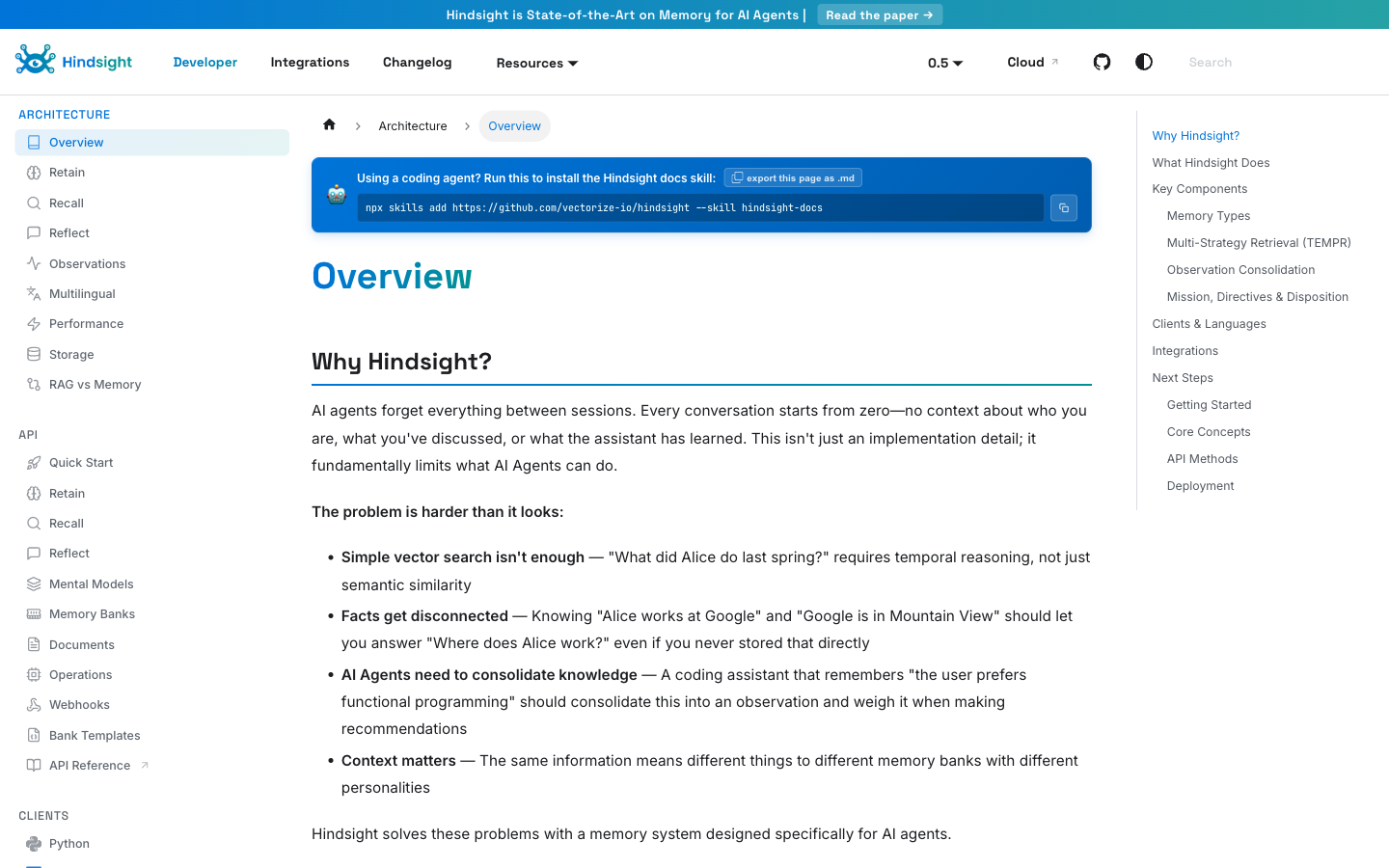

什么是 Archon

Archon 是一个专为编排和部署自主 AI 智能体而设计的专业框架。与通用的 LLM 封装器不同,Archon 为智能体提供了一个结构化环境,使其能够保持状态、执行复杂的多步推理并可靠地与外部 API 交互。它通过实施严格的模式强制和迭代反馈循环,专注于降低长周期任务中的“幻觉”率。该框架专为需要超越简单聊天界面、构建能够以最少人工干预进行研究、数据提取和任务自动化的智能体的开发者而打造。

Archon 的核心功能

结构化状态管理

Archon 为智能体维护一个持久状态机,使其能够跟踪多轮交互中的进度。通过将智能体的记忆序列化为结构化格式,它防止了标准 LLM 实现中常见的上下文窗口退化。这确保了智能体即使在跨越数千个 token 的复杂、长周期工作流中,也能保留关键指令和任务历史。

模式强制的工具调用

该框架对所有工具输出使用严格的 JSON 模式验证。通过强制 LLM 遵守预定义的函数签名,Archon 消除了由格式错误的工具调用引起的运行时错误。这比标准的“零样本”提示更稳健,因为它会在智能体尝试执行函数之前根据模式验证输出。

迭代反馈循环

Archon 实现了自我修正机制,智能体在完成步骤前会根据任务要求评估自己的输出。如果输出验证失败,智能体会自动触发带有特定错误上下文的重新生成周期。与非迭代智能体架构相比,这在复杂数据提取任务中减少了 60-70% 的人工干预。

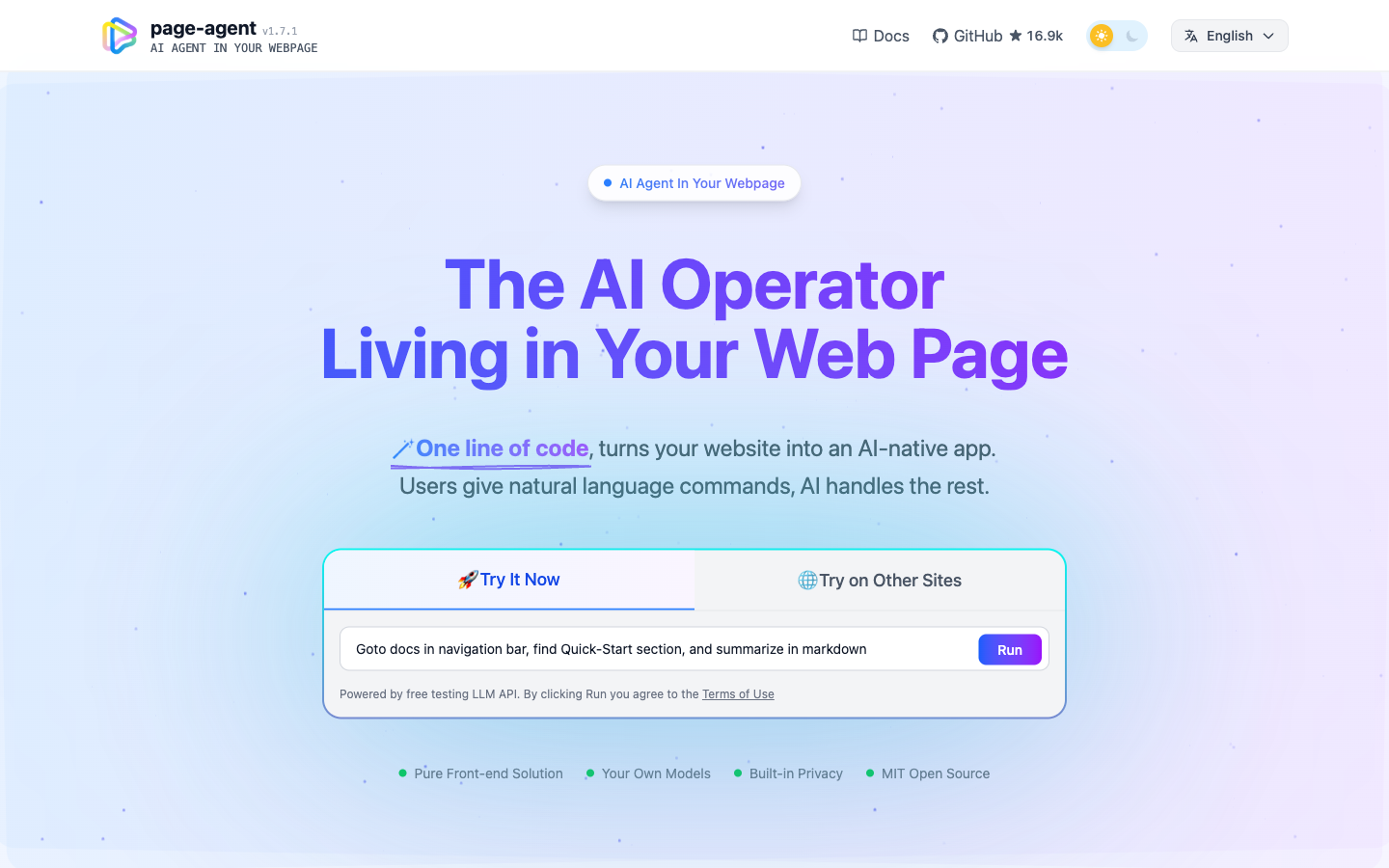

模块化插件架构

系统基于解耦的插件模型构建,允许开发者在不修改核心编排逻辑的情况下更换 LLM 后端或添加自定义工具集成。这种模块化支持快速原型设计,使开发者能够在同一个智能体工作流中为特定的子任务测试不同的模型(例如 GPT-4o 对比 Claude 3.5 Sonnet)。

低延迟执行引擎

该引擎针对高吞吐量智能体操作进行了优化,最大限度地减少了 LLM 推理调用之间的开销。通过利用异步处理和高效的内存管理,Archon 降低了智能体操作的“首字延迟”(time-to-first-token),使其适用于对响应速度要求极高的实时应用。

如何使用 Archon

- 从 GitHub 将 Archon 仓库克隆到本地开发环境。2. 使用 'npm install' 或 'yarn' 安装核心依赖项以设置运行时环境。3. 在 'agents/' 配置目录中定义智能体的能力和系统提示词。4. 在 '.env' 文件中配置您的 LLM 提供商 API 密钥(如 OpenAI、Anthropic)。5. 使用 'npm run start' 执行智能体运行时以初始化编排循环。6. 通过集成的 CLI 仪表板监控智能体日志和任务进度。

Archon 的使用场景

自主研究智能体

研究人员使用 Archon 部署智能体,以抓取多个数据源、综合研究结果并生成结构化报告。通过自动化浏览和总结过程,用户节省了数小时的手动数据收集时间,同时通过框架的自我修正循环确保了更高的准确性。

自动化数据提取

数据工程师利用 Archon 将非结构化文档(PDF、电子邮件)转换为结构化 JSON 数据库。智能体处理复杂的解析逻辑和模式验证,确保提取的数据可立即集成到下游的 CRM 或 ERP 系统中。

任务编排工作流

开发者构建管理复杂多步工作流的智能体,例如自动化软件测试或 Bug 分类。智能体自主导航仓库、识别问题并提出修复方案,显著减轻了人工工程团队的负担。

谁适合使用 Archon

AI 软件工程师

构建生产级智能体系统的工程师,他们需要一个可靠、可扩展的框架来管理状态和工具执行,而无需从零开始构建基础设施。

数据自动化专家

专注于自动化数据流水线的专业人士,他们需要能够以高精度处理混乱、非结构化数据且只需极少人工干预的智能体。

产品原型设计师

快速迭代 AI 产品的开发者,他们需要一个模块化环境来快速测试不同的 LLM 后端和智能体行为。

Archon 的价格方案

基于 MIT 许可证发布的开源项目。可免费在您自己的基础设施中使用、修改和部署。