什么是 Apache Airflow

Apache Airflow 是一个用于以编程方式编写、调度和监控工作流的平台。它使用户能够将管道定义为 Python 代码,从而提供对数据处理任务的灵活性和控制。Airflow 的核心价值在于其编排复杂工作流的能力,确保任务按正确的顺序运行并有效处理依赖关系。与传统的 cron 作业或脚本不同,Airflow 提供了一个强大的 UI,用于大规模监控、记录和管理工作流。其模块化架构以及与云提供商和第三方服务的广泛集成使其能够适应不同的环境。数据工程师、数据科学家和 DevOps 团队受益于 Airflow 自动化和简化数据管道、机器学习模型训练和基础设施管理的能力。

Apache Airflow 的核心功能

基于 Python 的工作流定义

Airflow 使用 Python 定义工作流 (DAG),允许开发人员利用 Python 生态系统的全部功能。这包括使用标准 Python 功能,如循环、条件语句和日期/时间格式进行调度。这种方法提供了灵活性,并避免了基于命令行或 XML 的工作流定义的局限性,从而实现动态管道生成和复杂逻辑的实现。

可扩展和模块化架构

Airflow 的模块化设计使其能够扩展以处理大量并发任务。它使用消息队列(例如,Celery、RabbitMQ)来编排工作程序,通过添加更多工作程序节点来实现水平扩展。这种架构确保 Airflow 可以管理具有众多依赖项和高数据量的复杂工作流,使其适用于企业级部署。

强大的 Web UI

Airflow 提供了一个用户友好的 Web UI,用于监控、调度和管理工作流。UI 提供实时任务状态更新、详细日志以及触发、暂停和重试任务的功能。这个集中式界面简化了工作流管理,提供了对管道性能的见解,并减少了手动干预的需要,从而提高了运营效率。

广泛的集成

Airflow 提供了广泛的预构建操作符,用于与各种服务集成,包括 Google Cloud Platform、Amazon Web Services、Microsoft Azure 和许多第三方工具。这些操作符简化了在不同平台上执行任务的过程,减少了对自定义脚本的需求,并加速了数据管道和其他工作流的开发。

动态管道生成

Airflow 允许通过 Python 代码进行动态管道生成。这意味着您可以编写代码,根据数据或其他参数动态实例化管道。此功能对于处理重复性任务、处理来自多个来源的数据或创建适应不断变化的业务需求的管道特别有用,从而增强了灵活性和自动化。

开源和社区驱动

Airflow 是一个具有活跃社区的开源项目。这意味着用户可以为项目做出贡献、分享他们的经验,并获得丰富的资源和支持。开源的性质促进了透明度、协作和持续改进,确保 Airflow 仍然是一个强大且适应性强的工作流编排平台。

如何使用 Apache Airflow

- 使用 pip 安装 Airflow:

pip install apache-airflow。2. 初始化 Airflow 数据库:airflow db init。3. 在 Python 中创建一个 DAG(有向无环图),定义您的工作流任务和依赖关系。4. 将您的 DAG 文件放在 Airflow 主目录中的dags文件夹中。5. 启动 Airflow Web 服务器和调度程序:airflow webserver -p 8080和airflow scheduler。6. 在您的浏览器中访问 Airflow UI(通常位于http://localhost:8080),以监控和管理您的工作流。

Apache Airflow 的使用场景

数据管道自动化

数据工程师使用 Airflow 自动化 ETL(提取、转换、加载)过程。他们定义 DAG 以从各种来源提取数据,使用 Spark 或 Pandas 等工具转换数据,并将其加载到数据仓库中。这确保了数据的一致更新并为分析做好准备,从而节省了时间和资源。

机器学习模型训练

数据科学家使用 Airflow 来调度和管理机器学习模型的训练。他们创建 DAG 来编排数据预处理、模型训练、评估和部署。这实现了 ML 生命周期的自动化,确保模型定期使用最新数据重新训练并高效部署。

基础设施管理

DevOps 工程师使用 Airflow 自动化基础设施任务,例如配置服务器、部署应用程序和管理云资源。他们创建 DAG 来编排这些任务,确保它们以正确的顺序执行并具有必要的依赖关系,从而提高运营效率。

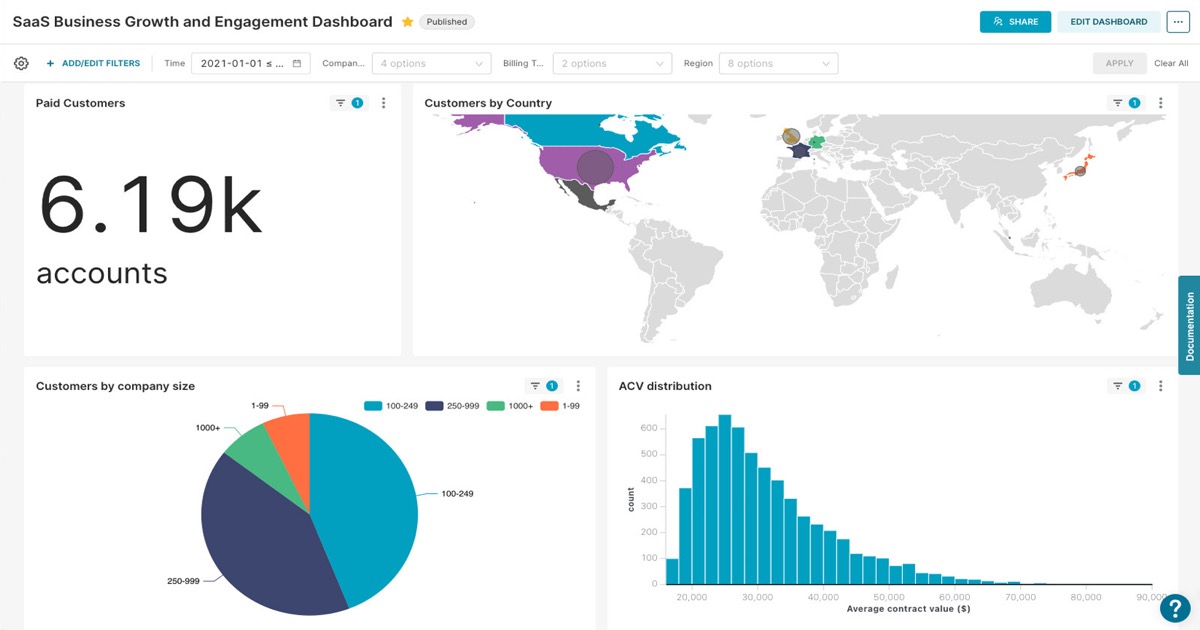

报告和分析

分析师使用 Airflow 自动化报告和仪表板的生成。他们定义 DAG 以从数据库中提取数据、转换数据,并使用 SQL 或 Python 脚本生成报告。这确保了报告定期生成并提供最新的见解。

谁适合使用 Apache Airflow

数据工程师

数据工程师需要 Airflow 来构建和管理数据管道。他们使用它来自动化 ETL 流程,确保数据得到有效转换和加载。Airflow 的调度和监控功能帮助他们保持数据质量并减少手动干预。

数据科学家

数据科学家使用 Airflow 来自动化机器学习生命周期。他们创建用于数据预处理、模型训练、评估和部署的工作流。这使他们能够专注于模型开发和分析,而不是手动编排。

DevOps 工程师

DevOps 工程师使用 Airflow 来自动化基础设施任务。他们创建用于配置服务器、部署应用程序和管理云资源的工作流。这提高了运营效率并降低了出错的风险。

业务分析师

业务分析师使用 Airflow 来自动化报告和分析流程。他们创建工作流来提取数据、转换数据和生成报告。这确保了报告定期生成并提供最新的见解。

Apache Airflow 的价格方案

Apache 许可证 2.0(开源)。免费使用、修改和分发。