The GenAI evaluation and observability platform

GenAI评估与可观测平台

免费增值

支持平台

web

什么是 The GenAI evaluation and observability platform

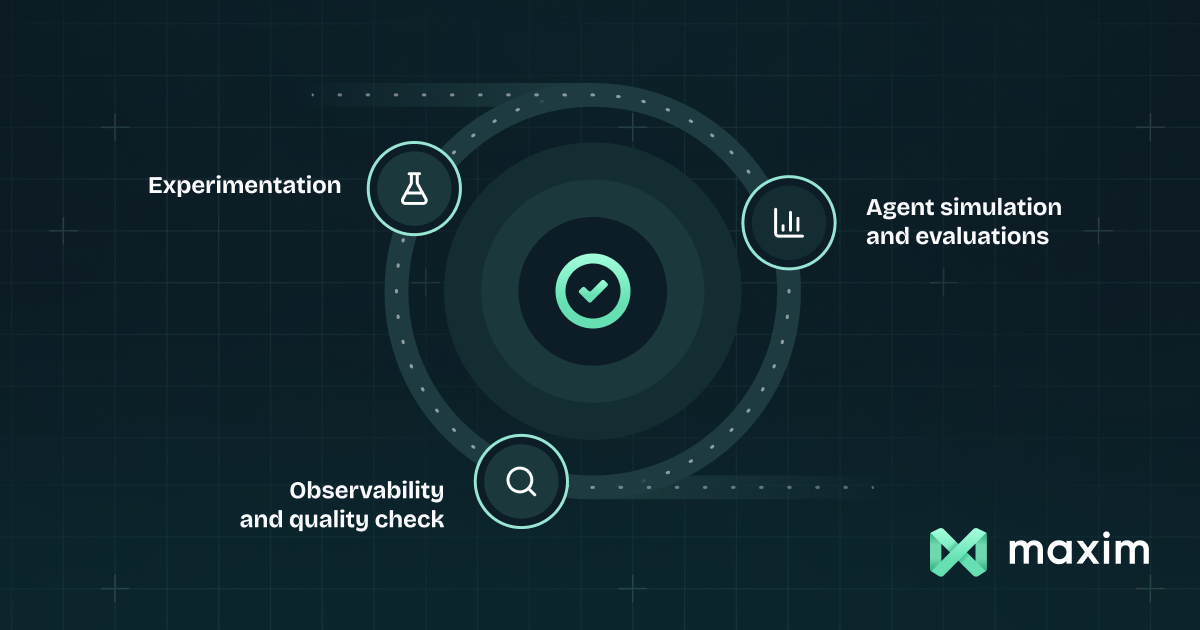

Maxim是一个用于评估和观察生成式AI应用的平台。它提供用于全面测试、性能监控和调试AI模型的工具。与通用监控解决方案不同,Maxim专注于GenAI的独特挑战,提供诸如基于提示的测试、输出质量评估和模型行为分析等功能。该平台利用先进技术进行自动化评估,并提供关于模型性能的详细见解,包括延迟、准确性和成本。Maxim使AI工程师、机器学习研究人员和产品经理受益,通过简化可靠且高性能GenAI应用的开发和部署。它帮助用户识别和解决问题,优化模型性能,并确保AI驱动产品的质量。

The GenAI evaluation and observability platform 的核心功能

自动化评估流程

Maxim通过允许用户定义和执行全面的测试套件来自动化评估GenAI模型的过程。这包括支持各种评估指标,如准确性、相关性和毒性。用户可以配置流程以按计划运行测试或根据事件触发测试,确保持续监控和快速识别性能回归。此功能减少了手动工作量,提高了模型验证的效率。

基于提示的测试

Maxim提供先进的基于提示的测试功能,允许用户评估GenAI模型对各种提示和输入的响应。用户可以创建和管理提示库,测试不同的提示变体,并分析提示工程对模型输出的影响。此功能对于理解模型在不同条件下的行为以及优化提示以实现期望的结果至关重要。它支持提示的A/B测试。

输出质量评估

该平台提供用于评估GenAI模型输出质量的工具,包括流畅性、连贯性和事实准确性等指标。Maxim支持自动化和人工参与的评估方法,使用户能够将自动化测试的速度与人工评审的细微判断相结合。这确保了输出符合所需的质量标准,并与预期用例保持一致。

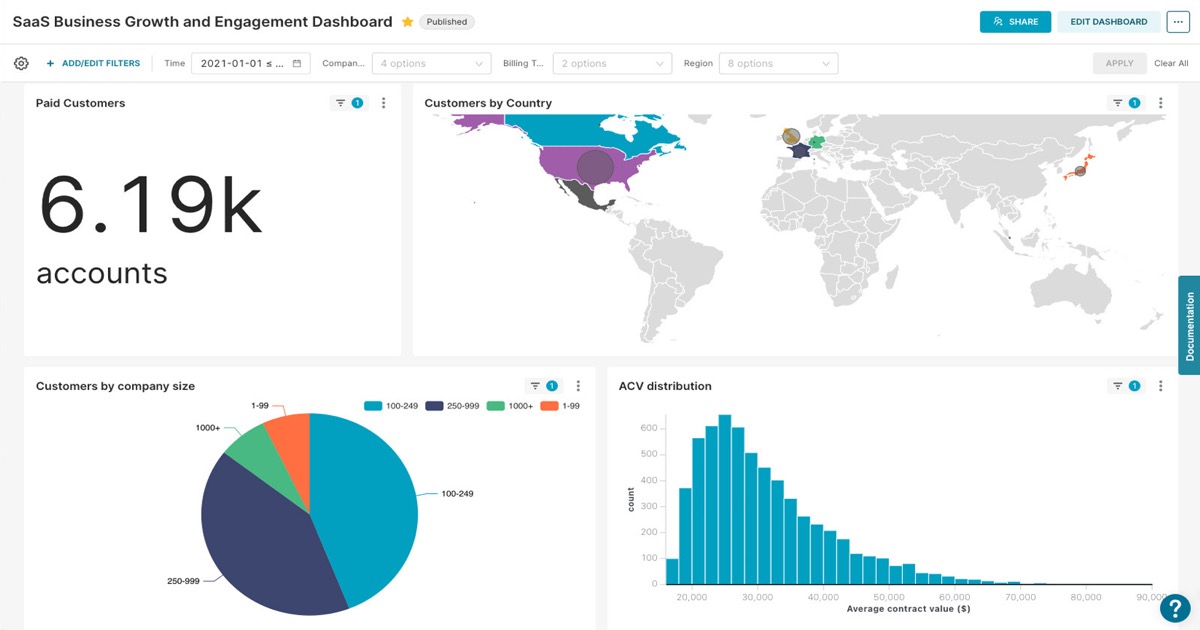

实时可观测性仪表板

Maxim的可观测性仪表板提供GenAI应用程序的实时监控,显示关键性能指标(KPI),如延迟、错误率和成本。仪表板允许用户随时间跟踪模型性能,识别异常并快速排除故障。它与各种日志记录和监控工具集成,提供应用程序健康状况和性能的统一视图。

模型行为分析

Maxim提供用于分析GenAI模型行为的工具,包括识别偏差、理解模型决策过程和检测潜在漏洞。用户可以使用这些工具来深入了解模型如何生成输出,并确保它们符合伦理准则和监管要求。此功能对于构建值得信赖和负责任的AI应用程序非常重要。

协作和报告

Maxim通过允许用户共享评估结果、仪表板和报告来促进团队成员之间的协作。该平台支持基于角色的访问控制,确保敏感数据的安全。用户可以生成自定义报告,以便向利益相关者传达调查结果,跟踪随时间推移的进展,并展示其GenAI应用程序的价值。此功能改善了团队沟通和决策。

如何使用 The GenAI evaluation and observability platform

- 在Maxim网站上注册一个免费帐户。2. 将Maxim SDK集成到您的GenAI应用程序中(支持Python、JavaScript等)。3. 定义与您的应用程序目标相关的评估指标和测试用例(例如,准确性、流畅性、连贯性)。4. 运行评估以根据您定义的指标评估模型性能,生成报告和见解。5. 使用Maxim的可观测性仪表板实时监控您的GenAI应用程序的性能。6. 分析结果,确定需要改进的领域,并迭代您的模型或提示。

The GenAI evaluation and observability platform 的使用场景

评估LLM性能

AI工程师使用Maxim来评估不同LLM(例如,GPT-3、Llama)在特定任务(如文本生成、摘要或问答)中的性能。他们定义测试用例,衡量准确性,并比较结果以选择最适合其应用程序的模型,同时优化性能和成本。

监控聊天机器人质量

产品经理使用Maxim来监控客户服务聊天机器人的质量。他们设置自动化测试以评估聊天机器人准确有效地回答客户问题的能力。该平台提供对聊天机器人性能的实时见解,使他们能够快速识别和修复问题。

检测AI模型中的偏差

研究人员使用Maxim来分析GenAI模型中的偏差。他们创建测试用例,以暴露模型输出中的潜在偏差。Maxim帮助他们识别和量化这些偏差,使他们能够采取纠正措施以改善公平性和伦理考虑。

优化提示工程

提示工程师使用Maxim对文本生成模型进行不同提示的A/B测试。他们衡量每个提示对模型输出质量(如相关性和连贯性)的影响。这有助于他们确定最有效的提示,从而提高模型的整体性能。

谁适合使用 The GenAI evaluation and observability platform

AI工程师

AI工程师需要Maxim来评估、监控和调试GenAI模型,确保它们符合性能和质量标准。该平台简化了开发流程,使工程师能够更快地迭代和部署可靠的AI应用程序。

机器学习研究人员

机器学习研究人员使用Maxim来分析模型行为、识别偏差和进行实验。该平台提供用于深入评估和报告的工具,帮助研究人员深入了解模型性能并改善他们的研究成果。

产品经理

产品经理利用Maxim来监控GenAI驱动的功能和产品的性能。他们使用该平台跟踪关键指标,识别问题,并确保AI组件满足用户期望和业务目标。

提示工程师

提示工程师使用Maxim来测试和优化各种GenAI模型的提示。该平台允许他们对不同的提示进行A/B测试,衡量它们对模型输出的影响,并完善提示以实现期望的结果,从而提高AI应用程序的整体有效性。

The GenAI evaluation and observability platform 的价格方案

提供免费计划。联系销售人员获取自定义定价和企业计划。