Apache Airflow

プログラムワークフロー

無料

サポートプラットフォーム

web

Apache Airflow とは

Apache Airflowは、プログラム的にワークフローを作成、スケジュール、監視するためのプラットフォームです。ユーザーはパイプラインをPythonコードとして定義でき、データ処理タスクを柔軟に制御できます。Airflowの主な価値は、複雑なワークフローをオーケストレーションし、タスクが正しい順序で実行され、依存関係を効果的に処理することです。従来のcronジョブやスクリプトとは異なり、Airflowは、大規模なワークフローを監視、ロギング、管理するための堅牢なUIを提供します。モジュール式のアーキテクチャと、クラウドプロバイダーやサードパーティサービスとの広範な統合により、多様な環境に適応できます。データエンジニア、データサイエンティスト、DevOpsチームは、Airflowのデータパイプライン、機械学習モデルのトレーニング、インフラストラクチャ管理を自動化し、効率化する能力から恩恵を受けます。

Apache Airflow の主な機能

Pythonベースのワークフロー定義

Airflowは、Pythonを使用してワークフロー(DAG)を定義し、開発者がPythonエコシステムのすべての機能を活用できるようにします。これには、ループ、条件文、日付/時刻形式などの標準的なPython機能が含まれます。このアプローチは柔軟性を提供し、コマンドラインまたはXMLベースのワークフロー定義の制限を回避し、動的なパイプライン生成と複雑なロジックの実装を可能にします。

スケーラブルでモジュール式のアーキテクチャ

Airflowのモジュール設計により、多数の同時タスクを処理するようにスケーリングできます。メッセージキュー(Celery、RabbitMQなど)を使用してワーカーをオーケストレーションし、より多くのワーカーノードを追加することで水平スケーリングを可能にします。このアーキテクチャにより、Airflowは多数の依存関係と大量のデータを伴う複雑なワークフローを管理でき、エンタープライズレベルのデプロイに適しています。

堅牢なWeb UI

Airflowは、ワークフローの監視、スケジュール、管理のためのユーザーフレンドリーなWeb UIを提供します。UIは、リアルタイムのタスクステータスの更新、詳細なログ、タスクのトリガー、一時停止、再試行の機能を提供します。この集中インターフェースは、ワークフロー管理を簡素化し、パイプラインのパフォーマンスに関する洞察を提供し、手動介入の必要性を減らし、運用効率を向上させます。

広範な統合

Airflowは、Google Cloud Platform、Amazon Web Services、Microsoft Azure、および多くのサードパーティツールを含むさまざまなサービスとの統合のための幅広い組み込みオペレーターを提供します。これらのオペレーターは、さまざまなプラットフォームでタスクを実行するプロセスを簡素化し、カスタムスクリプトの必要性を減らし、データパイプラインやその他のワークフローの開発を加速します。

動的パイプライン生成

Airflowは、Pythonコードによる動的パイプライン生成を可能にします。これは、データやその他のパラメータに基づいてパイプラインを動的にインスタンス化するコードを記述できることを意味します。この機能は、繰り返しタスクの処理、複数のソースからのデータの処理、または変化するビジネス要件に適応するパイプラインの作成に特に役立ち、柔軟性と自動化を強化します。

オープンソースとコミュニティ主導

Airflowは、活気のあるコミュニティを持つオープンソースプロジェクトです。これは、ユーザーがプロジェクトに貢献し、経験を共有し、豊富なリソースとサポートにアクセスできることを意味します。オープンソースの性質は、透明性、コラボレーション、継続的な改善を促進し、Airflowが強力で適応性の高いワークフローオーケストレーションプラットフォームであり続けることを保証します。

Apache Airflow の使い方

- pipを使用してAirflowをインストール:

pip install apache-airflow。2. Airflowデータベースを初期化:airflow db init。3. PythonでDAG(有向非巡回グラフ)を作成し、ワークフローのタスクと依存関係を定義します。4. DAGファイルをAirflowホームディレクトリ内のdagsフォルダーに配置します。5. Airflow Webサーバーとスケジューラーを起動:airflow webserver -p 8080とairflow scheduler。6. ブラウザでAirflow UIにアクセス(通常はhttp://localhost:8080)して、ワークフローを監視および管理します。

Apache Airflow の利用シーン

データパイプラインの自動化

データエンジニアは、Airflowを使用してETL(抽出、変換、ロード)プロセスを自動化します。さまざまなソースからデータを抽出し、SparkやPandasなどのツールを使用して変換し、データウェアハウスにロードするためのDAGを定義します。これにより、データが一貫して更新され、分析の準備が整い、時間とリソースが節約されます。

機械学習モデルのトレーニング

データサイエンティストは、Airflowを使用して機械学習モデルのトレーニングをスケジュールし、管理します。データの前処理、モデルのトレーニング、評価、デプロイをオーケストレーションするためのDAGを作成します。これにより、MLライフサイクルが自動化され、モデルが最新のデータで定期的に再トレーニングされ、効率的にデプロイされます。

インフラストラクチャ管理

DevOpsエンジニアは、Airflowを使用してインフラストラクチャタスクを自動化します。サーバーのプロビジョニング、アプリケーションのデプロイ、クラウドリソースの管理などのワークフローを作成します。これらのタスクが正しい順序で、必要な依存関係で実行されるようにDAGをオーケストレーションし、運用効率を向上させます。

レポートと分析

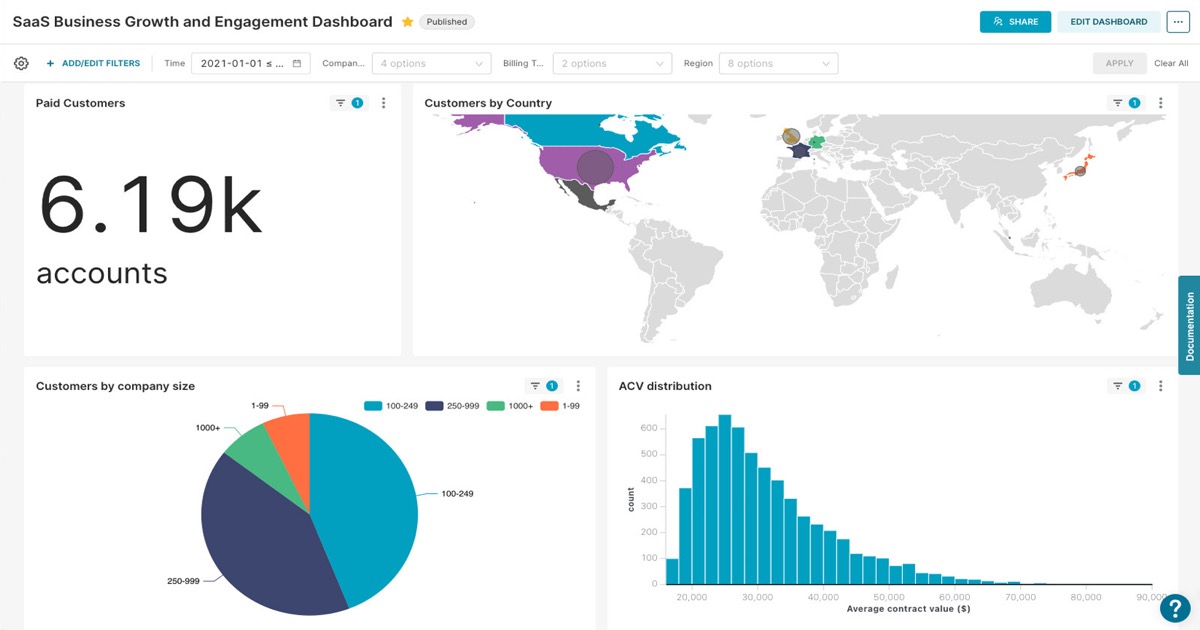

アナリストは、Airflowを使用してレポートとダッシュボードの生成を自動化します。データベースからデータを抽出し、変換し、SQLまたはPythonスクリプトなどのツールを使用してレポートを生成するためのDAGを定義します。これにより、レポートが定期的に生成され、最新の洞察が提供されます。

Apache Airflow が役立つ人

データエンジニア

データエンジニアは、データパイプラインを構築および管理するためにAirflowを必要とします。ETLプロセスを自動化し、データが効率的に変換およびロードされるようにするために使用します。Airflowのスケジューリングと監視機能は、データの品質を維持し、手動介入を減らすのに役立ちます。

データサイエンティスト

データサイエンティストは、機械学習ライフサイクルを自動化するためにAirflowを使用します。データの前処理、モデルのトレーニング、評価、デプロイのワークフローを作成します。これにより、手動オーケストレーションではなく、モデル開発と分析に集中できます。

DevOpsエンジニア

DevOpsエンジニアは、インフラストラクチャタスクを自動化するためにAirflowを使用します。サーバーのプロビジョニング、アプリケーションのデプロイ、クラウドリソースの管理のワークフローを作成します。これにより、運用効率が向上し、エラーのリスクが軽減されます。

ビジネスアナリスト

ビジネスアナリストは、レポートと分析プロセスを自動化するためにAirflowを使用します。データを抽出し、変換し、レポートを生成するためのワークフローを作成します。これにより、レポートが定期的に生成され、最新の洞察が提供されます。

Apache Airflow の料金プラン

Apache License 2.0(オープンソース)。自由に使用、変更、配布できます。