Cleanlab

คะแนนความน่าเชื่อถือ LLM แบบเรียลไทม์

เสียเงิน

แพลตฟอร์มที่รองรับ

web

แท็กเครื่องมือ

Cleanlab คืออะไร

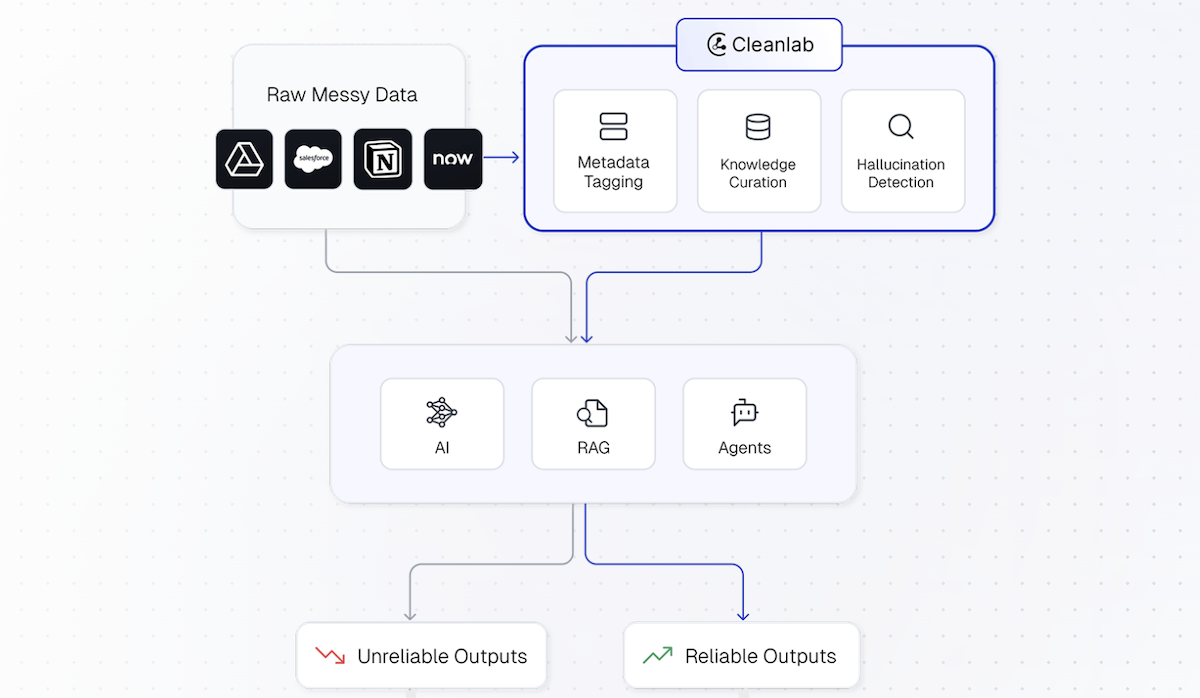

Cleanlab's Trustworthy Language Model (TLM) ให้คะแนนความน่าเชื่อถือแบบเรียลไทม์สำหรับผลลัพธ์ Large Language Model (LLM) ลดความเสี่ยงของภาพหลอนและคำตอบที่ไม่ถูกต้อง ช่วยให้ผู้ใช้ระบุการตอบสนอง LLM ที่เชื่อถือได้ เพื่อให้มั่นใจถึงความถูกต้องและความน่าเชื่อถือของแอปพลิเคชันที่ขับเคลื่อนด้วย AI ซึ่งแตกต่างจากเครื่องมือประเมิน LLM ทั่วไป TLM มุ่งเน้นไปที่การให้คะแนนแบบเรียลไทม์ ผสานรวมเข้ากับเวิร์กโฟลว์ที่มีอยู่ได้อย่างราบรื่น ใช้ประโยชน์จากอัลกอริทึมขั้นสูงเพื่อประเมินความน่าเชื่อถือของผลลัพธ์ LLM โดยให้ข้อมูลเชิงลึกที่นำไปปฏิบัติได้เพื่อปรับปรุงความน่าเชื่อถือของ AI TLM เหมาะสำหรับธุรกิจและนักพัฒนาที่ต้องการสร้างโซลูชัน AI ที่น่าเชื่อถือ เช่น แชทบอท เครื่องมือดึงข้อมูล และระบบที่ใช้ตัวแทน ช่วยให้ผู้ใช้ตัดสินใจโดยมีข้อมูลประกอบตามความน่าเชื่อถือของการตอบสนอง LLM ช่วยเพิ่มประสบการณ์ผู้ใช้และผลลัพธ์ทางธุรกิจ

คุณสมบัติหลักของ Cleanlab

การให้คะแนนความน่าเชื่อถือแบบเรียลไทม์

TLM ให้คะแนนความน่าเชื่อถือทันทีสำหรับผลลัพธ์ LLM ทำให้สามารถตัดสินใจแบบไดนามิกได้ในระหว่างรันไทม์ ซึ่งแตกต่างจากวิธีการประมวลผลแบบกลุ่ม ทำให้สามารถระบุการตอบสนองที่ไม่น่าเชื่อถือได้ทันที การให้คะแนนขึ้นอยู่กับอัลกอริทึมที่เป็นกรรมสิทธิ์ซึ่งวิเคราะห์ปัจจัยต่างๆ รวมถึงความมั่นใจของ LLM ความสอดคล้องของการตอบสนอง และการมีอยู่ของข้อผิดพลาดตามข้อเท็จจริง ความสามารถแบบเรียลไทม์นี้มีความสำคัญอย่างยิ่งสำหรับแอปพลิเคชันที่ความถูกต้องในทันทีมีความสำคัญสูงสุด

การตรวจจับภาพหลอน

TLM ได้รับการออกแบบมาเพื่อตรวจจับและทำเครื่องหมายภาพหลอนที่สร้างโดย LLM ซึ่งเป็นการตอบสนองที่ไม่ถูกต้องหรือถูกประดิษฐ์ขึ้น ใช้เทคนิคขั้นสูงเพื่อระบุความไม่สอดคล้องกันและความไม่ถูกต้องตามข้อเท็จจริงภายในผลลัพธ์ของ LLM คุณสมบัตินี้มีความสำคัญอย่างยิ่งสำหรับแอปพลิเคชันที่ความถูกต้องมีความสำคัญสูงสุด เช่น การวินิจฉัยทางการแพทย์หรือการวิเคราะห์ทางการเงิน ซึ่งข้อมูลที่ไม่ถูกต้องอาจมีผลกระทบร้ายแรง ระบบให้คะแนนความมั่นใจที่บ่งบอกถึงความเป็นไปได้ของภาพหลอน

เกณฑ์การประเมินที่ปรับแต่งได้

TLM ช่วยให้ผู้ใช้สามารถกำหนดเกณฑ์การประเมินแบบกำหนดเองที่ปรับให้เหมาะกับกรณีการใช้งานและข้อมูลเฉพาะของตนเอง ความยืดหยุ่นนี้ช่วยให้ผู้ใช้สามารถปรับการให้คะแนนความน่าเชื่อถือให้เข้ากับความต้องการเฉพาะของตนเอง เพื่อให้มั่นใจว่าระบบสอดคล้องกับข้อกำหนดเฉพาะของตนเอง ผู้ใช้สามารถระบุประเภทของข้อผิดพลาดที่จะจัดลำดับความสำคัญและระดับความเสี่ยงที่ยอมรับได้ การปรับแต่งนี้มีความจำเป็นสำหรับการเพิ่มประสิทธิภาพของแอปพลิเคชัน LLM ในโดเมนต่างๆ

การผสานรวมกับ LLM ต่างๆ

TLM รองรับการผสานรวมกับ LLM ที่หลากหลาย รวมถึงโมเดล OpenAI และอื่นๆ ทำให้สามารถใช้งานร่วมกันได้อย่างกว้างขวาง ซึ่งช่วยให้ผู้ใช้สามารถใช้ความสามารถในการให้คะแนนความน่าเชื่อถือของ TLM โดยไม่คำนึงถึงผู้ให้บริการ LLM ที่เลือก ระบบได้รับการออกแบบมาให้ปรับเปลี่ยนได้กับสถาปัตยกรรม LLM และรูปแบบเอาต์พุตที่แตกต่างกัน เพื่อให้มั่นใจถึงการผสานรวมที่ราบรื่น ความยืดหยุ่นนี้ช่วยลดความซับซ้อนของกระบวนการรวม TLM เข้ากับเวิร์กโฟลว์ AI ที่มีอยู่

โซลูชันเฉพาะกรณีการใช้งาน

Cleanlab นำเสนอโซลูชันและคำแนะนำที่สร้างไว้ล่วงหน้าสำหรับกรณีการใช้งานต่างๆ เช่น แชทบอท RAG ที่น่าเชื่อถือ การดึงข้อมูล และระบบที่ใช้ตัวแทน โซลูชันเหล่านี้เป็นจุดเริ่มต้นสำหรับการใช้งาน TLM ในแอปพลิเคชันเฉพาะ ทำให้กระบวนการพัฒนาคล่องตัวขึ้น คำแนะนำเสนอแนวทางปฏิบัติที่ดีที่สุดและตัวอย่างสำหรับการรวม TLM เข้ากับเวิร์กโฟลว์ต่างๆ แนวทางที่ตรงเป้าหมายนี้ช่วยให้ผู้ใช้ปรับใช้และได้รับประโยชน์จากความสามารถของ TLM ได้อย่างรวดเร็ว

วิธีใช้ Cleanlab

- เข้าถึงเอกสาร Cleanlab TLM และทำความคุ้นเคยกับ API และ SDK ที่มีอยู่, 2. รวม API TLM เข้ากับแอปพลิเคชันหรือเวิร์กโฟลว์ที่ใช้ LLM ของคุณ, 3. ส่งการตอบสนอง LLM ไปยัง API TLM เพื่อให้ได้คะแนนความน่าเชื่อถือแบบเรียลไทม์, 4. วิเคราะห์คะแนนความน่าเชื่อถือที่ส่งคืนเพื่อระบุผลลัพธ์ LLM ที่อาจไม่น่าเชื่อถือ, 5. ใช้กลยุทธ์ในการจัดการกับคะแนนความน่าเชื่อถือต่ำ เช่น การปรับเปลี่ยนคำสั่งใหม่ การตรวจสอบความถูกต้องของการตอบสนอง หรือการให้คำตอบทางเลือก, 6. ติดตามและปรับแต่งแอปพลิเคชัน LLM ของคุณอย่างต่อเนื่องตามข้อมูลเชิงลึกของ TLM เพื่อปรับปรุงความถูกต้องและความน่าเชื่อถือ

กรณีการใช้งานของ Cleanlab

แชทบอทที่น่าเชื่อถือ

นักพัฒนาสามารถใช้ TLM เพื่อสร้างแชทบอทที่ให้ข้อมูลที่เชื่อถือได้และถูกต้องโดยการให้คะแนนความน่าเชื่อถือของการตอบสนองแต่ละครั้ง ซึ่งช่วยให้มั่นใจได้ว่าแชทบอทหลีกเลี่ยงการสร้างคำตอบที่ไม่ถูกต้องหรือทำให้เข้าใจผิด ซึ่งช่วยเพิ่มความไว้วางใจและความพึงพอใจของผู้ใช้ ตัวอย่างเช่น แชทบอทบริการลูกค้าสามารถใช้ TLM เพื่อตรวจสอบความถูกต้องของการตอบสนองก่อนที่จะให้ข้อมูลแก่ผู้ใช้

การดึงข้อมูล

TLM สามารถใช้เพื่อปรับปรุงความถูกต้องของการดึงข้อมูลจากข้อความที่ไม่มีโครงสร้าง โดยการให้คะแนนความน่าเชื่อถือของข้อมูลที่ดึงมา ผู้ใช้สามารถระบุและแก้ไขข้อผิดพลาด เพื่อให้มั่นใจในคุณภาพของข้อมูล ตัวอย่างเช่น บริษัทสามารถใช้ TLM เพื่อดึงข้อมูลสำคัญจากสัญญา โดยตรวจสอบความถูกต้องของข้อมูลที่ดึงมาก่อนใช้งาน

ระบบที่ใช้ตัวแทน

TLM สามารถรวมเข้ากับระบบที่ใช้ตัวแทนเพื่อให้มั่นใจในความน่าเชื่อถือของการกระทำและการตัดสินใจของตัวแทน โดยการให้คะแนนความน่าเชื่อถือของผลลัพธ์ของตัวแทน นักพัฒนาสามารถป้องกันไม่ให้ตัวแทนดำเนินการตามข้อมูลที่ไม่ถูกต้อง ตัวอย่างเช่น ตัวแทนการซื้อขายทางการเงินสามารถใช้ TLM เพื่อตรวจสอบความถูกต้องของข้อมูลตลาดก่อนทำการซื้อขาย

การตัดสินใจแบบใช่/ไม่ใช่

TLM สามารถนำไปใช้เพื่อปรับปรุงความถูกต้องของกระบวนการตัดสินใจแบบใช่/ไม่ใช่ โดยการให้คะแนนความน่าเชื่อถือของการตอบสนองของ LLM ผู้ใช้สามารถตัดสินใจโดยมีข้อมูลประกอบมากขึ้นโดยอิงจากข้อมูลที่เชื่อถือได้ ตัวอย่างเช่น เครื่องมือวินิจฉัยทางการแพทย์สามารถใช้ TLM เพื่อประเมินความน่าเชื่อถือของการวินิจฉัยของ LLM ก่อนที่จะให้ข้อมูลแก่แพทย์

ใครที่ได้ประโยชน์จาก Cleanlab

นักพัฒนา AI

นักพัฒนา AI ได้รับประโยชน์จาก TLM โดยได้รับเครื่องมือในการปรับปรุงความน่าเชื่อถือและความถูกต้องของแอปพลิเคชันที่ใช้ LLM พวกเขาสามารถใช้ TLM เพื่อระบุและลดความเสี่ยงที่เกี่ยวข้องกับภาพหลอนของ LLM เพื่อให้มั่นใจว่าแอปพลิเคชันของพวกเขาให้ข้อมูลที่น่าเชื่อถือและมอบประสบการณ์การใช้งานที่ดีขึ้น

นักวิทยาศาสตร์ข้อมูล

นักวิทยาศาสตร์ข้อมูลสามารถใช้ประโยชน์จาก TLM เพื่อปรับปรุงคุณภาพของข้อมูลที่ดึงมาจาก LLM โดยการให้คะแนนความน่าเชื่อถือของผลลัพธ์ LLM นักวิทยาศาสตร์ข้อมูลสามารถปรับปรุงความถูกต้องของชุดข้อมูลและโมเดลของตนเอง ซึ่งนำไปสู่ข้อมูลเชิงลึกที่น่าเชื่อถือมากขึ้นและการตัดสินใจที่ดีขึ้น สิ่งนี้มีประโยชน์อย่างยิ่งสำหรับงานต่างๆ เช่น การใส่คำอธิบายประกอบข้อมูลและการดึงข้อมูล

ผู้นำทางธุรกิจ

ผู้นำทางธุรกิจสามารถใช้ TLM เพื่อสร้างความไว้วางใจในผลิตภัณฑ์และบริการที่ขับเคลื่อนด้วย AI ของตนเอง โดยการรับรองความน่าเชื่อถือของการตอบสนอง LLM พวกเขาสามารถปรับปรุงความพึงพอใจของลูกค้า ลดความเสี่ยงของข้อมูลที่ผิด และได้รับความได้เปรียบในการแข่งขัน สิ่งนี้มีความสำคัญอย่างยิ่งสำหรับแอปพลิเคชันที่เกี่ยวข้องกับข้อมูลที่ละเอียดอ่อนหรือการตัดสินใจที่สำคัญ

ราคา Cleanlab

รายละเอียดราคาไม่มีอยู่ในเอกสารที่ให้ไว้ โปรดเยี่ยมชมเว็บไซต์ Cleanlab สำหรับแผนการกำหนดราคาปัจจุบัน